【目标追踪】开源 | 基于注意力的紧凑跟踪框架MixFormer,在7个跟踪基准上性能SOTA!

【目标追踪】开源 | 基于注意力的紧凑跟踪框架MixFormer,在7个跟踪基准上性能SOTA!

CNNer

发布于 2023-02-28 11:11:09

发布于 2023-02-28 11:11:09

论文地址: http://arxiv.org/pdf/2302.02814v2.pdf

来源: 南京大学

论文名称:MixFormer: End-to-End Tracking with Iterative Mixed Attention

原文作者:Yutao Cui

内容提要

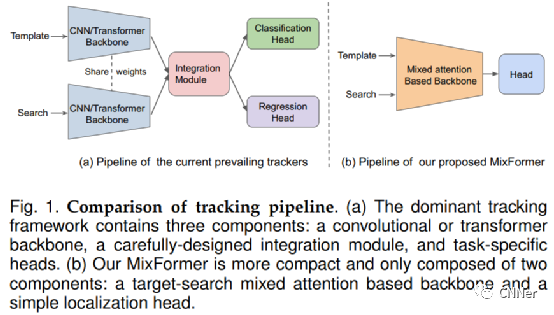

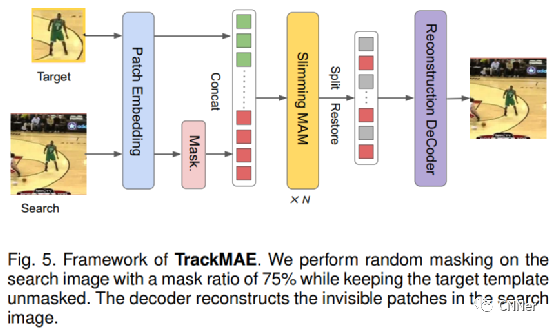

视觉目标跟踪通常采用特征提取、目标信息集成和边界估计的多阶段流程。为了简化这一流程,并统一特征提取和目标信息集成的过程,在本文中,我们提出了一个基于注意力的紧凑跟踪框架,称为MixFormer。我们的核心设计是利用注意力操作的灵活性,提出了一种混合注意力模块(Mixed attention Module, MAM),用于同时进行特征提取和目标信息集成。这种同步建模方案可以提取目标特定的判别特征,并在目标与搜索区域之间进行广泛的通信。基于MAM,我们通过堆叠多个MAM并在顶部放置定位头部来构建MixFormer跟踪器。具体来说,我们实例化了两种类型的MixFormer跟踪器,一个是分层跟踪器MixCvT,一个是非分层跟踪器MixViT。对于这两种跟踪器,我们研究了一系列的预训练方法,并揭示了MixFormer跟踪器中监督预训练和自我监督预训练之间的不同行为。我们还将masked预训练扩展到MixFormer跟踪器,并设计了竞争性TrackMAE预训练技术。最后,针对在线跟踪过程中处理多个目标模板的问题,设计了MAM中的非对称注意方案以降低计算成本,并提出了一个有效的分数预测模块来选择高质量的模板。MixFormer跟踪器在7个跟踪基准上设定了新的最先进的性能,包括LaSOT、TrackingNet、VOT2020、GOT-10k、OTB100和UAV123。其中,我们的MixViT-L在LaSOT上的AUC得分为73.3%,在TrackingNet上的AUC得分为86.1%,在VOT2020上的EAO得分为0.584,在GOT-10k上的AO得分为75.7%。

主要框架及实验结果

声明:文章来自于网络,仅用于学习分享,版权归原作者所有

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2023-02-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读