什么是高性能应用服务 HAI?

高性能应用服务(Hyper Application Inventor,HAI)面向中小企业及开发者快速部署 AI 应用需求,提供开箱即用的主流 AI 模型环境和快速、稳定、弹性的计算服务,能够大幅提高应用层的开发生产效率。

高性能应用服务 HAI 都有哪些应用?

AI 绘画:设计师和开发者可以使用 HAI 快速地部署和优化 AI 绘画模型。

LLM 语言模型:研究者和企业可以使用 HAI 快速部署和运行大型语言模型,如 LLAMA2、ChatGLM 等,确保开箱即用、启动迅速、高稳定性和可靠性。

AI 模型开发:HAI 的预配置环境支持大多数流行的 AI 框架和工具,如 TensorFlow、PyTorch 等,使得开发者可以专注于算法设计和模型优化。AI 研究者无需担心硬件兼容性和软件配置问题。

高性能应用服务 HAI 有哪些优势?

简单易用:相比实例包销方案,大幅简化了计算、网络和存储等基础设施的配置流程。

预置应用环境:多种 AI 环境快速部署,使用户可专注业务及应用场景创新。

高灵活性:可进行内部开发、业务测试,或对外提供业务服务。

多种登录方式:支持通过 jupyterlab、WebUI 等方式一键启动。

卡型种类丰富:提供多种算力套餐选择,未来还将加入更多种类供用户选择。

高性能应用服务 HAI 和 GPU 云服务器的区别?

GPU 云服务依据硬件资源进行选型购买,属于基础设施即服务(IaaS)层面的产品,适合有丰富运维技术经验的企业客户。

高性能应用服务(HAI)根据应用场景的划分进行选型购买,更适合希望快速部署 AI 应用的中小企业及开发者。

高性能应用服务 HAI 如何通过终端登录实例?

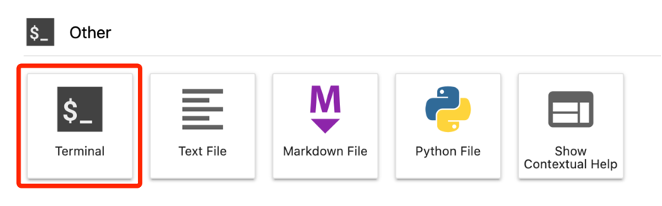

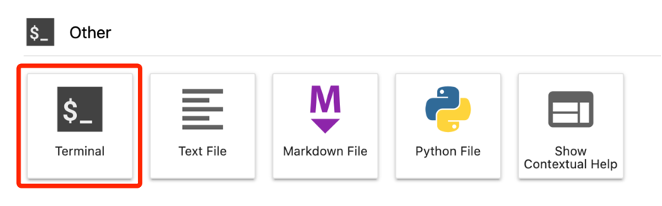

HAI 实例目前支持通过终端登入 HAI 实例的容器环境,可从 JupyterLab > Notebook > Other > Terminal 一键进入终端界面。请在进入前确保您熟悉 Linux 环境。目前,OrcaTerm 正在进行支持性开发,敬请期待。