视频内容安全( Video Moderation System,VM )是一款视频内容 AI 识别产品,帮助企业对上传的视频开展内容安全分析与风险识别。本产品当前提供两类服务:

视频内容安全服务:适用于检测互联网上常见的视频中画面、音频可能涉及的色情、违法违规等风险。

视频 AI 生成识别服务:适用于鉴别视频中的图像内容是否为 AI 工具生成。

视频内容安全服务

说明:

视频内容安全根据视频类型分为点播视频内容安全和直播视频内容安全两种服务。

随着互联网的快速发展,网络内容呈指数式增长,这其中可能充斥着各种不可控的风险因素,如:色情内容、违法内容等。通过人机结合的审核方式,是互联网审核的主流架构,本服务提供的是机器审核,能识别多种风险,并对可疑内容进行标记。

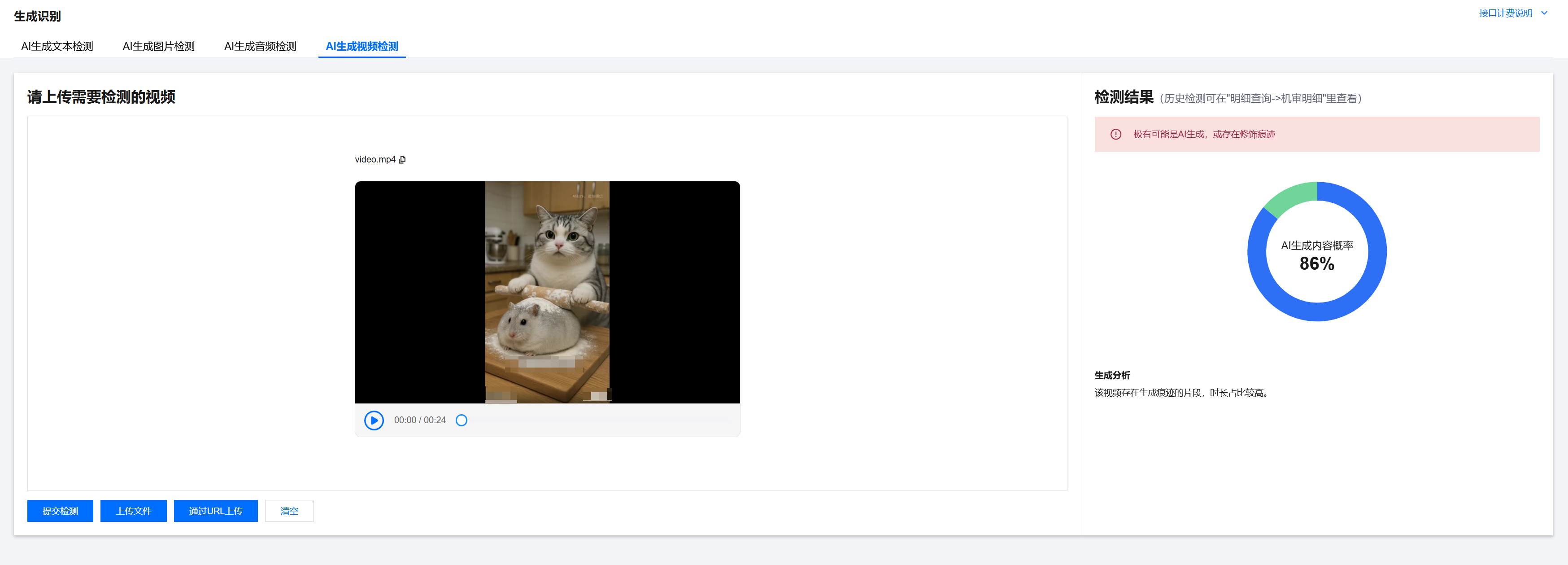

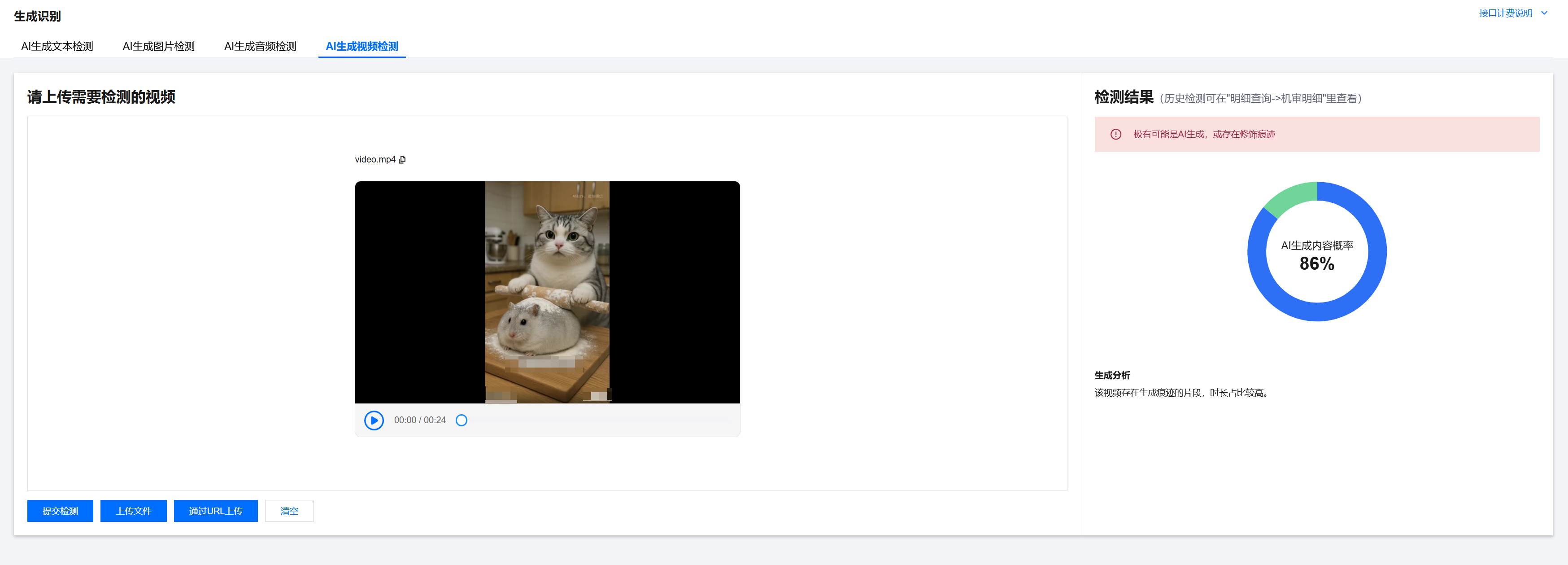

视频 AI 生成识别服务

随着生成式 AI 技术的爆发式发展,AI 生成视频已深度渗透直播、内容平台、营销等场景。视频 AI 生成识别通过多模态特征融合技术,鉴别视频内容是否由 AI 工具(如 Sora、Crafter、Lavie 等20多种模型)生成,助力企业:

识别 AI 生成内容的风险,如识别虚假新闻、伪造欺诈等风险因素;

提高内容生态的真实性,如直播平台识别 AI 虚拟主播、版权平台鉴别利用 AI 生成内容冒充人工原创的侵权视频;

优化内容运营策略,如区分真实 UGC 与 AI 创作,实现差异化流量分配。