小白如何正确使用爬虫代码

图片

步骤1:分析目标网站

假设我们要抓取抖音上的视频数据。首先,我们打开抖音的网页版(如https://www.douyin.com/),通过浏览器的开发者工具(按F12)查看网络请求,找到数据加载的接口(可能是XHR请求)或者观察页面结构。

步骤2:选择工具

如果数据是通过接口返回的(通常是JSON格式),我们可以直接请求该接口;如果数据是直接嵌入在HTML中,我们可以解析HTML;如果是动态加载,则使用Selenium。

步骤3:编写代码

情况1:通过API接口获取数据

假设我们发现抖音有隐藏的API接口,我们可以模拟请求头(包括User-Agent和Cookie)来获取数据。

Python

import requests

import json

# 设置请求头,模拟浏览器

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Cookie': '你的Cookie'

}

# 抖音视频API示例URL(需要根据实际分析得到)

url = 'https://www.douyin.com/aweme/v1/web/aweme/post/'

# 发送请求

response = requests.get(url, headers=headers)

if response.status_code == 200:

data = response.json()

# 解析JSON数据,提取视频信息

# 例如:视频标题、点赞数、评论数等

for item in data['aweme_list']:

title = item['desc']

like_count = item['statistics']['digg_count']

print(f'标题: {title}, 点赞数: {like_count}')

else:

print('请求失败:', response.status_code)

情况2:动态加载的网页,使用SELENIUM

如果数据是通过JavaScript动态加载的,我们可以使用Selenium模拟浏览器操作。

Python

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from webdriver_manager.chrome import ChromeDriverManager

import time

# 设置Chrome选项

options = webdriver.ChromeOptions()

options.add_argument('--headless') # 无头模式,不显示浏览器窗口

options.add_argument('--disable-gpu')

options.add_argument('user-agent=Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36')

# 安装并启动ChromeDriver

driver = webdriver.Chrome(service=Service(ChromeDriverManager().install()), options=options)

try:

driver.get('https://www.douyin.com/')

# 等待页面加载

time.sleep(5) # 根据网络情况调整等待时间

# 通过Selenium选择器获取元素

# 注意:需要根据实际网页结构调整选择器

video_list = driver.find_elements(By.CSS_SELECTOR, 'div.some-class') # 替换为实际的CSS选择器

for video in video_list:

# 提取视频信息,例如标题

title = video.find_element(By.CSS_SELECTOR, 'h2.title').text

print(f'标题: {title}')

finally:

driver.quit()

步骤4:存储数据

将抓取的数据保存到CSV文件中。

Python

import csv

# 假设我们有一个数据列表,每个元素是一个字典

data_list = [

{'title': '视频1', 'like_count': 100},

{'title': '视频2', 'like_count': 200}

]

withopen('videos.csv', 'w', newline='', encoding='utf-8') as f:

writer = csv.DictWriter(f, fieldnames=['title', 'like_count'])

writer.writeheader()

writer.writerows(data_list)

注意事项

- 遵守robots.txt:在抓取前检查目标网站的robots.txt文件,避免抓取不允许的页面。

- 频率控制:合理设置请求间隔,避免对目标网站造成过大压力。

- 反爬虫策略:如果遇到验证码或封IP,可能需要使用代理池或更高级的模拟技术。

- 法律合规:确保你的抓取行为不侵犯网站的数据权益,且用于合法目的。

以上是一个通用的视频网站爬虫开发流程。具体实现时,需要根据目标网站的具体情况进行调整。

§§相关问题§§

- 如何绕过视频网站的反爬虫机制?

- 如何抓取动态加载的视频数据?

- 如何存储和清洗抓取到的视频数据?

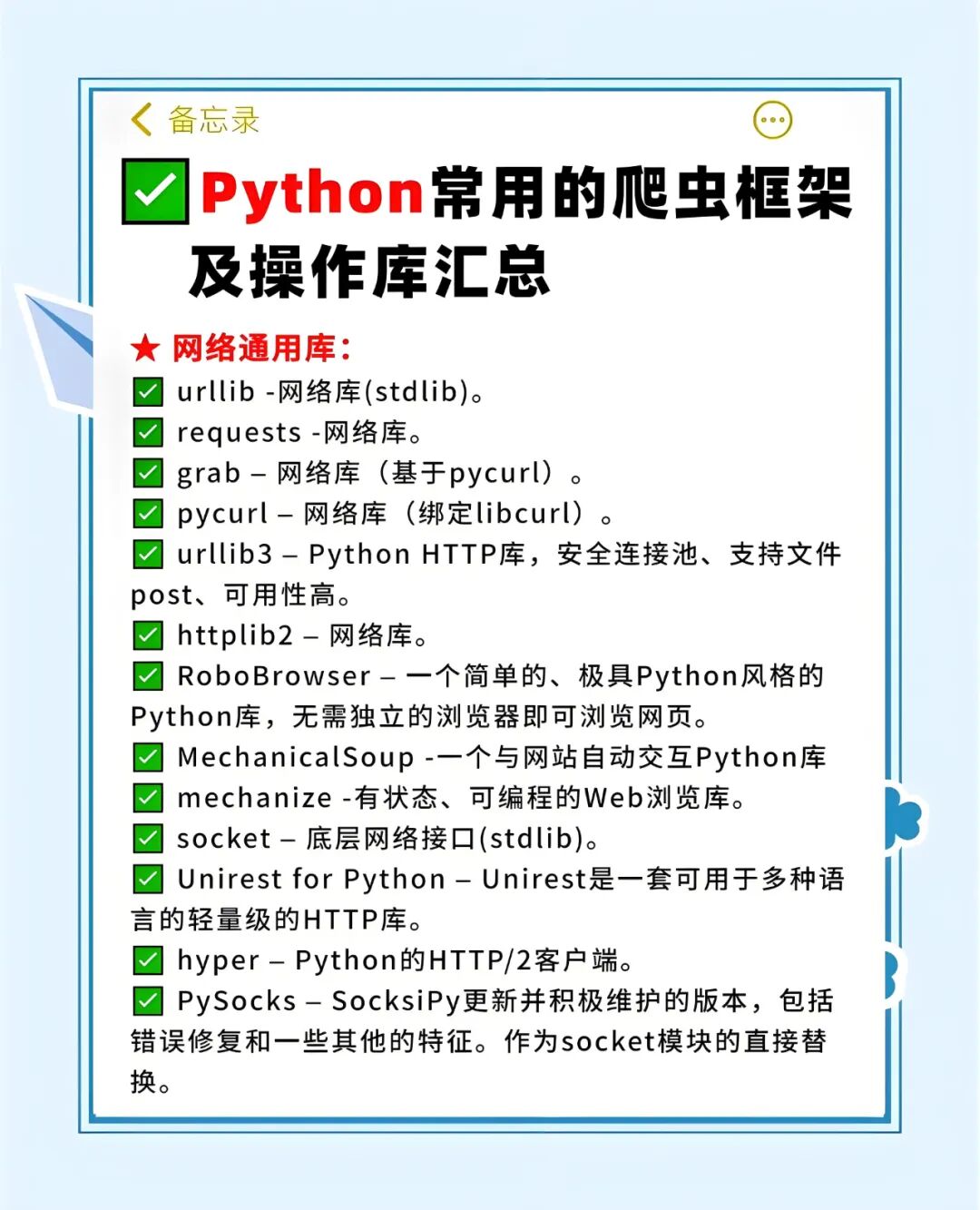

- 有哪些常见的视频数据抓取工具或库?

- 如何解析视频网站中的JSON数据?

Python爬虫开发:抓取视频网站内容指南

要开发抓取视频网站内容的Python爬虫,需解决以下核心问题:

1. 分析目标网站结构

- 确定视频数据加载方式:

- 静态加载:直接嵌入HTML(如B站部分页面),使用

requests+BeautifulSoup即可 - 动态加载:通过JavaScript/XHR加载(如抖音、快手),需用

Selenium或分析API接口

- 静态加载:直接嵌入HTML(如B站部分页面),使用

- 查看网页源码(Ctrl+U)或开发者工具(F12)中的Network选项卡,定位视频数据请求

2. 核心工具选择

Python

# 基础工具链

import requests # HTTP请求

from bs4 import BeautifulSoup # HTML解析

from selenium import webdriver # 动态页面渲染

import json # 处理API返回数据

import re # 正则表达式匹配

# 可选扩展库

from fake_useragent import UserAgent # 随机UA

import pandas as pd # 数据存储

3. 动态内容抓取方案

当视频数据通过AJAX加载时(如抖音):

Python

from selenium.webdriver.chrome.options import Options

# 配置无头浏览器

chrome_options = Options()

chrome_options.add_argument("--headless") # 无界面模式

chrome_options.add_argument(f"user-agent={UserAgent().random}") # 随机UA

driver = webdriver.Chrome(options=chrome_options)

driver.get("https://www.douyin.com/video/123456")

# 等待动态加载(显式/隐式等待)

driver.implicitly_wait(10)

# 提取视频元数据

video_data = driver.execute_script("""

return window.__INITIAL_STATE__.videoModule

""") # 抖音的全局数据对象

4. API直接请求方案

若网站提供API接口(如YouTube):

Python

headers = {

"User-Agent": UserAgent().random,

"X-Requested-With": "XMLHttpRequest"

}

# 示例:快手视频API

api_url = "https://api.kuaishou.com/rest/r/feed"

params = {

"count": 20,

"page": 1,

"token": "xxx"# 需实际获取

}

response = requests.get(api_url, headers=headers, params=params)

video_list = response.json()["data"]["feeds"]

5. 视频文件下载

获取直链后下载:

Python

defdownload_video(url, save_path):

headers = {'Referer': 'https://www.target-domain.com/'} # 关键:添加来源头

with requests.get(url, headers=headers, stream=True) as r:

r.raise_for_status()

withopen(save_path, 'wb') as f:

for chunk in r.iter_content(chunk_size=8192):

f.write(chunk)

# 示例调用

download_video(video_list[0]["playAddr"], "video.mp4")

6. 反爬虫策略应对

防护手段 | 破解方案 |

|---|---|

User-Agent检测 | 使用fake_useragent轮换UA |

IP封锁 | 搭建代理池(如Scrapy+Scrapy-Proxy) |

验证码 | 接入打码平台或OCR识别 |

行为分析 | 随机延迟+模拟鼠标移动 |

Python

# 请求间隔随机化

import random

import time

time.sleep(random.uniform(1.5, 3.0)) # 随机等待

7. 数据存储方案

Python

# CSV存储示例

df = pd.DataFrame({

"title": [v["title"] for v in video_list],

"views": [v["play_count"] for v in video_list],

"url": [v["video_url"] for v in video_list]

})

df.to_csv("videos.csv", index=False)

# MongoDB存储(推荐)

from pymongo import MongoClient

client = MongoClient('mongodb://localhost:27017/')

db = client['video_db']

db.videos.insert_many(video_list)

注意事项

法律合规:检查robots.txt文件,如https://www.douyin.com/robots.txt

版权风险:仅抓取公开数据,避免下载受版权保护内容

频率控制:单IP请求频率建议≤5次/秒

数据清洗:视频标题常含特殊字符,需统一编码处理:

Python

title = title.encode('utf-8', 'ignore').decode('utf-8')本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录