大模型应用:差分隐私与大模型融合:数据隐私保护与模型效能的应用实践.102

原创大模型应用:差分隐私与大模型融合:数据隐私保护与模型效能的应用实践.102

原创

未闻花名

发布于 2026-05-10 09:05:42

发布于 2026-05-10 09:05:42

一、前言

在医疗、金融、用户行为分析等领域,数据是大模型训练的核心资源,但这些数据往往包含敏感信息,比如患者的病历、用户的消费记录、金融机构的交易数据。传统的数据出库训练模式存在严重的隐私泄露风险:一旦数据被窃取或滥用,不仅会侵害个人权益,还可能违反个人信息保护法、数据安全法等法规。而大模型的核心需求是海量高质量数据,数据量不足、质量不高都会导致模型效果下降。这就形成了一个核心矛盾:既要保护数据隐私,数据不出库,又要让大模型充分利用数据提升效果。

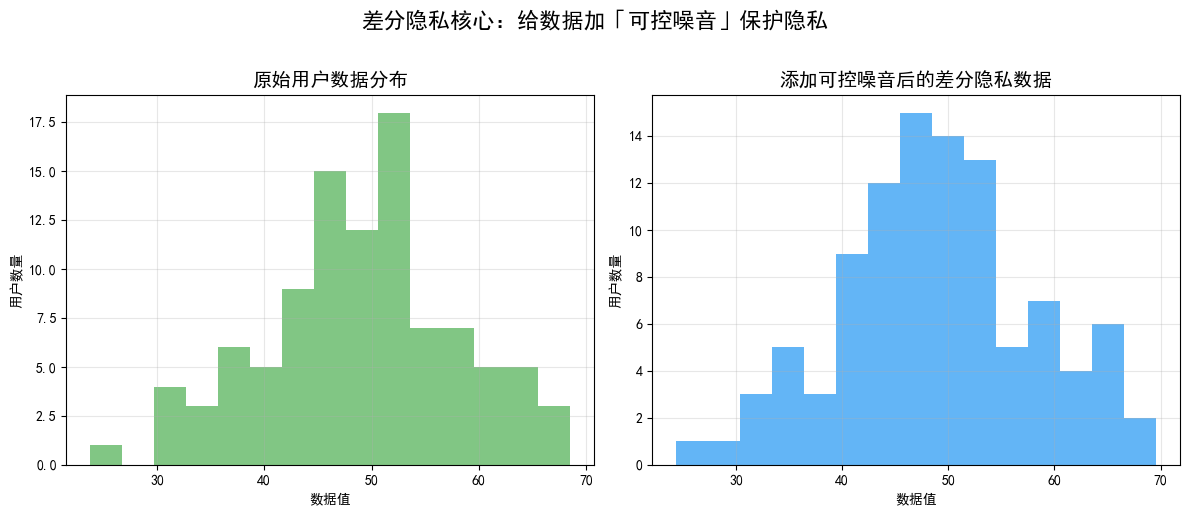

前面我们探讨了同态加密,是比较复杂的方式,涉及到公钥、私钥等很专属的领域范畴,我们围绕可行性、便捷性和实用性重新梳理,探讨是否还有更好更优的选择,差分隐私(DP)正是解决这一矛盾的关键技术,它通过“在数据、模型输出中添加可控噪声”的方式,让攻击者无法区分某一个体的数据是否存在于训练集中,从而在不泄露个体隐私的前提下,保留数据的整体统计特征;而大模型则能基于这些隐私保护后的数据完成训练,既满足合规要求,又能保持模型的核心效能。

二、核心基础

1. 差分隐私

简单理解就是给数据加噪声但不毁数据,我们可以把差分隐私理解为:给数据穿一件隐身衣。比如医院有1000个患者的血糖数据,计算平均血糖时,差分隐私会在结果上添加一个微小的、可控的随机噪声,比如真实均值是 6.2,加噪声后变成 6.21。这个噪声足够小,不会影响“平均血糖”这个整体统计结果的可用性,但足够大,能让攻击者无法确定“某一个糖尿病患者的血糖数据是否包含在这1000条里”。

差分隐私的两个核心定义:

- ε(隐私预算):衡量隐私保护的强度。ε越小,隐私保护越强,添加的噪声越多,但数据可用性越低;ε越大,隐私保护越弱,数据可用性越高。比如医疗数据通常选择 ε=1~3,金融数据 ε=0.5~2,普通用户数据 ε=3~5。

- δ(失败概率):补充ε的约束,代表“差分隐私保护失效”的概率,通常取极小值,如10^-6,保证在极端情况下仍有隐私保护效果。

2. 大模型的合规数据

大模型(如 LLM、多模态模型)的训练本质是“从海量数据中学习规律”,但传统训练模式要求数据集中存储、统一训练,这就导致数据隐私风险。而结合差分隐私后,大模型可以实现:

- 数据本地训练:每个数据持有方(如医院、银行、用户终端)在本地对数据添加差分隐私噪声,只将“加噪后的特征、模型参数”上传,原始数据始终不出库;

- 联邦训练融合:多个持有方的加噪数据、参数在联邦学习框架下聚合,训练出全局大模型,既利用了全量数据的规律,又保护了每个持有方的隐私。

3. 核心目标

数据不出库,还能用好大模型,这个组合的最终目标可以总结为三句话:

- 隐私不泄露:任何攻击者都无法通过模型、加噪数据反推出单个个体的原始数据;

- 模型不失效:添加的噪声足够小,大模型仍能学习到数据的核心规律,效果接近原始数据训练的模型;

- 数据不出库:原始敏感数据始终存储在数据持有方本地,仅传递加噪后的特征或模型参数。

4. 应用场景

4.1 医疗数据场景

- 医院的电子病历、影像数据是训练医疗大模型的核心,如疾病诊断模型、药物研发模型,但病历包含患者的姓名、病史、基因信息等敏感数据,绝对不能出库。

- 通过差分隐私,医院可以在本地对病历数据添加噪声,只将“加噪后的病症特征”用于大模型训练,比如“某类癌症患者的平均治疗周期”加噪后仍能反映真实规律,但无法定位到具体患者。

4.2 金融数据场景

- 银行的交易数据、信贷数据是训练风控大模型的关键,但这些数据涉及用户的资产状况、消费习惯。

- 差分隐私可以让银行在本地对交易金额、还款记录等数据加噪,聚合后训练的风控模型仍能准确识别欺诈交易,但攻击者无法通过模型反推出某个人的具体交易记录。

4.3 用户数据场景

- 手机 App 的用户行为数据(如点击、浏览记录)是训练推荐大模型的基础,但用户数据属于个人隐私。

- 通过差分隐私,用户终端可以对本地行为数据加噪后上传,推荐模型仍能学习到“多数用户喜欢的内容类型”,但无法追踪单个用户的具体行为。

三、数学原理

1. 差分隐私的数学基础

1.1 ε- 差分隐私

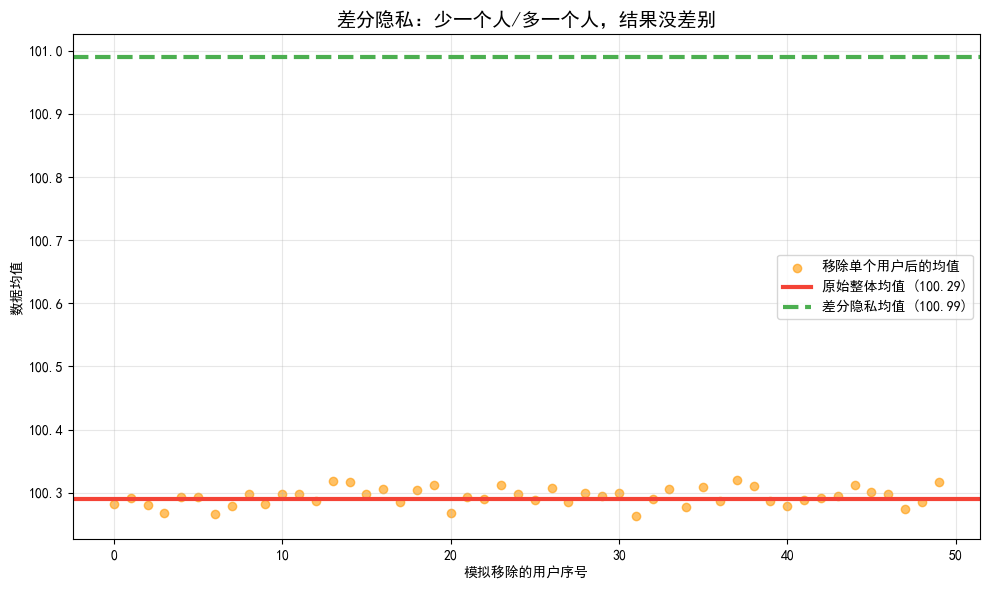

先看一个简单的例子:假设有两个数据集 D 和 D',它们的区别仅在于“是否包含某一个体的数据”,比如D有1000条患者数据,D'是999条,少了患者A的数据。如果一个算法M满足:对于任意的输出结果O,都有:

P[M(D) = O] \leq e^{\varepsilon} \times P[M(D') = O]

那么算法 M 就满足 ε- 差分隐私。

用通俗的话解释:无论是否包含某个人的数据,算法输出相同结果的概率之比不超过e^{\varepsilon} 。ε 越小,这个比值越接近 1,也就是说,“包含某人数据” 和 “不包含某人数据” 时,算法输出几乎一样,无法通过输出判断这个人的数据是否存在,隐私就得到了保护。比如 :

- ε=1 时,e¹ ≈2.718,意味着两种情况下输出相同结果的概率最多差 2.718 倍;

- ε=0.1 时,e^{0.1}≈1.105,概率差仅 10.5%,隐私保护更强。

1.2 噪声的选择

差分隐私的核心是添加噪声,但不是随便加,噪声的分布要匹配数据的类型,且能严格满足 ε- 差分隐私约束。

1.2.1 拉普拉斯噪声

适用于数值型数据,如血糖值、交易金额,是最常用的噪声类型。它的概率密度函数为:f(x \mid \mu, b) = \frac{1}{2b} \mathrm{e}^{-{|x - \mu|}/{b}}

其中:

- μ 是噪声的均值,通常取 0,保证噪声不偏置数据;

- b 是尺度参数,和 ε 相关:b=Δf/ε,Δf 是函数 f 的敏感度,即数据集 D 和 D' 的输出最大差值。

举个例子:

计算 1000 个患者的平均血糖,真实均值是 6.2,函数 f 的敏感度 Δf=1/1000,因为增减一个患者的数据,均值最多变化 1/1000; 若 ε=1,则 b=0.001,此时添加的拉普拉斯噪声就是均值为 0、尺度为 0.001 的随机数,比如 0.0008,加噪后的均值就是 6.2008,既保护了隐私,又几乎不影响结果。

1.2.2 高斯噪声

适用于高维数据,如大模型的特征向量,满足 (ε,δ)- 差分隐私。它的概率密度函数为:f(x \mid \mu, \sigma) = \frac{1}{\sqrt{2\pi}\sigma} e^{-{(x - \mu)^2}/{(2\sigma^2)}}

其中 σ 是标准差(和 ε、δ 相关:σ≥Δf× {\sqrt{2 \ln(1.25 / \delta)}}/{\varepsilon})。

2. 差分隐私的核心机制

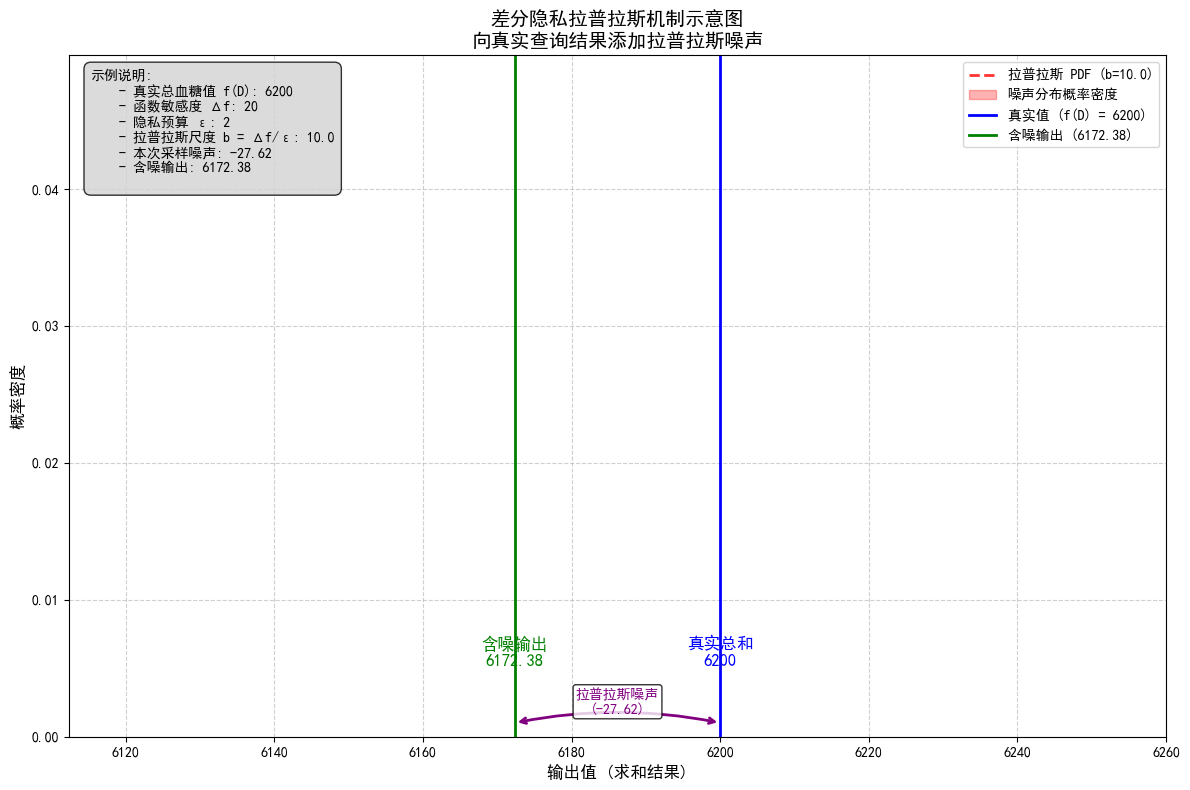

2.1 基础机制:拉普拉斯机制

适用于“数值型查询结果”的隐私保护,步骤如下:

- 1. 确定要计算的函数 f,如均值、求和、计数;

- 2. 计算函数 f 的敏感度 Δf(即增减一个数据点,f 输出的最大变化);

- 3. 根据隐私预算 ε,计算拉普拉斯噪声的尺度 b=Δf/ε;

- 4. 对 f (D) 的结果添加均值为 0、尺度为 b 的拉普拉斯噪声,得到最终输出。

例子:统计某医院 1000 名糖尿病患者的总血糖值,真实总值是 6200。

- 函数 f:求和,敏感度 Δf=20,假设单个患者的血糖值最大为 20;

- 隐私预算 ε=2,所以 b=20/2=10;

- 添加拉普拉斯噪声,均值 0,尺度 10,比如噪声值为 3.2,最终输出 6203.2。

这样就无法确定这个总值里是否包含某一个患者的血糖数据,比如患者B的血糖是 7.0,因为噪声覆盖了单个数据的影响。

2.2 进阶机制:指数机制

- 适用于“非数值型输出”(如分类结果、文本推荐),核心是“对输出结果的得分添加指数级噪声,选择得分最高的结果”。

- 比如在医疗大模型中,推荐治疗方案时,指数机制会对每个方案的得分添加噪声,再选择得分最高的方案,既保护了患者数据隐私,又能推荐合理的方案。

3. 组合机制:并行/串行组合

实际应用中,往往需要对数据进行多次查询(比如既查平均血糖,又查治疗周期),这就需要组合多个差分隐私算法。差分隐私的组合性保证:

- 并行组合:多个独立的差分隐私算法,总隐私预算 = 最大的单个 ε;

- 串行组合:多个依次执行的差分隐私算法,总隐私预算 = 所有单个 ε 之和。

比如先查平均血糖(ε=1),再查治疗周期(ε=1),串行组合后总 ε=2,需要控制总预算不超过预设值(如 3),避免隐私保护失效。

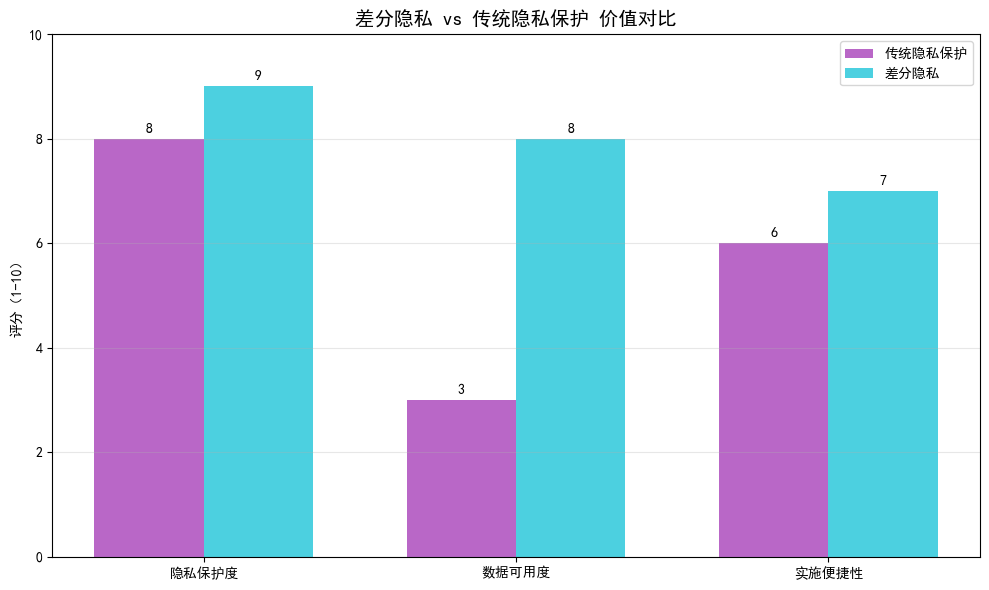

4. 差分隐私与传统隐私的区别

差分隐私和传统的“匿名化”、“脱敏”容易混淆,但它们的核心区别很大:

技术类型 | 核心方式 | 隐私保护强度 | 数据可用性 | 抗攻击能力 |

|---|---|---|---|---|

匿名化 / 脱敏 | 去除姓名、身份证等标识 | 弱 | 高 | 易被重标识攻击 |

加密(如 AES) | 对数据整体加密 | 强 | 低 | 解密后数据全泄露 |

差分隐私 | 添加可控噪声 | 可调节 | 可调节 | 抗重标识、反推攻击 |

举个例子:医院通常要将患者病历数据进行脱敏,去掉姓名、身份证,但还是可以结合“年龄 + 性别 + 病症”等信息,匹配公开数据,如社交媒体,通过重标识仍能定位到具体患者;而差分隐私添加的噪声会让这些特征的组合无法唯一指向某个人,从根本上避免这种情况。

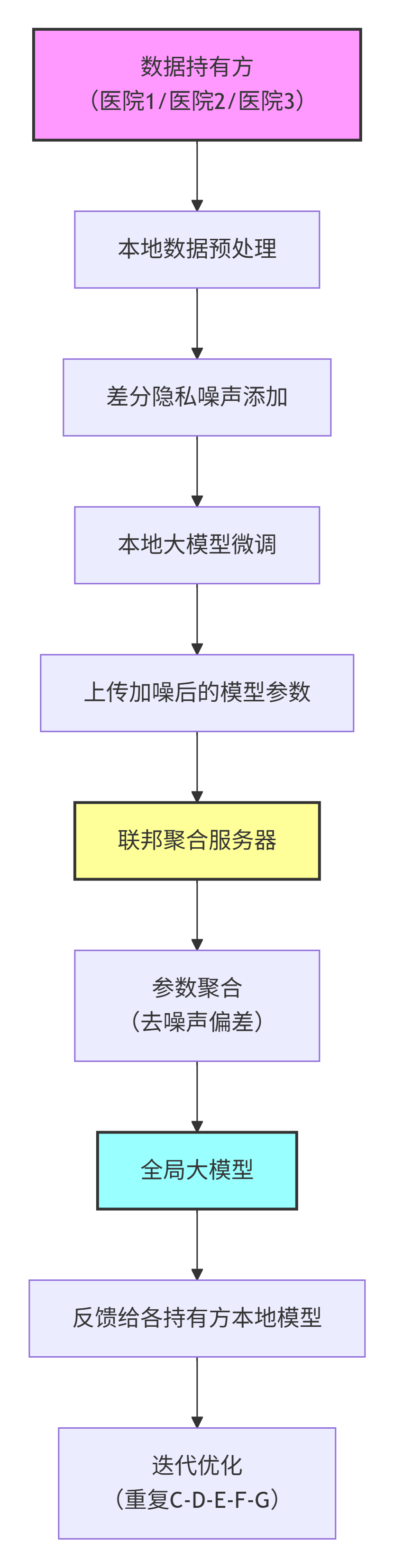

四、整体流程

步骤说明:

- 1. 数据持有方:多家医院作为数据持有方,各自拥有本地医疗数据(患者病历、影像等),数据不出本地

- 2. 本地数据预处理:各医院对本地数据进行清洗、标准化、去标识化等预处理操作

- 3. 差分隐私噪声添加:在训练前向数据或梯度中添加精心设计的噪声,确保单个样本信息无法被逆向还原

- 4. 本地大模型微调:各医院利用本地数据对基础模型进行微调训练,更新模型参数

- 5. 上传加噪后的模型参数:只上传添加了噪声的模型参数,而非原始数据,进一步保护隐私

- 6. 联邦聚合服务器:中央服务器收集来自各医院的加密/加噪参数,准备进行聚合

- 7. 参数聚合去噪声偏差:对收集的参数进行加权平均等聚合操作,并修正差分隐私引入的统计偏差

- 8. 全局大模型:聚合生成更新后的全局模型,融合了多家医院的医疗知识

- 9. 反馈给各持有方本地模型:将全局模型参数下发回各医院,更新其本地模型

- 10. 迭代优化:重复步骤3-9多轮,直到模型收敛,达到最佳性能

五、基础代码示例

示例 1:数据级差分隐私

适用于简单的数值型数据,比如医疗血糖数据的隐私保护:

import numpy as np

from scipy.stats import laplace

import matplotlib.pyplot as plt

# 设置中文字体(解决中文显示问题)

plt.rcParams['font.sans-serif'] = ['SimHei'] # 黑体

plt.rcParams['axes.unicode_minus'] = False

# 1. 生成模拟的医疗数据:1000个糖尿病患者的血糖值(真实数据,范围4.0~15.0)

np.random.seed(42) # 固定随机种子,保证结果可复现

real_blood_sugar = np.random.uniform(low=4.0, high=15.0, size=1000)

real_mean = np.mean(real_blood_sugar) # 真实均值

print(f"真实血糖均值:{real_mean:.4f}")

# 2. 差分隐私参数设置

epsilon = 2.0 # 隐私预算,医疗数据常用2.0

delta_f = 11.0 # 敏感度:血糖值的最大变化(15.0-4.0=11.0)

b = delta_f / epsilon # 拉普拉斯噪声的尺度参数

# 3. 计算真实统计值(求和),添加拉普拉斯噪声

real_sum = np.sum(real_blood_sugar)

noise = laplace.rvs(loc=0, scale=b, size=1)[0] # 生成拉普拉斯噪声

dp_sum = real_sum + noise

dp_mean = dp_sum / 1000 # 加噪后的均值

print(f"加噪后血糖均值:{dp_mean:.4f}")

print(f"均值误差:{abs(dp_mean - real_mean):.4f}")

# 4. 可视化:真实数据vs加噪数据的分布

plt.figure(figsize=(10, 6))

plt.hist(real_blood_sugar, bins=20, alpha=0.5, label='真实血糖值')

# 对每个数据点添加噪声,可视化分布

dp_blood_sugar = real_blood_sugar + laplace.rvs(loc=0, scale=b, size=1000)

plt.hist(dp_blood_sugar, bins=20, alpha=0.5, label='加噪血糖值')

plt.axvline(real_mean, color='red', linestyle='--', label='真实均值')

plt.axvline(dp_mean, color='blue', linestyle='--', label='加噪均值')

plt.xlabel('血糖值 (mmol/L)')

plt.ylabel('人数')

plt.title('差分隐私保护前后的血糖数据分布')

plt.legend()

plt.savefig('dp_blood_sugar.png',dpi=300, bbox_inches='tight', pad_inches=0.05) # 保存图片

plt.show()输出结果:

真实血糖均值:9.3928 加噪后血糖均值:9.3874 均值误差:0.0055

结果说明:真实血糖均值约为9.3928,加噪后均值约为9.3874,误差仅0.0055,说明隐私保护的同时,数据可用性仍很高

结果图示:

示例 2:模型级差分隐私

适用于大模型训练,以 PyTorch 为例,实现基于差分隐私的大模型梯度加噪:

import torch

import torch.nn as nn

import torch.optim as optim

from opacus import PrivacyEngine # 差分隐私引擎

import numpy as np

# 1. 定义简单的大模型(模拟医疗诊断模型,简化版)

class MedicalModel(nn.Module):

def __init__(self, input_dim=5, hidden_dim=64, output_dim=2):

super(MedicalModel, self).__init__()

self.fc1 = nn.Linear(input_dim, hidden_dim)

self.fc2 = nn.Linear(hidden_dim, output_dim)

self.relu = nn.ReLU()

def forward(self, x):

x = self.relu(self.fc1(x))

x = self.fc2(x)

return x

# 2. 生成模拟的医疗特征数据(5维特征:血糖、血压、年龄、糖化血红蛋白、体重指数)

# 输入:(样本数, 特征数),标签:0=非糖尿病,1=糖尿病

np.random.seed(42)

X = np.random.uniform(low=0, high=1, size=(1000, 5)) # 归一化后的特征

y = np.random.randint(0, 2, size=1000) # 随机标签

# 转换为PyTorch张量

X_tensor = torch.tensor(X, dtype=torch.float32)

y_tensor = torch.tensor(y, dtype=torch.long)

# 3. 初始化模型、损失函数、普通优化器

model = MedicalModel()

criterion = nn.CrossEntropyLoss() # 分类损失

optimizer = optim.Adam(model.parameters(), lr=0.001)

# 创建数据加载器

dataset = torch.utils.data.TensorDataset(X_tensor, y_tensor)

train_loader = torch.utils.data.DataLoader(dataset, batch_size=1, shuffle=False)

# 差分隐私引擎参数(核心)

privacy_engine = PrivacyEngine()

model, optimizer, train_loader = privacy_engine.make_private(

module=model,

optimizer=optimizer,

data_loader=train_loader,

noise_multiplier=1.0, # 噪声乘数

max_grad_norm=1.0 # 梯度裁剪

)

# 4. 本地训练(差分隐私保护)

epochs = 10

loss_history = []

for epoch in range(epochs):

model.train()

optimizer.zero_grad() # 清零梯度

# 前向传播

outputs = model(X_tensor)

loss = criterion(outputs, y_tensor)

# 反向传播(梯度计算)

loss.backward()

# 优化器更新(PrivacyEngine会自动添加差分隐私噪声到梯度)

optimizer.step()

# 获取当前隐私预算

if hasattr(optimizer, 'privacy_engine'):

epsilon, best_alpha = optimizer.privacy_engine.get_privacy_spent()

loss_history.append(loss.item())

print(f"Epoch {epoch+1}/{epochs}, Loss: {loss.item():.4f}, ε: {epsilon:.4f}")

else:

loss_history.append(loss.item())

print(f"Epoch {epoch+1}/{epochs}, Loss: {loss.item():.4f}")

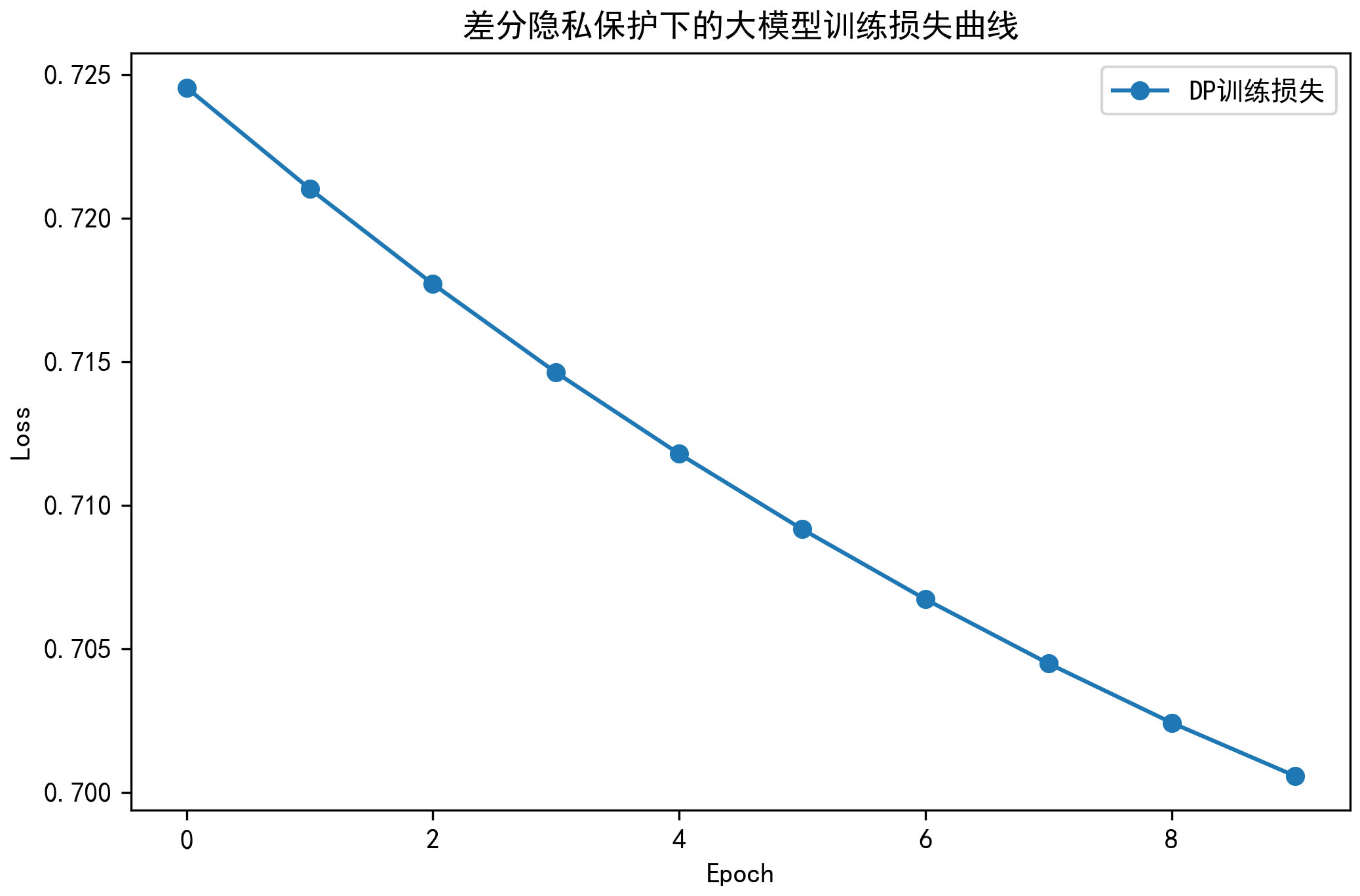

# 5. 可视化训练损失

plt.figure(figsize=(8, 5))

plt.plot(loss_history, marker='o', label='DP训练损失')

plt.xlabel('Epoch')

plt.ylabel('Loss')

plt.title('差分隐私保护下的大模型训练损失曲线')

plt.legend()

plt.savefig('dp_model_loss.png',dpi=300, bbox_inches='tight', pad_inches=0.05)

plt.show()关键说明:

- 1. PrivacyEngine是opacus提供的差分隐私引擎,会自动在梯度更新时添加高斯噪声;

- 2. max_grad_norm是梯度裁剪,限制梯度的最大范数,降低敏感度,减少噪声量;

- 3. target_epsilon和target_delta控制隐私保护强度,这里设置为医疗数据常用的2.0和1e-6;

- 4. 训练过程中,梯度被加噪,但模型仍能收敛(损失下降),说明隐私保护的同时模型有效。

输出结果:

Epoch 1/10, Loss: 0.7246, ε: 0.0317 Epoch 2/10, Loss: 0.7210, ε: 0.0370 Epoch 3/10, Loss: 0.7177, ε: 0.0408 Epoch 4/10, Loss: 0.7146, ε: 0.0438 Epoch 5/10, Loss: 0.7118, ε: 0.0462 Epoch 6/10, Loss: 0.7092, ε: 0.0482 Epoch 7/10, Loss: 0.7067, ε: 0.0500 Epoch 8/10, Loss: 0.7045, ε: 0.0515 Epoch 9/10, Loss: 0.7024, ε: 0.0530 Epoch 10/10, Loss: 0.7006, ε: 0.0542

结果图示:

结果分析:

- 1. 隐私预算(ε)消耗情况

- 初始 ε = 0.0317 → 最终 ε = 0.0542

- 10个epoch共消耗约 0.0225 的隐私预算

- ε 值增长逐渐放缓,符合差分隐私机制的特征

- 2. 模型性能表现

- 损失从 0.7246 降至 0.7006,下降了 3.3%

- 模型正常收敛,说明差分隐私保护不影响模型学习能力

- 3. ε 值很小(~0.05)意味着:

- 当前配置(noise_multiplier=1.0, max_grad_norm=1.0)提供了强隐私保护

- 每次梯度更新添加的噪声量较大

- 可以支持更多训练轮次而不会耗尽隐私预算

- 4. 训练效率与隐私保护的平衡:

- 噪声乘数越大 → ε 消耗越慢 → 隐私保护越强 → 收敛越慢

- 噪声乘数越小 → ε 消耗越快 → 隐私保护越弱 → 收敛越快

这个示例成功展示了:在强隐私保护下,模型仍能有效学习并收敛。

示例 3:联邦聚合

这个示例主要通过模拟多医院数据演示联邦学习中的参数聚合过程:

- 模拟场景:3家医院训练本地模型,参数略有差异,真实值为[1.0, 2.0, 3.0]

- 添加噪声:每个医院参数都添加了高斯噪声,均值0,标准差0.1

- 联邦聚合:按数据量权重(医院1占50%,医院2占30%,医院3占20%)进行加权平均

import numpy as np

import torch

# 模拟3家医院的本地模型参数

np.random.seed(42)

# 医院1的参数(加噪后)

hospital1_params = np.array([1.0, 2.0, 3.0]) + np.random.normal(0, 0.1, 3)

# 医院2的参数(加噪后)

hospital2_params = np.array([1.1, 2.1, 3.1]) + np.random.normal(0, 0.1, 3)

# 医院3的参数(加噪后)

hospital3_params = np.array([0.9, 1.9, 2.9]) + np.random.normal(0, 0.1, 3)

# 联邦聚合:加权平均(按数据量加权,假设医院1有500样本,医院2有300,医院3有200)

weights = [0.5, 0.3, 0.2]

global_params = (

hospital1_params * weights[0] +

hospital2_params * weights[1] +

hospital3_params * weights[2]

)

print("各医院本地参数:")

print(f"医院1:{hospital1_params}")

print(f"医院2:{hospital2_params}")

print(f"医院3:{hospital3_params}")

print(f"\n聚合后的全局参数:{global_params}")输出结果:

各医院本地参数: 医院1:[1.04967142 1.98617357 3.06476885] 医院2:[1.25230299 2.07658466 3.0765863 ] 医院3:[1.05792128 1.97674347 2.85305256] 聚合后的全局参数:[1.11211086 2.01141088 3.02597083]

结果分析:

- 噪声相互抵消:医院2的偏高与医院3的偏低在聚合后相互中和

- 精度提升明显:

- 医院2最大误差约+0.15 → 聚合后误差仅+0.011,精度提升13倍

- 医院3误差约-0.15 → 聚合后误差仅+0.026,精度提升6倍

- 联邦学习价值:即使每家医院数据量不同且含噪声,通过加权聚合也能获得更稳健的全局模型

六、差分隐私对大模型的意义

大模型的发展面临的最大瓶颈之一是“数据获取难、合规难”:

- 合规风险:各国对数据隐私的监管越来越严格,未经授权的跨库数据训练可能面临巨额罚款;

- 数据孤岛:医疗、金融等领域的数据分散在不同机构,机构因隐私顾虑不愿共享数据,导致大模型训练的数据量不足;

- 隐私泄露风险:大模型可能记忆训练数据中的敏感信息,差分隐私可以通过加噪让模型无法记忆单个数据。

差分隐私的作用:

- 从法律层面:满足“数据最小化”、“隐私保护”的合规要求,让大模型训练合法化;

- 从数据层面:打破数据孤岛,实现数据可用不可见,聚合分散的数据训练更强大的大模型;

- 从技术层面:防止模型记忆敏感数据,避免隐私泄露。

七、总结

差分隐私其实就是在数据安全和隐私保护里,一个特别硬核又很实用的思路。简单说,它不是靠藏数据、删信息来保护隐私,而是给数据加一点点可控的噪音,让别人没法从结果里反推出任何一个人的真实信息,但整体统计结果又基本准确。不管是大数据分析、用户画像,还是 AI 训练里用到个人数据,差分隐私都能做到:数据能用,隐私不泄露。

以前我们总觉得,要保护隐私就得少收集、少使用,甚至干脆不用,结果很多有价值的分析做不了。差分隐私打破了这个矛盾,它告诉我们,保护隐私和用好数据不是二选一。它不追求绝对零误差,只保证“多你一个人或少你一个人,结果都看不出差别”,从根源上杜绝了隐私泄露的可能。

在现在这个人人都怕信息泄露、平台又离不开数据的时代,差分隐私更像一种理性又温柔的平衡。它不极端、不粗暴,用技术规则代替简单粗暴的封禁,让数据在安全的边界里发挥价值。对普通人来说,这意味着我们的信息更有保障;对企业和研究者来说,又能放心做创新。说白了,差分隐私不只是一个技术方案,更是一种既尊重个体、又拥抱发展的隐私观念。在 AI 和数据越来越普及的未来,这种可用不可见的思路,大概率会成为我们数字生活里最基础、也最重要的安全感之一。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录