计算机科学领域有哪些里程碑式的发现或理论,深刻改变了我们的生活?

计算机科学领域有哪些里程碑式的发现或理论,深刻改变了我们的生活?

chouheiwa

发布于 2026-05-06 21:29:04

发布于 2026-05-06 21:29:04

计算机科学领域有哪些里程碑式的发现或理论,深刻改变了我们的生活?

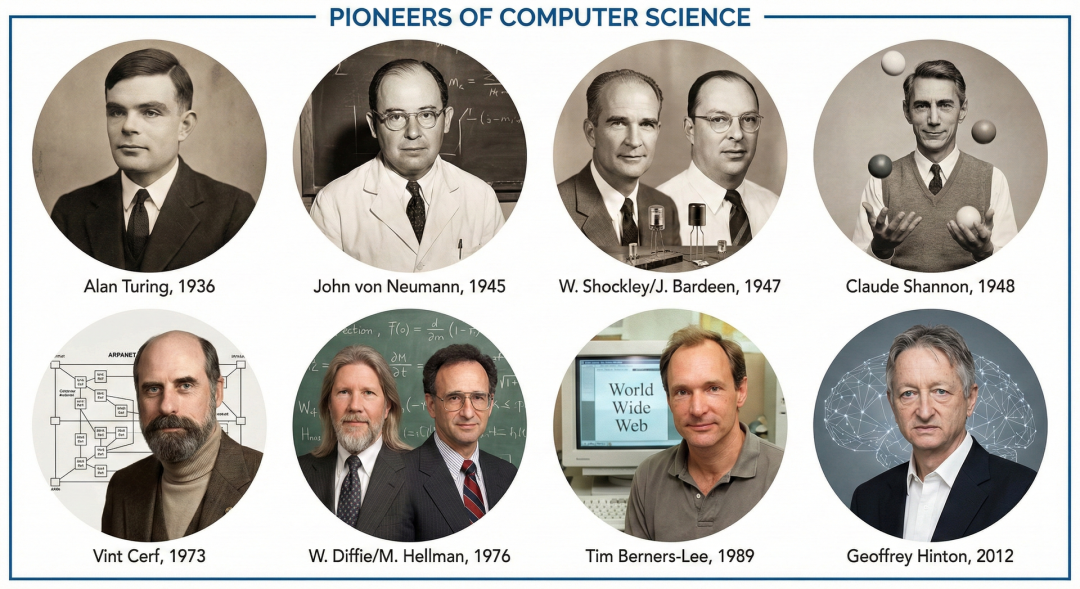

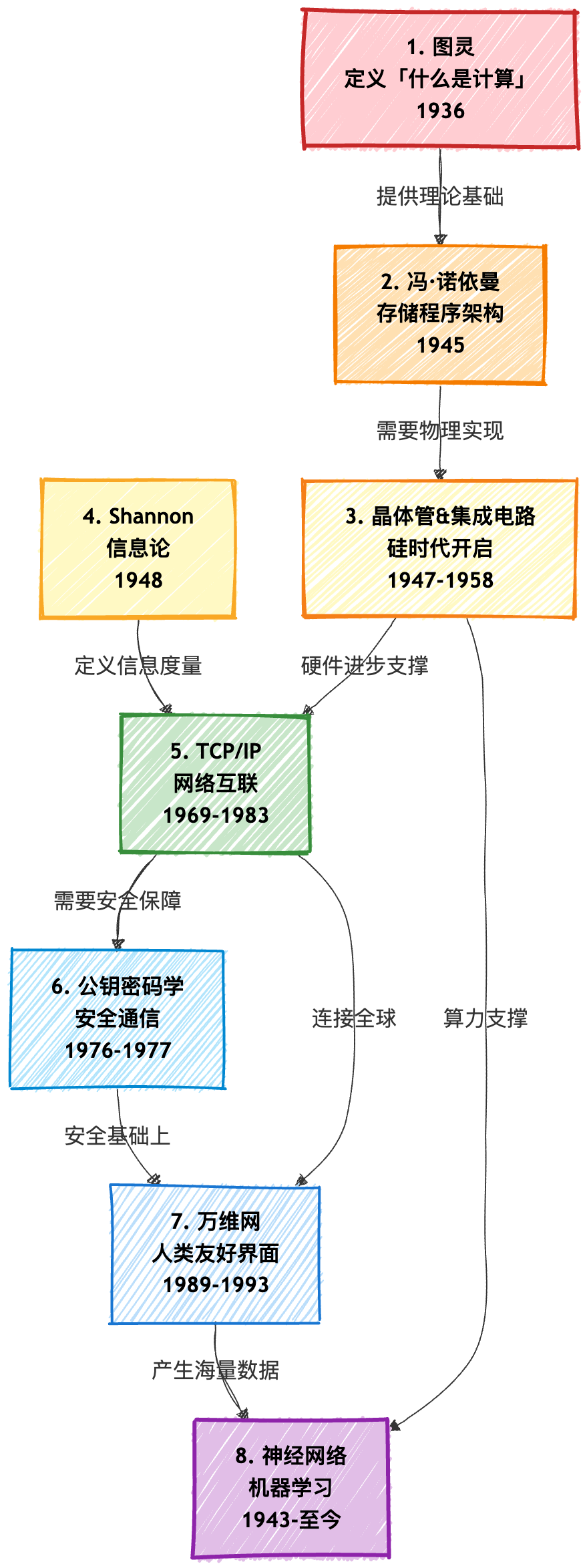

我挑了 8 个,按时间线串起来。不搞那种一人一句的百科式罗列,每个都往深了讲,讲到你能感受到这些东西为什么重要。

先说个大前提:这 8 个里程碑不是孤立的发明,而是一条因果链。前一个解决的问题,恰好是后一个的起点。看完你会发现,我们今天习以为常的数字生活,就是踩着这条链子一步步走过来的。

1. 图灵定义了「什么是计算」(1936)

1928 年,数学家希尔伯特提出了一个野心勃勃的问题:能不能找到一个机械化的方法,判定任意数学命题的真假?这就是著名的「判定问题」(Entscheidungsproblem)[1]。哥德尔 1931 年的不完备定理已经动摇了数学基础,但判定问题本身还悬而未决。

1936 年 5 月 28 日,24 岁的 Alan Turing 向伦敦数学学会提交了那篇改变一切的论文:On Computable Numbers, with an Application to the Entscheidungsproblem[2]。据说灵感来自 1935 年夏天,他躺在剑桥附近的格兰切斯特草地上发呆[3]的时候。

他想象了一台极其简单的抽象设备:一条无限长的纸带、一个读写头、一组有限状态和转换规则。就这么点东西,却能执行任何可以用规则描述的计算。这篇论文真正炸裂的概念是通用图灵机:一台能模拟任意其他图灵机的机器,只要把目标机器的描述当作数据写在纸带上就行。说白了,这就是「存储程序」思想的理论源头,程序本身就是数据。同时,图灵用对角线论证法证明了「停机问题」不可判定[4],从而否定了希尔伯特的判定问题。

普林斯顿的 Alonzo Church 用 lambda 演算独立得出了类似结论,两套体系后来被证明等价,称为 Church-Turing 论题[5]。图灵随后去普林斯顿跟 Church 读了博士,1938 年完成学位。

今天每一台可编程计算机,都是图灵通用机的物理实现。硬件和软件的区分、编程语言的存在、计算复杂性理论这个学科,全都可以追溯到这篇论文。二战期间图灵在布莱切利园设计了 Bombe 密码分析机[6](1940 年 3 月 14 日投入使用),据估计将战争缩短了两年。他把咖啡杯锁在暖气片上防被偷,骑车上班时戴防毒面具防花粉过敏。

图灵的个人命运令人唏嘘。1952 年因同性恋被定罪并遭化学阉割[7],1954 年 6 月 7 日死于氰化物中毒,年仅 41 岁。迟来的荣誉:ACM 图灵奖[8](1966 年设立)以他命名,伊丽莎白二世 2013 年 12 月 24 日颁发了追授的皇家赦免,2021 年 6 月 23 日(他的生日)他的肖像登上了英国 50 英镑纸币[9]。

2. 冯·诺依曼的 101 页报告让计算机变成通用工具(1945)

图灵解决了「什么能算」的问题,但实际造出来的机器还是得靠人肉接线来「编程」。ENIAC 在 1945 年建成[10],用了 17,468 根真空管,功耗 150 千瓦,重 30 吨,配置一次新计算可能要好几个星期,操作员得拨 3,000 个开关、接几十根线缆。

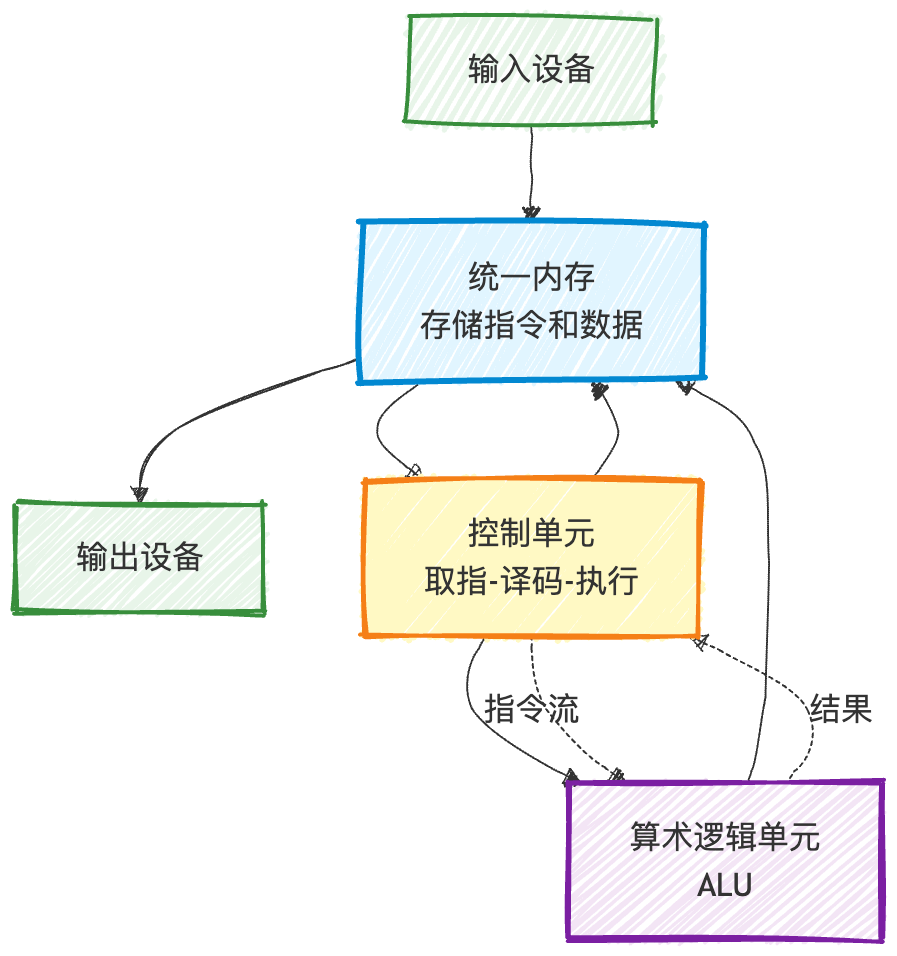

John von Neumann 改变了这一切。他的那份 101 页的手稿「First Draft of a Report on the EDVAC」[11],是他在普林斯顿和洛斯阿拉莫斯之间坐火车通勤时写的。1945 年 6 月 30 日由 Herman Goldstine 在摩尔电气工程学院印了 24 份油印本分发出去[12]。核心思想就一句话:指令和数据共享同一块内存。五个逻辑部件(算术单元、控制单元、统一内存、输入、输出)加上取指-译码-执行循环,定义了一个几乎延续至今的蓝图。

署名争议到现在都没停。报告上只写了冯·诺依曼一个人的名字,但存储程序概念其实是团队讨论的产物。Eckert 早在 1944 年 1 月就写了备忘录描述磁存储器方案[13],比冯·诺依曼介入早了八个月。报告的公开传播直接毁掉了 Eckert 和 Mauchly 的专利诉求,结下了几十年的梁子。更值得一提的是 ENIAC 的六位女程序员[14](Betty Holberton、Jean Bartik 等),在没有手册、没有安全许可的情况下对着蓝图编程,1946 年公开展示时连介绍都没有[15],新闻照片里把她们标注为「模特」。一直到 1997 年才被 WITI 授予技术名人堂[16]。

这套架构第一次完整跑起来,是 1948 年 6 月 21 日的 Manchester Baby(SSEM)[17]。只有 550 个电子管和 1,024 比特内存,花了 52 分钟、350 万次运算来求 262,144 的最大因数。设计者 Williams 回忆说:「显示管上的光点疯狂跳动......然后某天它停了下来,在预期的位置上,亮着预期的答案。」[18]

这套架构最大的软肋叫做冯·诺依曼瓶颈(John Backus 在 1977 年图灵奖演讲中命名)。数据在内存和处理器之间搬来搬去,在 AI 工作负载中大约消耗 90% 的能量[19]。现代 CPU 用缓存层次、流水线、乱序执行来缓解,但你手机、笔记本、服务器里的基本架构,和 1945 年那 101 页描述的本质上是一回事。

3. 晶体管和集成电路开启硅时代(1947–1958)

真空管让电子计算成为可能,但也让规模化几乎不可能。ENIAC 的 17,468 根管子平均每两天就坏一根,功耗 150 千瓦,占地 167 平米。

贝尔实验室的 Mervin Kelly 从 1936 年就开始招募固态物理学家,包括从 MIT 挖来的 William Shockley[20]。战后研究恢复,理论物理学家 John Bardeen 和实验物理学家 Walter Brattain 在 1947 年 12 月 16 日取得突破:Brattain 把一个金箔尖端压在锗晶体上,实现了音频全频段最高 100 倍的放大[21]。12 月 23 日向贝尔高层演示。1948 年 5 月,电气工程师兼科幻作家 John Robinson Pierce 把 transfer 和 resistor 拼在一起[22],造了「transistor」这个词。

内部斗争极其激烈。Shockley 因为没被列入最初的专利发明人而暴怒[23](他的场效应管概念被 1925 年 Lilienfeld 的专利抢了先),1947 年圣诞节期间在家秘密开发了更优的结型晶体管,然后禁止 Bardeen 和 Brattain 继续参与晶体管研究。Bardeen 1951 年离开贝尔实验室转投超导研究,最终成为唯一一个拿过两次诺贝尔物理学奖[24]的人(1956 和 1972)。

下一个飞跃源自「数字暴政」问题:电路越来越复杂,手工焊接几千个分立元件变得不可行。1958 年德州仪器全员休假期间,Jack Kilby 独自工作,在 9 月 12 日演示了第一块集成电路[25]:一块锗芯片上的移相振荡器。独立地,Fairchild 半导体的 Robert Noyce 在 1959 年 1 月提出了更优的单片方案,用平面工艺和铝互连线。Noyce 的设计成为所有现代 IC 的基础。Kilby 获得了 2000 年诺贝尔物理学奖[26],Noyce 1990 年已经去世无法分享。

Gordon Moore 1965 年在《Electronics》杂志上的文章[27]预测芯片上的元件数量每年翻倍(1975 年修正为每两年),他自己说这是「一个疯狂的外推」。这个预测保持了五十年:从 Kilby 的单个晶体管,到 Intel 4004(2,300 个晶体管,1971),到 NVIDIA GB202 GPU(超过 920 亿个晶体管,2025)。2024 年全球半导体销售额达到 6,305 亿美元[28]。1957 年从 Shockley 独裁管理的实验室出走的「八叛逆」创立 Fairchild,后来孵化出超过 2,000 家公司。这就是硅谷的起源故事。

4. Claude Shannon 给信息找到了度量单位(1948)

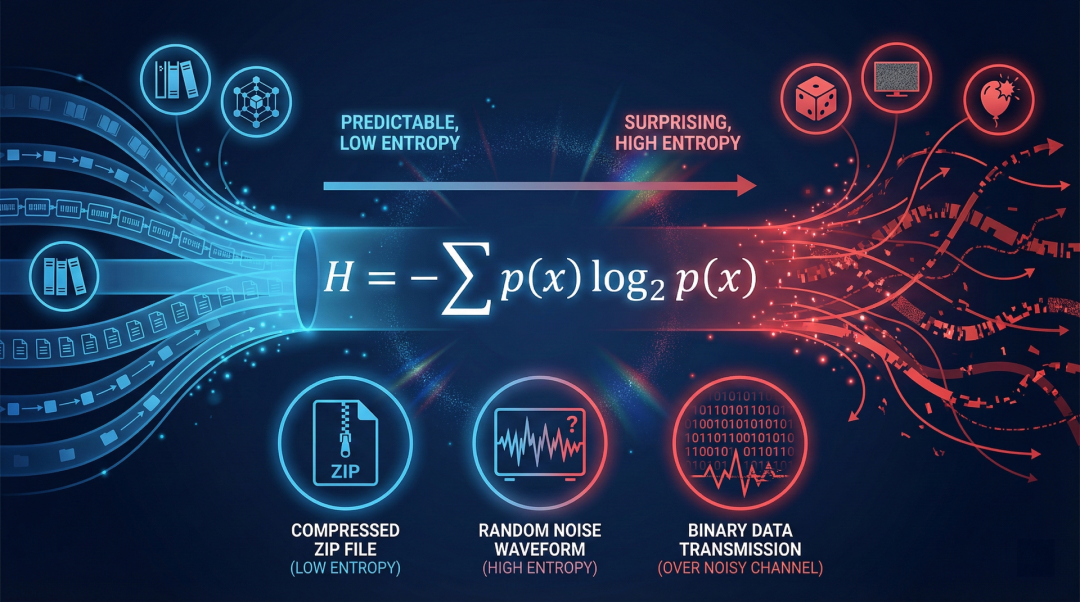

在 Shannon 之前,通信工程基本靠经验。工程师知道噪声会劣化信号,但没有任何数学框架能量化「信息」、确定压缩极限、或者证明在有噪声的信道上到底能不能实现无差错通信。

Shannon 1948 年发表在《贝尔系统技术杂志》上的 A Mathematical Theory of Communication[29],一口气解决了这三个问题。《科学美国人》后来称之为「信息时代的大宪章」[30]。

Shannon 引入了 bit(比特,这个词归功于 John W. Tukey)作为信息的基本单位,定义了信息熵[31] H = −Σ p(x) log₂ p(x)。他的信源编码定理证明数据可以压缩到熵值但不能更少,有噪信道编码定理[32]证明只要传输速率低于信道容量 C = B log₂(1 + S/N),就可以实现可靠通信。这个结论让当时的工程师震惊了,因为他们一直以为噪声会造成不可逾越的错误下限。

其实这不是 Shannon 第一次颠覆一个领域。他 1937 年的 MIT 硕士论文「A Symbolic Analysis of Relay and Switching Circuits」[33]证明布尔代数可以表示电路,把电路设计「从艺术变成了科学」。

今天每一项数字技术都运行在 Shannon 的框架内。ZIP、MP3、JPEG、H.265 都是信源编码定理的后代。5G 用的 LDPC 和 Polar 码在距离 Shannon 极限零点几个 dB 的地方工作。旅行者号探测器用基于他理论的卷积码从星际空间传回图像。

Shannon 本人也极其有趣。他在贝尔实验室的走廊里骑独轮车同时抛四个球,造过喷火小号和火箭动力飞盘。他 1985 年突然出现在布莱顿的信息论会议上[34],会议主席描述那个瞬间:「就像牛顿出现在了一个物理学会议上。」Shannon 2001 年 2 月 24 日去世[35],此前多年受阿尔茨海默症折磨,残忍的是,他已经无法理解自己的工作催生的互联网革命。

5. TCP/IP 把不兼容的网络缝成了一张网(1969–1983)

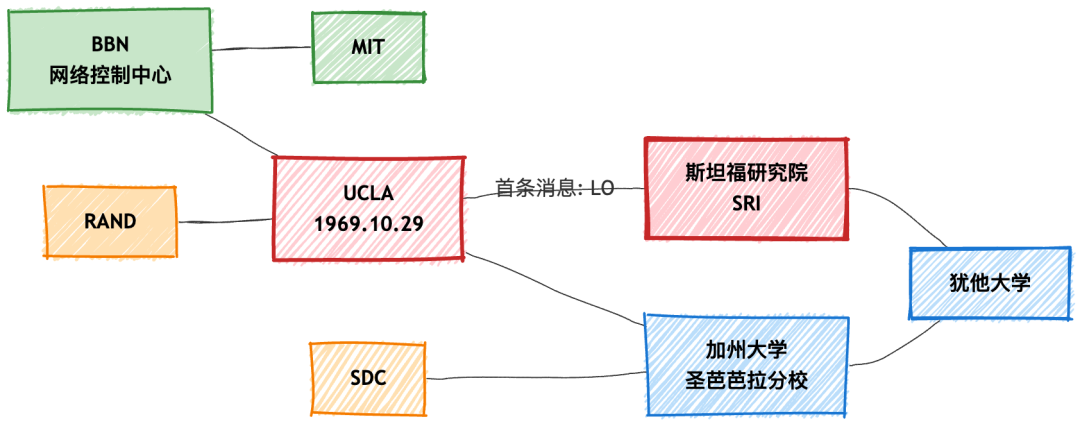

分组交换出现之前,所有电信都靠电路交换:两个通话方之间独占一条物理路径,对突发性数据流量浪费超过 90% 的带宽。RAND 公司的 Paul Baran[36](1960–1964)和英国国家物理实验室的 Donald Davies[37](1965)独立提出了分组交换。Davies 咨询了一位语言学家后选了 packet 这个词,因为它在各种语言里都好翻译。

ARPANET 的第一条消息发生在 1969 年 10 月 29 日晚 10:30[38]。UCLA 的学生 Charley Kline 在 Leonard Kleinrock 的指导下,试图向斯坦福研究院发送 LOGIN。输入 L,确认。输入 O,确认。输入 G,系统崩溃了。所以互联网的第一条消息是 LO。Kleinrock 后来说这有先见之明:「Lo and behold!(你瞧!)」[39]

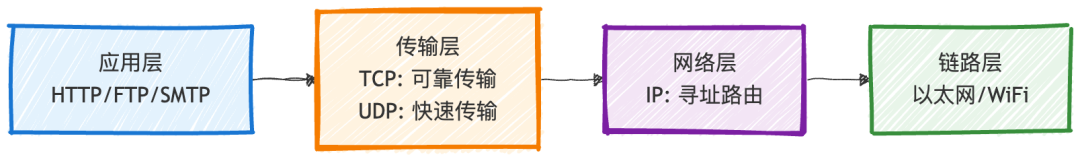

真正的架构突破是 Vint Cerf 和 Bob Kahn 1974 年 5 月的论文 A Protocol for Packet Network Intercommunication[40](IEEE Transactions on Communications)。他们设计的传输控制程序后来在 1978 年被拆分成 TCP[41] 和 IP[42] 两层:IP 负责寻址和路由,TCP 负责可靠有序传输,应用程序在上层自由发挥。1981 年 Saltzer、Reed 和 Clark 正式提出的端到端原则[43]保持网络核心简单、把智能推到边缘,让应用层可以无限创新。

1983 年 1 月 1 日,「旗日」(Flag Day)[44],ARPANET 的大约 400 台主机同时从 NCP 切换到 TCP/IP。这一天被广泛认为是现代互联网的生日。从 1969 年的 4 个节点,到 2025 年超过 60 亿用户和 300 多亿联网设备。

顺带提一下,1971 年 BBN 公司的 Ray Tomlinson[45] 创建了网络电子邮件,他选了 @ 符号,因为它不会出现在人名里而且逻辑上表示 at(在某处)。他跟同事说:「别告诉任何人,这不是我们该干的活。」[46]到 1973 年,电子邮件已经占了 ARPANET 全部流量的 75%[47],成了网络的第一个杀手级应用。

6. 公钥密码学解决了保密通信最古老的难题(1976–1977)

几千年来,所有加密都是对称的:同一把钥匙负责加密和解密。这造成了一个致命的鸡生蛋问题:要安全通信,你得先有一个安全信道来共享密钥。但如果你已经有了安全信道,还要加密干什么?

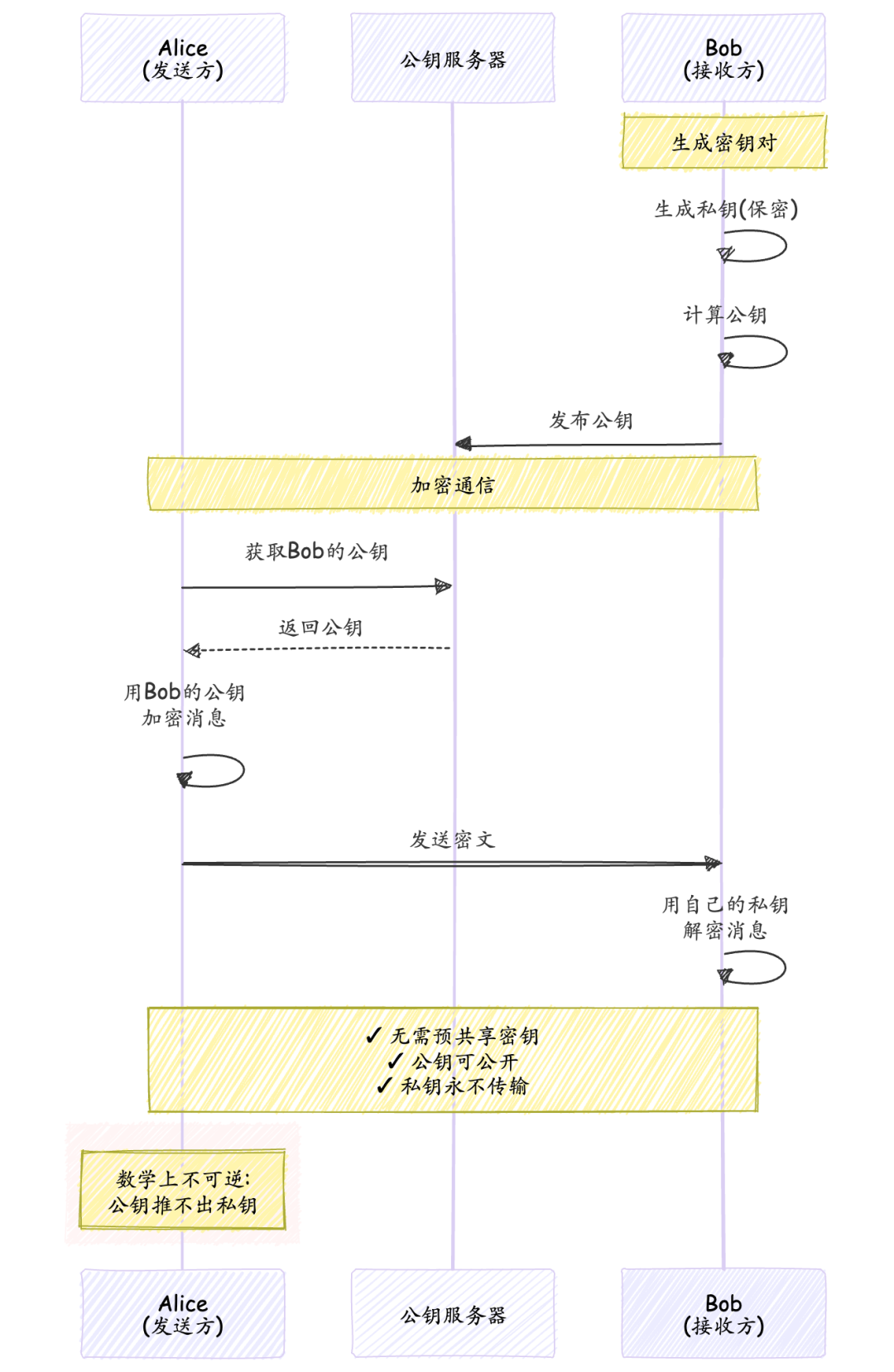

1976 年 11 月,Whitfield Diffie 和 Martin Hellman 发表了 New Directions in Cryptography[48](IEEE Transactions on Information Theory)。开篇就写:「我们正站在密码学革命的门槛上。」他们提出了非对称加密的概念:一把公开的公钥用于加密,一把数学上相关但计算上无法反推的私钥用于解密。

概念有了,但需要具体实现。MIT 的 Ron Rivest 和 Adi Shamir 花了一年提出各种单向函数,Leonard Adleman 花了一年把它们一个个破掉。突破发生在 1977 年逾越节。Rivest 在一个喝了 Manischewitz 葡萄酒的晚上失眠了[49],躺在沙发上翻数学教科书,到天亮时写出了一个完整的算法:基于大素数乘积难以分解的性质。RSA 算法 1978 年 2 月发表在《Communications of the ACM》上[50]。

但公众不知道的是,英国 GCHQ 更早就做到了。James Ellis 在 1970 年的一份机密报告中提出了「非秘密加密」[51]。1973 年,刚从剑桥毕业的 Clifford Cocks 在不到一个小时内独立发现了 RSA 算法[52],比 Rivest 等人早了四年。Malcolm Williamson 随后发现了等价于 Diffie-Hellman 的密钥交换。所有内容一直保密到 1997 年 12 月[53]。

今天 95% 以上的网络流量[54]通过公钥密码学保护的 HTTPS 传输。1990 年代的「密码战争」[55](包括 NSA 失败的 Clipper Chip 计划)确立了强加密作为公民权利。现在新的转型已经开始:NIST 在 2024 年 8 月 13 日发布了后量子密码学标准[56](FIPS 203、204、205),启动了为期八年的迁移,应对量子计算机对现有算法的威胁。到 2025 年底,52% 的人类网络流量已经使用了后量子加密[57]。

7. Tim Berners-Lee 给互联网装上了人类友好的界面(1989–1993)

1980 年代末互联网已经存在了,但用它需要掌握 FTP、Telnet 和各种命令行工具。在 CERN,几千名科学家使用着互不兼容的系统,信息在人员轮换中「不断丢失」。

1989 年 3 月 12 日,英国计算机科学家 Tim Berners-Lee 把一份题为 Information Management: A Proposal[58] 的文件交给了上司 Mike Sendall。Sendall 在上面批了一句后来非常有名的话:「模糊,但令人兴奋。」[59]到 1990 年 12 月 25 日,Berners-Lee 已经在一台 NeXT 电脑上跑起了第一个 Web 服务器和浏览器[60](机器上贴着标签:「这是服务器,不要关机!!」),并发明了三项环环相扣的技术:HTML 用来结构化文档,HTTP 用来传输它们,URL 用来统一寻址它们。第一个网站 info.cern.ch 在 1990 年 12 月 20 日上线[61]。

思想源头可以追溯到 1945 年 Vannevar Bush 在《大西洋月刊》发表的「As We May Think」[62],他构想了一个叫 Memex 的桌面系统,能通过关联链接在文档间跳转。Ted Nelson 1965 年造了 hypertext(超文本)这个词[63]。但 Berners-Lee 靠刻意的简洁和关键性的开放,让这个概念在全球尺度上真正跑了起来。

决定命运的时刻是 1993 年 4 月 30 日[64],CERN 将 WWW 软件发布到公共领域。Berners-Lee 从未为这项技术申请专利,放弃的潜在收益价值数百亿美元。1993 年 1 月 NCSA 发布了 Mosaic(第一个图形化浏览器,Marc Andreessen 和 Eric Bina 开发),商业爆炸由此引爆。

数字说明一切:从 1990 年的 1 个网站到 2025 年底的超过 13.5 亿个[65]。2025 年全球电商交易额达到 6.86 万亿美元[66],占零售总额的 20% 以上。Berners-Lee 获得了 2016 年图灵奖[67],至今仍通过 W3C 和他的 Solid 项目倡导开放网络。

8. 神经网络熬过两次寒冬,重塑了一切(1943–至今)

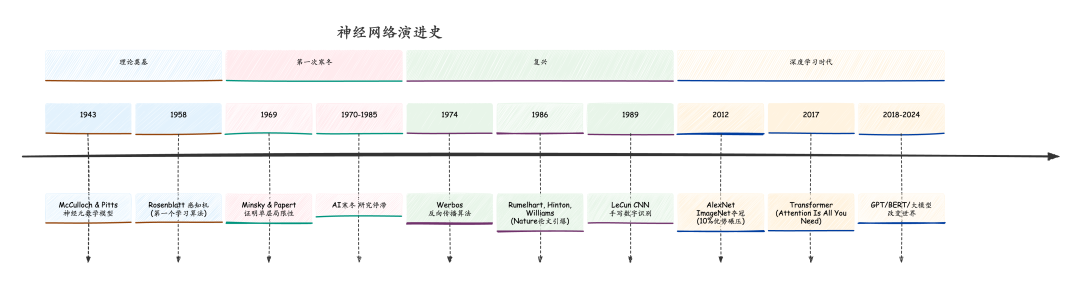

机器能像大脑一样学习,这个想法比电子计算机还老。1943 年 Warren McCulloch 和 Walter Pitts 发表了 A Logical Calculus of the Ideas Immanent in Nervous Activity[68],证明简化的二值神经元网络可以实现任何布尔函数,等价于图灵机。问题是权重得手动设。

Frank Rosenblatt 的感知机[69](1958)引入了学习机制。一台 IBM 704 通过训练穿孔卡片,只需 50 次试验就能区分左标记和右标记的卡片。然后打击来了。Marvin Minsky 和 Seymour Papert 1969 年出版了《Perceptrons》[70],证明单层网络连 XOR 这样的简单函数都算不了。经费崩塌,这个领域进入了第一次「AI 寒冬」。

复活靠的是反向传播。虽然 Paul Werbos 在 1974 年的博士论文中描述了这个方法,但真正让世界注意到的是 Rumelhart、Hinton 和 Williams 1986 年 10 月在 Nature 发表的论文「Learning Representations by Back-Propagating Errors」[71],展示了多层网络可以学习复杂的内部表示,恰好解决了 Minsky 和 Papert 指出的问题。Geoffrey Hinton[72] 在几十年的质疑中坚持下来,这是科学史上最伟大的韧性故事之一。他从美国搬到加拿大,部分原因是反对军方 AI 资助,靠着加拿大高等研究院(CIFAR)的微薄经费生存。

三个时刻引爆了现代革命。第一个,Yann LeCun 1989 年的卷积神经网络[73],在来自纽约州布法罗邮局的 7,291 张手写数字图像(每张仅 16×16 像素)上训练,证明 CNN 能解决现实问题。Andrej Karpathy 用 2022 年的 MacBook 90 秒就复现了[74]原始训练。第二个,AlexNet 在 2012 年 ImageNet 竞赛中以惊人的 10 个百分点优势获胜[75],用了两块 NVIDIA GTX 580 GPU 训练,证明了深度学习的实际优越性。第三个,2017 年 Vaswani 等人的论文「Attention Is All You Need」引入了 Transformer 架构,用自注意力机制取代循环网络,实现了并行化训练,使得 GPT、BERT 以及所有现代大语言模型成为可能。

Hinton、LeCun 和 Yoshua Bengio 三位「AI 教父」获得了 2018 年图灵奖[76]。Hinton 和 John Hopfield 又拿了 2024 年诺贝尔物理学奖。Bengio 在 2025 年 11 月成为第一个 Google Scholar 引用超过 100 万次的 AI 研究者[77],也是任何领域在世被引最多的科学家。全球 AI 市场 2024–2025 年估计达到 2,240 亿至 3,910 亿美元[78]。从蛋白质折叠到自动驾驶到正在重塑人类获取知识方式的对话式 AI,深度学习是底层引擎。

写在最后:一条链,不是一张表

回过头看,这 8 个里程碑形成的是因果链而非并列清单。图灵定义了什么可以计算;冯·诺依曼说明了怎么造通用机器来算;晶体管和集成电路让机器变小、变快、变便宜;Shannon 提供了存储和传输信息的数学框架;TCP/IP 把千万台机器连起来;公钥密码学让连接变得安全;万维网让网络对所有人可用;神经网络让机器学会从流过这一切的数据中自己学习。

有两个反复出现的规律值得注意。第一是独立发现:图灵和 Church,Baran 和 Davies,Diffie-Hellman 和 GCHQ,Kilby 和 Noyce。说明这些想法到了该出现的时候。第二是开放是加速器:CERN 把万维网放入公共领域,端到端原则保持互联网简洁,密码学方法的学术公开发表,全都推动了专有方案无法匹敌的采用速度。GCHQ 的机密发现对实际世界影响为零,而公开的学术版本改变了文明。

也许最深刻的教训是,最有影响力的突破都不是渐进改良,而是概念重构:把程序当数据、把信息当可测量的量、把加密密钥变成不对称的。每一个都改变的不只是技术上能做什么,而是人类如何思考机器、通信和智能本身。

参考来源:

- 判定问题 - Wikipedia

- On Computable Numbers - Turing

- Turing Paper Inspiration

- Turing's Proof

- Church-Turing 论题

- Bombe 密码分析机

- Alan Turing - Wikipedia

- ACM 图灵奖

- 英国 50 英镑纸币

- ENIAC 计算机

- First Draft of a Report on the EDVAC

- First Draft 分发

- Eckert 备忘录

- ENIAC 女程序员

- Jean Bartik

- WITI 名人堂

- Manchester Baby

- Williams 回忆

- 冯·诺依曼瓶颈

- William Shockley

- 晶体管发明

- transistor 词源

- Shockley 专利争议

- John Bardeen 两次诺奖

- 第一块集成电路

- Kilby 诺贝尔奖

- Moore's Law

- 2024 年半导体销售

- A Mathematical Theory of Communication

- 信息时代的大宪章

- 信息论

- Shannon 三大定理

- A Symbolic Analysis

- Shannon 1985 会议

- Claude Shannon

- Paul Baran

- Donald Davies

- ARPANET 第一条消息

- Lo and behold

- TCP/IP 论文

- TCP 协议

- IP 协议

- 端到端原则

- Flag Day

- Ray Tomlinson

- Ray Tomlinson 采访

- ARPANET 流量

- New Directions in Cryptography

- RSA 算法发明

- RSA 算法

- James Ellis

- Clifford Cocks

- GCHQ 机密公开

- HTTPS 使用率

- 密码战争

- NIST 后量子密码学标准

- 后量子加密使用率

- Information Management: A Proposal

- 模糊但令人兴奋

- WorldWideWeb 浏览器

- 第一个网站

- As We May Think

- hypertext 词源

- WWW 发布公共领域

- 网站数量统计

- 电商交易统计

- Berners-Lee 图灵奖

- 神经网络论文

- 感知机

- Perceptrons 书

- 反向传播论文

- Geoffrey Hinton

- LeCun CNN 1989

- Karpathy 复现

- AlexNet 2012

- 2018 图灵奖

- Yoshua Bengio

- AI 市场规模

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录