AgentEval:面向 .NET 生态的企业级 AI 智能体评估框架

AgentEval:面向 .NET 生态的企业级 AI 智能体评估框架

张善友

发布于 2026-03-21 08:23:49

发布于 2026-03-21 08:23:49

1. AgentEval 概述

1.1 框架定义与核心使命

1.1.1 作为 .NET 生态首个原生 AI 智能体评估工具包

AgentEval 是由 joslat(José Luis Latorre Millas)开发并开源的综合性 .NET 工具包,专门设计用于 AI 智能体的系统化评估,github:https://github.com/AgentEvalHQ/AgentEval。 该框架核心定位是成为 .NET 生态系统中首个专门针对 AI 智能体评估需求而构建的原生解决方案。在此之前,AI 智能体评估领域几乎完全被 Python 生态的工具所主导,.NET 开发者缺乏同等成熟度的评估基础设施,往往被迫引入 Python 运行时或自行构建评估能力,带来显著的技术债务和运维复杂度。

AgentEval 的技术实现充分体现了 .NET 平台的企业级特性。框架采用 C# 作为核心开发语言(占比 99.7%),充分利用了 .NET 的类型安全、异步编程模型(async/await)、依赖注入容器等现代软件工程特征。其项目结构遵循标准的 .NET 解决方案组织模式,包含源代码目录、测试项目、示例代码、文档以及自动化脚本等完整组件,体现了企业级软件工程的成熟度。框架的 GitHub 仓库明确声明其设计目标:“What RAGAS, PromptFoo and DeepEval do for Python, AgentEval does for .NET, with the fluent assertion APIs .NET developers expect” 。这一宣言清晰地表明了其生态补位的战略意图,并非简单复制 Python 工具的功能,而是针对 .NET 生态的特性进行深度优化和重新设计。

从评估范式来看,AgentEval 代表了从”指标计算”到”智能评估”的重要转变。传统评估工具提供预定义的指标集合,开发者选择适用的指标并配置执行;而 AgentEval 引入了 “任务效用”(Task Utility) 的核心概念,通过多代理协作架构动态生成针对特定任务的评估标准,实现了评估能力的自适应和可进化。这种范式转变使得评估过程能够更好地捕捉真实业务场景中的复杂质量维度,而非局限于表面化的技术指标。

1.1.2 填补 Python-centric 评估工具在 .NET 领域的空白

AI 评估工具市场的语言生态分布呈现出严重的不平衡状态。RAGAS(Retrieval-Augmented Generation Assessment Suite)、DeepEval、PromptFoo 等主流工具均以 Python 为首要实现语言,其设计理念、API 风格和集成方式深度绑定 Python 的数据科学生态 (arXiv.org) 。这种格局对于以 .NET 为核心技术栈的企业而言,构成了显著的工程摩擦和集成成本:跨语言调用带来的序列化开销和运行时依赖、类型系统不匹配导致的调试困难、与现有 CI/CD 流水线的割裂、以及团队技能栈的额外负担。

维度 | Python 工具生态 | AgentEval (.NET) |

|---|---|---|

运行时依赖 | 需要 Python 运行时及依赖库 | 纯 .NET,无额外语言运行时 |

与 .NET 系统集成 | 进程间通信或 HTTP API,性能损耗 | 原生集成,同一进程,类型安全 |

开发者体验 | Python 开发者熟悉,Jupyter 友好 | .NET 开发者熟悉,Visual Studio 工具链完整 |

企业部署 | 需额外维护 Python 环境 | 与 .NET 运维体系一致 |

异步性能 | 受 GIL 限制,需多进程扩展 | 原生 async/await,高并发高效 |

AgentEval 的战略价值在于彻底消除了这些障碍。作为纯 .NET 实现的评估框架,它使得企业能够在不引入 Python 技术栈的情况下,构建完整的 AI 智能体开发与评估流水线。对于已深度投资 .NET 生态的组织——如采用 Microsoft Agent Framework 构建智能体应用的企业——这意味着 更低的技术复杂度、更统一的技术治理、以及更顺畅的开发者体验。框架的推出标志着 AI 智能体评估工具正在从单一语言生态向多语言、多平台方向演进,反映了企业 AI 应用落地的实际需求多样性。

1.1.3 面向 Microsoft Agent Framework 与 Microsoft.Extensions.AI 的一等公民支持

AgentEval 与微软技术栈的集成深度远超一般的库依赖关系,而是从架构设计之初就将 Microsoft Agent Framework(MAF) 和 Microsoft.Extensions.AI 作为核心依赖进行深度整合 (Github) 。这种”一等公民”(First-Class Citizen)支持体现在多个层面:

API 语义的一致性:AgentEval 直接复用 MAF 的核心类型系统,评估任务可以接收 IAgent 接口实例作为被测对象,自动捕获其对话状态、工具调用链和执行轨迹。开发者无需手动插桩或修改业务代码即可启用评估,实现了 无侵入(non-intrusive)的评估集成。

运行时行为的透明捕获:MAF 定义了智能体的完整生命周期——初始化、接收消息、思考、行动、终止等阶段。AgentEval 通过订阅 MAF 的事件系统,自动捕获这些生命周期事件,构建完整的执行轨迹用于后续评估分析 (Microsoft Learn) 。

扩展点的无缝衔接:AgentEval 基于 Microsoft.Extensions.AI 的 IChatClient 接口构建,天然支持多模型后端的透明切换——OpenAI、Azure OpenAI、本地部署的 Ollama/Llama 模型等均可作为评估目标,无需修改评估代码本身 (Microsoft Learn) 。

Microsoft Agent Framework 本身于 2025 年推出,定位为构建具有高级业务流程能力的代理 AI 应用的生产就绪框架,支持顺序、并发、群聊、交接和”磁性”(Magnetic)编排等多种业务流程模式,并内置 OpenTelemetry 可观测性、Microsoft Entra 安全集成、提示注入保护等企业级功能 (Microsoft Learn) 。AgentEval 与 MAF 的协同演进,使得 .NET 开发者能够在统一的技术栈中完成智能体的开发、评估、部署和运营全生命周期管理。

1.2 设计哲学与差异化价值

1.2.1 开发者优先:降低 AI 评估的认知门槛与工程成本

AgentEval 的设计哲学将 “开发者体验”(Developer Experience) 置于首位,致力于降低 AI 智能体评估的认知门槛与工程成本。这一理念体现在多个技术细节中:

流畅的断言 API 设计:评估配置可以通过方法链式调用以声明式方式构建,语法风格与 .NET 开发者熟悉的 LINQ、FluentValidation 等库保持一致。例如,工具调用验证可以表达为清晰的断言序列,模型比较可以通过简洁的配置完成多后端并行评估 (Github) 。

评估标准的自动化生成:传统 AI 评估需要领域专家手动设计评估维度和评分标准,这一过程既耗时又容易遗漏关键维度。AgentEval 的 CriticAgent 通过分析任务描述和成功/失败示例,能够 自动生成结构化的评估标准草案,开发者在此基础上进行审核和调整,而非从零开始设计 (来源) 。这种人机协作模式显著缩短了评估系统的建设周期。

类型安全与编译时验证:作为纯 C# 实现,AgentEval 充分利用 .NET 的类型系统捕获配置错误,IDE 的智能提示和重构支持显著提升了开发效率,编译时检查避免了 Python 动态类型常见的运行时错误。

1.2.2 生产就绪:从实验环境到企业级部署的无缝衔接

与许多研究原型不同,AgentEval 从设计之初就考虑了 企业级部署的严苛要求:

企业级特性 | 具体实现 |

|---|---|

异步执行与资源效率 | 基于 async/await 的异步流水线,支持高并发评估执行;内置连接池、请求批处理和结果缓存 |

可观测性集成 | 与 MAF 内置的 OpenTelemetry 集成,输出结构化评估追踪数据;计划支持 Azure Application Insights 遥测导出 |

安全与合规 | 评估数据的企业级安全隔离,支持本地执行模式、加密传输、访问控制;结构化日志满足审计追踪要求 |

配置外部化 | 遵循 .NET Options Pattern,支持从配置文件、环境变量、Azure Key Vault 加载敏感配置 |

CI/CD 友好 | 评估即代码(Evaluation-as-Code),与 xUnit/NUnit 等测试框架集成,支持自动化质量门禁 |

需要指出的是,AgentEval 目前处于 “实验性”(experimental)阶段,GitHub README 明确警告”Preview — Use at Your Own Risk”,建议”Do not use in production or safety-critical systems without independent review, testing, and hardening” 。这一坦诚的风险披露反而增强了企业用户的信任——开发团队对框架的成熟度有清晰认知,并设置了适当的期望值。随着版本迭代和社区验证,这些基础设施将支撑其从实验工具向企业级平台的演进。

1.2.3 多维评估:超越单一指标的任务效用综合度量

传统 AI 评估往往聚焦于单一维度,如准确率、BLEU 分数、ROUGE 值或简单的正确/错误判定。AgentEval 引入的 “任务效用”(Task Utility) 概念,强调从 多个维度综合评估智能体的表现,每个维度既独立度量又相互关联,形成对智能体能力的立体画像。

以数学辅导应用为例,AgentEval 可能同时评估以下维度:准确性(答案是否正确)、简洁性(解释是否直接明了)、相关性(内容是否与问题相关)、清晰度(步骤是否易于理解)、启发性(是否引导学生思考而非直接给答案)等。每个维度都有明确的定义和评分量表,最终形成多维度的效用向量而非单一的标量分数。

这种多维评估的优势在于:更丰富的诊断信息(定位具体优势和短板)、灵活的聚合策略(不同场景配置不同权重)、以及 更好的用户价值对齐(捕捉技术指标无法反映的体验质量)。VerifierAgent 进一步确保了这些评估标准本身的有效性,避免了”用有问题的标准去评估”的元级错误。

2. 核心架构设计理念

2.1 多代理协作评估范式

AgentEval 最具创新性的架构特征在于其采用了 多代理协作(Multi-Agent Collaboration)评估范式。这一设计借鉴了智能体系统本身的设计思想,将评估过程建模为多个专业代理的分工协作,而非传统的单一评估函数或流水线执行。这种范式转换带来了评估能力的质变:从静态、预定义的评估逻辑,演进为动态、自适应的评估智能。

2.1.1 CriticAgent:评估标准的智能生成与迭代优化

2.1.1.1 基于任务描述与执行示例的标准提取

CriticAgent 是 AgentEval 评估流程的起点,承担着”评估设计者”的角色。其核心职责是根据给定的任务描述以及成功/失败的执行示例,自动生成一套适合该任务的评估标准。这一设计解决了传统评估中”标准从何而来”的根本难题——在许多企业场景中,业务专家难以将隐性的质量期望转化为明确的评估规则。

CriticAgent 的工作流程遵循结构化的提示工程模式。输入信息包括: - 任务的自然语言描述:阐明智能体预期协助用户完成的目标 - 成功执行的示例:展示理想的任务完成方式(对话记录或执行轨迹) - 失败执行的示例:界定性能边界,展示常见错误模式

基于这些输入,CriticAgent 运用 LLM 的推理能力,提取出隐含的评估维度,并将其表达为结构化的评估标准。以下是一个典型的标准生成输出示例:

[ { "name": "Accuracy", "description": "The solution must be correct and adhere strictly to mathematical principles and techniques appropriate for the problem.", "accepted_values": ["Correct", "Minor errors", "Major errors", "Incorrect"] }, { "name": "Conciseness", "description": "The explanation and method provided should be direct and to the point, avoiding unnecessary steps or complexity.", "accepted_values": ["Very concise", "Concise", "Somewhat verbose", "Verbose"] }, { "name": "Relevance", "description": "The content of the response must be relevant to the question posed and should address the specific problem requirements.", "accepted_values": ["Highly relevant", "Relevant", "Somewhat relevant", "Not relevant"] } ]

这种自动生成的标准具有显著的实用价值:它们不仅覆盖了开发者可能直观想到的主流维度,还常常能够发现一些容易被忽视但用户实际关心的质量因素。框架提供了 additional_instructions 参数,允许开发者注入领域特定的偏好或约束,引导 CriticAgent 生成更符合业务需求的标准。

2.1.1.2 领域知识的自动融入与人工专家协同

CriticAgent 的设计充分考虑了 领域知识的整合需求 和 人机协同的优化闭环。虽然标准生成过程由 AI 驱动,但框架明确推荐开发者利用领域专业知识对生成的标准进行验证和调整。这种协作模式平衡了自动化的规模效率和人类专家的判断深度。

框架支持 标准的版本化和迭代优化。随着业务场景的发展或模型能力的演进,开发者可以重新触发 CriticAgent 生成新标准,或使用 VerifierAgent 的反馈机制自动识别需要调整的标准项。对于高度专业化的应用场景,开发者还可以选择启用 SubcriticAgent(通过 use_subcritic 参数),将生成的标准进一步细化为更小的评估单元,形成层次化的评估体系 。

2.1.2 QuantifierAgent:多维标准的精确量化评分

2.1.2.1 细粒度性能维度的数值化映射

QuantifierAgent 是 AgentEval 评估执行的核心引擎,负责将 CriticAgent 生成的定性评估标准转化为 定量的评分结果。对于每一个评估维度,QuantifierAgent 都会独立分析被测系统的输出,并给出数值化的评分,这种细粒度的量化使得评估结果具有丰富的诊断价值。

评分过程采用 结构化推理模式。QuantifierAgent 不是简单地输出一个数字,而是生成包含推理过程的评估报告:引用被测输出的具体片段,说明其如何满足或违反评估标准,然后基于这些证据给出评分。这种可解释的设计使得评估结果可以被审计和质疑,符合企业治理的要求。

评分输出采用结构化格式,便于后续的分析和可视化。除了每个维度的评分外,QuantifierAgent 还会生成 评分理由(rationale),解释为何给出该评分。这些理由对于调试智能体行为、识别系统性缺陷具有重要价值。

2.1.2.2 评分分布的统计稳定性分析

考虑到 LLM 评估固有的随机性,QuantifierAgent 的设计包含了对 评分稳定性的内在关注。框架支持对同一评估样本进行多次评分,分析评分分布的离散程度,识别那些评分方差较大的”边界案例”。这种分析有助于区分 系统性的性能缺陷 和 偶发的随机波动,为后续的改进决策提供更可靠的依据。

统计稳定性分析的核心指标包括:评分分布的均值(点估计)、标准差(离散度度量)、置信区间(不确定性量化)、以及分布形态(正态性、偏度、峰度)。当检测到评分变异超过预设阈值时,系统会标记该评估为”不稳定”,提示开发者增加采样次数或重新审视评估标准的清晰度。

2.1.3 VerifierAgent:评估质量的元级验证与校准

VerifierAgent 是 AgentEval 架构中最具创新性的组件,它实现了对 评估过程本身的元级验证——这是大多数现有评估框架所缺失的能力。VerifierAgent 的核心使命是回答一个关键问题:“我们生成的评估标准是否有效?量化代理的评分是否可靠?”

2.1.3.1 标准有效性(Validity)检验

VerifierAgent 首先检验 CriticAgent 生成的评估标准是否真正捕捉了任务成功的关键因素:

有效性维度 | 检验方法 | 优化方向 |

|---|---|---|

内容效度 | 标准集合是否覆盖任务成功的关键维度 | 识别遗漏的重要维度或包含的无关维度 |

结构效度 | 各标准之间是否高度相关导致冗余 | 消除语义重叠的标准,确保维度独立性 |

预测效度 | 标准评分与实际业务指标的相关性 | 校准标准权重,增强对业务结果的预测力 |

VerifierAgent 通过迭代生成、量化和比较标准,识别并消除语义重叠的标准项,确保最终标准集合的 最小完备性。

2.1.3.2 评估鲁棒性(Robustness)压力测试

鲁棒性测试通过向评估系统注入 对抗性样本 来完成:

- 输入扰动:使用语义等价但表述不同的输入变体,检查评分是否保持一致

- 噪声注入:在测试案例中引入无关信息或格式变化,测试评分对表面特征的敏感度

- 模型切换:比较不同 LLM 作为 QuantifierAgent 时的评分一致性

如果评分结果对这些扰动高度敏感,则表明评估标准可能 过于依赖表面特征而非深层语义,需要进行调整。

2.1.3.3 辨别力(Discriminative Power)量化分析

有效的评估系统必须能够 区分不同质量的系统输出。VerifierAgent 通过分析评分分布的统计特性来量化评估的辨别力:

- 评分分布离散度:理想的标准应产生覆盖全量程的评分分布

- 效应量(Effect Size):高质量与低质量输出组的评分差异程度

- 排名一致性:评估分数与人类专家排名的相关性(Kendall’s Tau、Spearman 秩相关)

低辨别力的标准(评分分布集中、无法有效区分质量差异)会被标记为 候选淘汰或重构对象,确保评估资源集中于高价值维度。

2.2 评估流程的双阶段架构

AgentEval 的完整评估流程被设计为 两个核心阶段,辅以 验证反馈闭环,形成清晰的责任边界和可扩展的架构 :

阶段 | 核心代理 | 关键输入 | 主要输出 | 设计特点 |

|---|---|---|---|---|

标准生成阶段(Criteria Generation) | CriticAgent (+ SubcriticAgent) | 任务描述、成功/失败示例、领域知识 | 结构化评估标准集合 | 一次性成本,结果可复用和版本化 |

标准量化阶段(Criteria Quantification) | QuantifierAgent | 待评估样本、评估标准、评分配置 | 多维评分向量及统计摘要 | 高频执行,支持批量和流式模式 |

验证反馈闭环(Validation Loop) | VerifierAgent | 量化结果、对抗样本集 | 校准后的标准、改进建议、质量报告 | 持续优化,驱动标准和配置的迭代 |

标准生成阶段 由 generate_criteria 函数驱动,输出为结构化的评估标准规范。该阶段的关键设计决策包括:是否启用 SubcriticAgent 进行标准细化、如何设置生成轮数以平衡覆盖度和计算成本、以及如何处理生成的标准(直接采用、人工审核后采用、或迭代优化)。

标准量化阶段 由 quantify_criteria 函数实现,将预定义或动态生成的标准应用于具体测试案例。该阶段支持 批量评估(离线大规模评估)和 流式评估(在线实时监控)两种模式,以及 部分评估 的容错设计——当智能体执行提前终止或某些标准不适用时,框架能够处理缺失数据,提供基于可用信息的评分摘要。

验证反馈闭环 是 AgentEval 区别于简单流水线评估的关键设计。VerifierAgent 的输出不是评估的终点,而是驱动标准生成和量化过程优化的反馈信号,形成 “评估的评估”的自适应机制。

3. 关键技术模块详解

3.1 工具调用验证(Tool Usage Validation)

工具调用是现代 AI 智能体的核心能力,智能体通过调用外部工具(API、数据库查询、计算模块等)来扩展其能力边界。AgentEval 的工具调用验证模块提供了对这一关键能力的 系统化评估,其设计覆盖了工具调用的全生命周期。

3.1.1 调用序列正确性校验

智能体在完成复杂任务时,往往需要按照特定顺序调用多个工具,形成 工具调用链(Tool Call Chain)。AgentEval 验证实际调用序列与预期序列的匹配程度,支持多种匹配模式以适应不同的严格程度需求:

匹配模式 | 语义定义 | 适用场景 |

|---|---|---|

EXACT | 工具名称、参数、顺序完全一致 | 高精度工作流,如金融交易、医疗操作 |

IN_ORDER | 关键工具按指定顺序调用,允许额外工具穿插 | 保证核心流程,允许辅助操作 |

ANY_ORDER | 关键工具全部调用,顺序不限 | 探索性任务,如多源信息收集 |

CONDITIONAL | 基于运行时状态的动态序列验证 | 复杂分支逻辑,如故障恢复流程 |

序列验证的实现依赖于对智能体执行轨迹的完整捕获。AgentEval 与 MAF 的深度集成使其能够自动记录每次工具调用的上下文,包括触发调用的用户输入、智能体的推理过程(如可用)、工具返回结果等,为后续的深度评估提供丰富的上下。

3.1.2 参数类型与边界验证

工具调用的参数正确性直接影响执行结果。AgentEval 实现了 双重验证机制:

Schema 合规性验证(确定性层):验证生成的 JSON 参数是否符合工具定义的 JSON Schema,包括类型匹配、必填字段存在、枚举值合法、数值范围约束等。这一层验证不依赖 LLM 判断,确保基础正确性。

语义正确性验证(智能层):对于 Schema 无法表达的约束(如”日期应在未来”、“查询参数应与用户意图一致”),使用 LLM-as-Judge 进行验证。这种分层设计兼顾了验证的完备性和灵活性。

根据 EvalScope 框架的实践经验,参数验证的常见失败模式包括:幻觉参数(生成不存在的字段)、类型混淆(字符串与数值混用)、边界违规(如负数数量)、以及 格式错误(如日期字符串不符合 ISO 8601 标准)。AgentEval 的错误分类体系帮助开发者快速定位问题根源——是提示词设计、模型能力还是后处理逻辑的问题。

3.1.3 执行结果语义匹配

工具调用的最终价值体现在其结果对任务目标的贡献。AgentEval 不仅验证调用的语法正确性,还评估 执行结果的语义 adequacy:

- 信息提取验证:是否从复杂的返回结构中提取了关键信息

- 错误处理验证:是否正确处理了错误返回或空结果

- 策略调整验证:在面对意外结果时,是否能够适当地调整后续策略

语义匹配采用 基于嵌入的相似度计算 和 基于 LLM 的相关性判断 相结合的方法,既保证了评估的自动化程度,又保留了对复杂语义关系的捕捉能力。

3.1.4 调用延迟与性能基线评估

在企业级应用中,工具调用的 性能特征 与功能正确性同等重要。AgentEval 记录每次调用的延迟指标,支持设定性能基线和 SLO(Service Level Objective):

性能指标 | 定义 | 典型阈值 |

|---|---|---|

P50 延迟 | 50% 请求的响应时间 | < 500ms(交互式场景) |

P95 延迟 | 95% 请求的响应时间 | < 2s(用户可接受上限) |

P99 延迟 | 99% 请求的响应时间 | < 5s(异常容忍上限) |

超时率 | 超过最大等待时间的请求比例 | < 0.1% |

重试次数 | 平均每个请求的重试次数 | < 1.5 |

评估报告包含延迟的百分位数统计和趋势分析,帮助识别性能瓶颈和异常延迟模式。对于异步调用场景,还评估 并发调度的效率 和 资源利用率。

3.2 RAG 质量指标体系(RAG Quality Metrics)

检索增强生成(RAG)是当前企业 AI 应用的主流架构,AgentEval 提供了针对 RAG 管道的 专门优化评估指标,与 RAGAS 等工具形成对标但具备更深度的 .NET 集成。

3.2.1 忠实度(Faithfulness):生成内容与检索片段的事实一致性

忠实度 衡量生成内容是否忠实于检索到的上下文信息,而非引入外部知识或产生幻觉(Hallucination)。这是控制 RAG 系统可信度的 核心指标。

AgentEval 实现忠实度评估的 “声明提取-验证”两阶段流程:

- 声明抽取:使用 LLM 将生成内容分解为原子化的事实陈述(命名实体、数值、关系断言等)

- 来源验证:逐一验证每个陈述是否能在检索片段中找到支持证据

验证方法包括: - 基于 NLI(自然语言推理)的蕴含判断:检索上下文是否蕴含该陈述 - 基于归因的标注:要求模型标注陈述的信息来源位置 - 矛盾检测:识别与检索内容明确冲突的陈述

评估结果以 支持事实的比例 表示,同时标记出 无法验证 或 明确矛盾 的陈述,为诊断检索层或生成层的问题提供依据。

3.2.2 相关性(Relevance):回答与查询意图的匹配程度

相关性评估超越简单的关键词匹配,关注生成内容对 查询意图的满足程度。AgentEval 采用 多维度相关性模型:

相关性维度 | 定义 | 评估重点 |

|---|---|---|

主题相关性 | 回答是否涉及查询的主题领域 | 避免离题或引入无关主题 |

功能相关性 | 回答是否提供了查询所请求的信息类型 | 定义、比较、操作步骤、原因解释等 |

完整相关性 | 回答是否覆盖了查询的所有隐含需求 | 多部分问题的各个子问题、约束条件 |

相关性评估结合了 基于嵌入的语义相似度(计算效率)和 基于 LLM 的意图理解( nuanced 判断),既保证了评估的自动化程度,又实现了对复杂查询的深度评估。

3.2.3 上下文精确率/召回率(Context Precision/Recall)

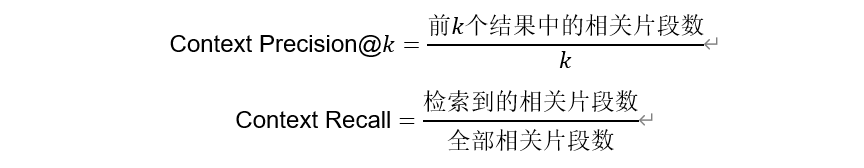

这两个指标 直接评估检索组件的质量,是优化 RAG 系统的关键诊断工具:

AgentEval 的创新在于支持 “软”相关性判断——片段与查询的相关性不是二元的,而是连续的分值。这使得精确率/召回率的计算更加细腻,能够反映片段的 部分相关性。框架还支持 基于位置的加权——更早出现的相关片段获得更高权重,这与 RAG 系统的实际使用模式一致(LLM 对上下文中靠前位置的信息更敏感)。

3.2.4 答案正确性(Answer Correctness)的多维度判定

答案正确性是 RAG 评估的 终极目标,另其实现往往依赖于外部知识源或人工判断。AgentEval 提供了 分层的正确性评估策略:

参考资源 | 评估方法 | 适用场景 |

|---|---|---|

黄金标准答案 | 精确匹配、语义等价判断、包含关系验证 | 测试集构建完善、答案确定的场景 |

相关文档集合 | 基于忠实度和相关性的综合推断 | 有可靠知识库但无标准答案的场景 |

无参考(零样本) | LLM 自我一致性检查(多角度提问验证稳定性) | 开放性探索、创意生成场景 |

工具验证 | 数学表达式求值、事实性声明搜索确认 | 可计算、可查询的确定性场景 |

3.3 随机评估机制(Stochastic Evaluation)

LLM 的随机性是其固有特性,同一输入多次执行可能产生不同输出。这种随机性对评估的可靠性提出了挑战:单次评估的结果可能无法代表系统的典型表现。AgentEval 的随机评估机制系统化地应对这一挑战,将随机性从噪声转化为 可分析的信号。

3.3.1 N 次重复执行的统计采样策略

AgentEval 支持配置评估的 重复次数 N,对于每个评估样本,被测系统会执行 N 次,收集完整的输出集合。采样策略包括:

策略 | 机制 | 适用场景 |

|---|---|---|

固定 N 均匀采样 | 预设重复次数,均匀执行 | 资源确定、对比基准固定的场景 |

自适应采样 | 根据初步结果的方差动态调整 N,直至达到目标置信度 | 精度优先、成本敏感的场景 |

分层采样 | 针对不同场景或输入类型分别设定采样强度 | 输入异质性高、需要保证覆盖的场景 |

固定种子控制 | 使用确定性随机种子,确保结果可复现 | 回归测试、调试排查的场景 |

N 的选择涉及 成本和精度的权衡。较大的 N 提供更可靠的统计结论,但线性增加评估成本。AgentEval 提供了基于 统计功效分析 的 N 值建议工具,帮助开发者根据预算约束和决策重要性做出合理选择。

3.3.2 评分分布的置信区间计算

基于 N 次重复执行的评分样本,AgentEval 计算评分分布的 统计特征:

- 点估计:样本均值作为最可能的评分值

- 离散度度量:样本标准差反映评分的稳定性

- 区间估计:置信区间量化不确定性范围

置信区间的计算采用 适用于小样本的 t 分布方法,确保统计推断的可靠性。例如,“效率维度得分 4.2,95% 置信区间 [3.8, 4.6]” 这样的表述,使得决策者能够 充分考虑不确定性,避免基于点估计的草率结论。

3.3.3 异常值检测与稳定性阈值设定

评分分布中的 异常值(Outliers) 可能指示: - 测试案例的特殊性(某些输入确实导致高度可变的行为) - 评估标准的模糊性(边界案例难以一致评分) - 智能体的真正不稳定性(特定场景下的行为不可预测)

AgentEval 实现了多种异常值检测算法: - IQR 方法:基于四分位距的统计边界 - Z-score 方法:基于标准差的偏离程度 - 聚类方法:识别与主分布显著分离的子群

稳定性阈值 用于判断智能体在特定场景下的行为是否足够可靠。例如,配置”评分标准差 < 0.2”作为稳定性标准,不满足该标准的场景被标记为 需要优化,触发进一步的诊断分析或模型调整。

3.3.4 基于方差分析的模型可靠性排序

当比较多个候选模型或配置时,AgentEval 采用 方差分析(ANOVA) 等统计方法,区分 模型间的系统性差异 和 随机波动。评估报告包含:

- 各模型的 平均评分及置信区间

- 模型间差异的 统计显著性检验结果(p 值)

- 可靠性排序建议,综合考量均值性能和稳定性方差

这一分析对于 生产环境的模型选型 至关重要——一个平均得分略低但方差极小的模型,可能在实际部署中优于高分高方差的竞争对手,因为 可预测性本身就是价值。

3.4 模型比较与成本-质量权衡(Model Comparison)

企业 AI 部署中,模型选择不仅是技术决策,也是经济决策。AgentEval 的 模型比较模块 支持系统化的多模型评估和成本-质量分析。

3.4.1 多模型并行评估的流水线编排

AgentEval 可以配置 多个模型后端(通过 Microsoft.Extensions.AI 的统一抽象),对同一组评估样本 并行执行评估。流水线编排考虑了:

优化维度 | 具体策略 |

|---|---|

速率限制适配 | 根据各模型的 API 限制动态调整并发度 |

成本优化 | 优先执行低成本模型,高成本模型仅用于关键案例 |

故障隔离 | 单个模型的评估失败不影响其他模型,失败信息完整记录 |

结果对齐 | 确保各模型在相同的测试集、相同的评估标准下执行 |

这种并行执行显著缩短了比较周期,使得 大规模模型评估在实践上可行。

3.4.2 质量-延迟-成本的三维帕累托分析

评估结果以 三维帕累托前沿 的形式呈现,帮助决策者在复杂约束下做出最优选择:

维度 | 典型指标 | 优化方向 |

|---|---|---|

质量 | 综合任务效用评分 | 最大化 |

延迟 | P50/P99 响应时间 | 最小化 |

成本 | 每千次调用费用(API 成本 + 计算成本) | 最小化 |

帕累托前沿分析 识别在给定约束条件下的最优选择: - “在延迟不超过 2 秒的前提下,成本最低的可接受质量模型” - “在给定预算内,质量-延迟权衡最优的模型配置” - “质量要求严格时,延迟和成本的边际增量分析”

可视化工具支持 三维散点图、雷达图、以及交互式的约束探索,使得权衡决策更加直观。

3.4.3 场景自适应的模型推荐引擎

基于历史评估数据,AgentEval 可以构建 场景-模型性能映射,为新的查询或任务 自动推荐最适合的模型:

- 任务分类:自动识别输入任务的类型(事实查询、推理任务、创意生成等)

- 历史性能匹配:检索相似任务的历史评估数据,预测各模型的预期表现

- 动态路由集成:将推荐结果输出到应用程序的路由逻辑,实现 运行时模型选择

这种 数据驱动的推荐 降低了模型选型的试错成本,加速了智能体应用的迭代优化,同时在全局优化成本-质量权衡的同时满足特定请求的约束。

4. 微软技术栈深度集成机制

4.1 Microsoft Agent Framework(MAF)原生集成

Microsoft Agent Framework(MAF)是微软推出的 开源多语言框架,支持 Python 和 .NET,用于构建、编排和部署具有高级业务流程能力的 AI 智能体。AgentEval 与 MAF 的集成达到了 框架级别的深度,而非外部工具的简单调用。

4.1.1 Agent 生命周期事件的自动捕获与评估

MAF 定义了智能体的 完整生命周期:创建、配置、执行、暂停、恢复、终止等阶段。AgentEval 通过 订阅 MAF 的事件系统,自动捕获这些生命周期事件,构建完整的执行轨迹:

生命周期阶段 | 捕获信息 | 评估应用 |

|---|---|---|

初始化 | Agent 配置、系统提示词、可用工具定义 | 配置合理性、工具覆盖度评估 |

接收输入 | 用户查询、对话历史、上下文状态 | 输入理解、上下文维护评估 |

思考规划 | 推理过程、目标分解、策略选择 | 规划质量、决策合理性评估 |

工具调用 | 调用选择、参数生成、执行结果 | 工具使用验证的核心输入 |

响应生成 | 输出内容、格式、引用信息 | 生成质量、忠实度评估 |

终止/交接 | 任务完成状态、后续行动建议 | 任务完成度、用户体验评估 |

这种捕获对 应用程序代码无侵入性——开发者无需修改 Agent 实现即可启用评估,实现了 “评估即切面”(Evaluation-as-Cross-cutting-Concern) 的架构模式。

4.1.2 对话状态与工具调用链的透明化追踪

MAF 的 ConversationMemory 和 AgentSession 组件维护了对话的完整状态历史。AgentEval 能够 序列化这些状态,作为 QuantifierAgent 的评估输入,实现对多轮交互中 上下文保持能力、工具调用决策合理性 的深度分析。

工具调用链的追踪 包括: - 调用时机(何时决定调用工具) - 调用选择(为何选择该工具) - 参数生成(如何构造调用参数) - 结果处理(如何利用返回结果) - 错误恢复(如何应对调用失败)

这种 因果图形式的呈现,清晰展示了数据依赖和控制流,为诊断复杂多步骤任务中的故障点提供了关键信息。

4.1.3 与 MAF 的 GroupChat、Sequential 等模式的兼容

MAF 支持多种 智能体协作拓扑,AgentEval 的评估能力覆盖所有这些模式:

协作模式 | 核心特征 | 评估重点 |

|---|---|---|

Sequential(顺序执行) | 任务在多个 Agent 间顺序传递 | 各步骤的衔接质量、信息保真度、累积错误控制 |

GroupChat(群组对话) | 多个 Agent 自由交互,动态角色分配 | 发言者选择机制、对话效率、共识达成过程、信息整合质量 |

Handoff(交接) | 任务在特定条件下转移给专门 Agent | 交接条件的合理性、上下文传递完整性、交接后任务连续性 |

Magnetic(磁性编排) | 主 Agent 指导其他 Agent 的协作 | 指导策略的有效性、从 Agent 的遵循程度、整体协调效率 |

这种 模式感知的评估 使得 AgentEval 能够诊断单 Agent 评估无法发现的 ** emergent 行为问题**,如群体思维、信息孤岛、或责任分散效应。

4.2 Microsoft.Extensions.AI 统一抽象层

Microsoft.Extensions.AI 是 .NET 生态的 AI 服务统一抽象层,定义了 IChatClient、IEmbeddingGenerator 等核心接口,屏蔽了不同 AI 服务提供商的差异 (Microsoft Learn) 。AgentEval 基于这一抽象构建,实现了 后端无关的评估能力。

4.2.1 IChatClient 接口的无缝接入

AgentEval 的评估核心通过 IChatClient 接口与被测系统交互,这意味着:

后端类型 | 典型实现 | 评估接入方式 |

|---|---|---|

云服务(OpenAI) | OpenAIChatClient | 直接实例化,API 密钥配置 |

云服务(Azure OpenAI) | AzureOpenAIChatClient | Azure 身份验证集成,企业级安全 |

本地部署(Ollama) | OllamaChatClient | 本地端点配置,数据隐私保护 |

本地部署(ONNX) | OnnxChatClient | 边缘计算场景,低延迟要求 |

自定义封装 | 实现 IChatClient 的适配器 | 遗留系统迁移、特殊协议对接 |

完全一致的评估代码 可以评估任何符合该抽象的组件,开发者切换模型 仅需配置变更,无需代码修改。

4.2.2 多模型后端(OpenAI、Azure OpenAI、本地模型)的统一评估

基于统一抽象,AgentEval 可以在 同一评估任务中混合使用多种模型后端。这在以下场景特别有价值:

场景 | 模型分工 | 成本效益 |

|---|---|---|

裁判-选手模式 | 高性能模型(如 GPT-4)作为 CriticAgent/QuantifierAgent,评估多个候选生产模型 | 评估质量高,候选模型成本可控 |

分层评估 | 轻量级模型完成初筛,仅边界案例启用大模型深度评估 | 大幅减少高 |

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-20,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录