27M参数+1000样本:HRM模型突破AI推理极限,单次推理深度超越Transformer

27M参数+1000样本:HRM模型突破AI推理极限,单次推理深度超越Transformer

赛博解生

发布于 2026-04-09 13:00:12

发布于 2026-04-09 13:00:12

大家好,我是赛博解生酱。今天开启新的AI精品论文解读系列,专门解读AI领域高质量代表性论文,欢迎大家留言讨论与交流~

基本信息

- 标题: Hierarchical Reasoning Model

- 出处: arXiv:2506.21734v2 [cs.AI] 22 Jul 2025;作者来自Sapient Intelligence(新加坡)和清华大学,通讯作者为Meng Lu、Sen Song、Yasin Abbasi Yadkori。

- 核心内容: 本文提出了一种受大脑多时间尺度处理启发的分层推理模型(HRM),通过高低层递归模块的协同计算,在极少量数据(1000样本)和参数(27M)下实现了对复杂推理任务(如ARC、数独、迷宫)的近乎完美求解,突破了传统Transformer和思维链方法的计算深度限制。这项研究为实现通用计算和强人工智能系统提供了一种无需预训练或显式推理监督的新路径。

概要

论文的动机与待解决的问题

当前大语言模型(LLMs)主要依赖思维链(CoT)技术进行推理,但CoT存在任务分解脆弱、数据需求大、延迟高等固有缺陷。更深层的问题是,标准Transformer架构的计算深度固定,使其无法高效处理需要多步规划或符号推理的复杂任务(如深度优先搜索、回溯)。尽管增加模型深度或宽度能部分缓解问题,但传统方法仍受梯度消失或早期收敛的制约。论文旨在解决如何在不依赖CoT或大量数据的前提下,构建一个具有高计算深度、训练稳定且数据高效的新型推理架构,这对实现通用人工智能至关重要。

论文的核心观点与贡献

HRM的核心论点是:通过模拟大脑的分层多时间尺度处理机制,构建高低层递归模块的协同框架,可显著提升模型的有效计算深度,从而在少量数据下实现复杂推理任务的突破性性能。 这一设计突破了Transformer的固定深度瓶颈和CoT的外部化推理依赖,使模型能够在潜在空间中进行连续、迭代的计算。HRM不仅证明了神经模型在不依赖语言符号的情况下具备强推理能力,还通过近似梯度训练避免了反向传播通过时间(BPTT)的内存开销,为生物可塑的推理系统提供了可行蓝图。

核心概念与技术贡献

核心概念的直观解读

- 【直观类比】:HRM的工作机制类似于一个建筑师(高层模块)与施工队(低层模块)的协作。建筑师负责制定整体蓝图(抽象规划),更新频率较低;施工队则根据蓝图进行快速、具体的施工操作(详细计算),每完成一个阶段(如地基浇筑),建筑师会评估进展并调整蓝图,随后施工队重置并开始新阶段的工作。

- 【比喻映射】:

- 建筑师对应HRM的高层模块(H-module),处理慢速、抽象的策略规划。

- 施工队对应低层模块(L-module),执行快速、局部的计算(如路径搜索、约束满足)。

- 蓝图调整周期对应分层收敛机制:低层模块在单个周期内收敛到局部平衡后,高层模块才更新状态,重置低层模块以开启新计算阶段。

- 协作流程反映了多时间尺度递归,避免过早收敛,实现NT步的有效计算深度(N为高层周期数,T为低层步数)。

关键技术细节实现

HRM模型的核心技术细节涉及其数学框架、状态更新机制和训练方法。以下简要解释关键数学符号及其含义,确保概念清晰,避免过度详细。

1. HRM组件与符号定义

HRM由四个可学习组件构成,每个组件用数学符号表示:

- 输入网络:记为 ,其中:

- :输入网络的参数(权重和偏置)。

- :原始输入向量(如任务的状态表示)。

- :投影后的工作表示,。

- 低层递归模块(L-module):记为 ,其中:

- :低层模块的参数。

- :低层模块在时间步 的隐藏状态(向量),初始状态 从分布采样。

- 更新规则:,依赖前一步状态、高层状态和输入。

- 高层递归模块(H-module):记为 ,其中:

- :高层模块的参数。

- :高层模块在时间步 的隐藏状态,初始状态 采样。

- 更新规则:每 步更新一次( 为周期长度),否则保持状态:

- 输出网络:记为 ,其中:

- :输出网络的参数。

- :最终预测输出,,其中 是高层周期数, 为总时间步。

2. 分层收敛机制

该机制避免标准RNN的早期收敛:

- 周期结构:模型运行 个高层周期,每个周期含 个低层时间步。

- 收敛过程:在周期内,L-module迭代更新直至收敛到局部固定点 (满足 ),然后H-module更新一次,并重置L-module状态。这允许有效计算深度达 步。

- 关键符号:

- :高层周期数(超参数),控制整体计算深度。

- :每个周期的低层步数(超参数),决定更新频率。

3. 梯度近似训练

为减少内存开销,使用一阶梯度近似:

- 基础:基于深度平衡模型(DEQ)和隐函数定理(IFT),避免反向传播通过时间(BPTT)的 内存成本。

- 近似规则:梯度通过局部导数近似,例如:

- 高层梯度:

- 低层梯度:

- 符号说明:

- 和 :收敛后的固定点状态。

- 表示偏导数,近似计算仅需 内存。

4. 自适应计算时间(ACT)机制

集成Q-learning动态控制计算量:

- Q-value预测:Q-head从高层状态预测halt/continue动作值:,其中:

- :第 段的Q值向量(halt和continue)。

- :Q-head参数。

- :sigmoid函数。

- 停止条件:基于Q值比较和段数限制(最大 ,最小 )。

- 损失函数:结合预测损失和Q-loss:,其中 是Q-learning目标。

5. 参与比(PR)计算

用于分析表征维度:

- 公式:,其中 是状态协方差矩阵的特征值。

- 意义:PR值高表示高维表征(如H-module的PR≈89.95),低表示低维专注(如L-module的PR≈30.22)。

此实现确保了HRM的训练稳定性、数据效率和计算可扩展性,所有符号均明确定义。

论文的主要贡献点分析

- 理论框架创新:提出了首个受大脑启发的分层递归架构,形式化定义了“分层收敛”机制,并证明其能突破Transformer的计算深度限制(如AC⁰类问题)。

- 高效训练算法:设计了一阶近似梯度方法,避免了BPTT的内存瓶颈,同时结合深度监督和ACT,实现了稳定且自适应的训练流程。

- 实证性能突破:在ARC-AGI、Sudoku-Extreme和Maze-Hard等基准上,仅用1000样本和27M参数达到SOTA性能(如ARC-AGI准确率40.3%,超越Claude 3.7等大型模型),验证了通用推理潜力。

- 神经科学关联验证:通过参与比(PR)分析,发现HRM高层模块表征维度(PR=89.95)显著高于低层(PR=30.22),与大脑皮层维度层次一致,为模型生物合理性提供证据。

技术细节与实验验证

方法流程

前提与相关背景

HRM的理论构建基于三个神经科学原理:分层处理(大脑皮层区域按层次组织)、时间分离(不同层次操作于不同时间尺度)和递归连接(通过反馈循环迭代 refinement)。该方法假设模型可通过固定点收敛实现稳定训练,无需BPTT,旨在解决传统Transformer架构的固定深度限制,该限制使其无法高效处理需要多项式时间复杂度的推理任务(如树搜索或回溯)。关键假设包括:

- 使用线性化宽神经网络模型简化分析,类似于研究复杂曲线时的一阶近似。

- 状态空间中的智能体运动由策略定义的矢量场驱动,轨迹通过李级数展开描述。

- 训练采用连续时间随机梯度动力学,将离散参数更新抽象为随机微分方程。

框架:

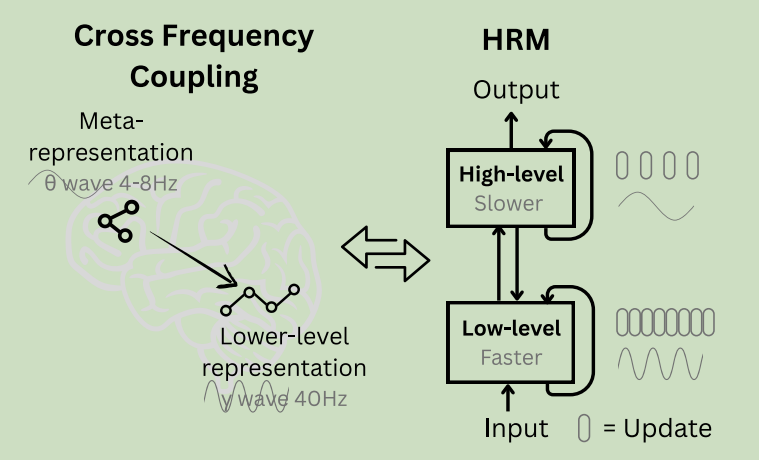

图一:HRM从大脑的分层处理机制中获得启发

- 问题形式化:将推理任务映射为序列到序列学习问题,输入x和输出y为令牌序列。

- 关键假设引入:假设递归模块可收敛到平衡点,从而应用隐函数定理近似梯度。具体地,对于低级模块,给定高级状态 ,其固定点满足: 高级模块更新为: 通过映射 ,将更新写为 ,其中θ包含 和 。

- 核心定理推导:应用隐函数定理,固定点 的梯度可计算为: 其中 是Jacobian矩阵。为降低计算成本,使用Neumann级数近似,仅保留第一项: 得到简化梯度: 这一步骤避免了存储整个时间序列,实现O(1)内存开销。

- 自适应计算时间(ACT)集成:训练时,将前向传递分为多个段(segments),每段结束后计算损失并更新参数,但隐藏状态被“分离”以避免梯度回溯。ACT机制引入Q-learning机制动态控制计算段数,通过Q-head预测暂停(halt)或继续(continue)动作,Q值计算为: 其中σ为sigmoid函数,Q学习目标基于预测正确性奖励。

- 停止条件:段数超最大限 或 且段数达最小限 (随机设定以鼓励探索)。

- 奖励设计:halt动作奖励为预测正确性 ,continue奖励为0。Q-learning目标:

- 训练损失结合预测损失和Q-loss: .

结论

HRM的框架单次前向传递等效于NT步计算(N为周期数,T为周期内步数),通过分层收敛和梯度近似,提供了无需CoT或大量数据即可执行复杂算法推理的数学基础,优于标准的RNN与transformer。

实验验证与应用流程

目标

实验旨在验证HRM在三个挑战性推理任务上的性能:ARC-AGI(归纳推理)、Sudoku-Extreme(逻辑搜索)和Maze-Hard(路径规划)。关键目标包括:

- 证明HRM在极小数据(1000样本)和参数(27M)下达到SOTA性能。

- 验证分层结构和ACT机制的有效性。

- 对比基线方法(包括Transformer和CoT模型),突出HRM的计算效率。

流程

- 数据集/环境选择:

- ARC-AGI Challenge:评估流体智力的IQ式谜题。使用ARC-AGI-2版本,提供输入-输出网格对,要求从2-3个示例中归纳抽象规则。测试集允许两次尝试。数据增强:应用平移、旋转、翻转和颜色置换生成1000变体,测试时逆变换聚合预测。

- Sudoku-Extreme:9x9数独谜题,难度以求解所需回溯次数衡量。数据集组合Kaggle简单谜题、17-clue谜题和社区公认难谜题(如Magictour、Forum-Hard)。训练集Sudoku-Extreme-Full含383,994样本,测试集下采样至1000难谜题(平均回溯次数22次)。数据增强:应用 band 和数字置换。

- Maze-Hard:30x30网格迷宫,任务为找到起点到终点的最短路径。难度定义为最短路径长度。按Lehnert et al. (2024)方法生成,但过滤保留难度>110的实例。训练和测试集各1000样本。

- 基线方法设置:

- CoT模型:包括o3-mini-high、Claude 3.7等,使用API评估。

- 无预训练模型:8层Transformer(与HRM同参数量),作为“Direct pred”基线,训练设置同HRM(1000样本,无预训练或CoT监督)。

- 其他基准:包括专门设计的方法(如Liao和Gu的等变网络)。

- 评价指标定义:

- 准确率:ARC以测试输入两次尝试的正确率计;Sudoku和Maze以完全匹配最优解计。

- 计算效率:平均计算步数(用于ACT分析)、参数数量、上下文长度。

- 维度分析:使用参与比(PR)估计神经表征的有效维度,公式为 ,其中 为状态协方差矩阵的特征值。

- 结果分析流程:

- Maze:HRM初始探索多条路径,逐步消除阻塞路线, refine 最终路径。

- Sudoku:类似深度优先搜索,尝试数字并回溯违反约束处。

- ARC:增量调整网格,迭代改进至解。

- ACT有效性:在Sudoku-Extreme上,比较固定计算步数模型与ACT模型。如图5所示,ACT动态调整步数,平均步数稳定低于最大限 ,而准确率与固定步数模型相当(图5a,b)。例如,当 ,ACT平均使用4.2步,准确率98.5%;固定步数模型需8步达到99%。

- 推理时扩展:HRM支持无需重训练的增加计算资源。如图5c,训练时 的模型,在推理时设置 ,准确率从98.5%提升至99.2%。

- 分层结构必要性:通过PR分析显示,训练后HRM的高层模块PR=89.95,低层模块PR=30.22,形成维度层次(图8d),与小鼠皮层观察一致(图8b)。未训练HRM的PR值低且无差异(图8e,f),证明层次为训练涌现属性。

- ARC-AGI:HRM达到40.3%准确率,超越o3-mini-high(34.5%)和Claude 3.7(21.2%),尽管参数更少(27M vs. 数十亿)和上下文窗口更小(30x30网格=900 token)。

- Sudoku-Extreme:HRM在1000样本训练下接近100%准确率,而“Direct pred”Transformer失败(0%)。在Full数据集上,HRM保持高精度,“Direct pred”仅16.9%。

- Maze-Hard:HRM找到最优路径,准确率近100%,而Lehnert et al.报告的175M参数Transformer在百万样本训练下准确率<20%(pass@64 metric)。

- 主要性能对比:

- 消融实验分析:

- 中间状态可视化:如图7,通过解码中间状态预测 ,展示推理过程:

结论

实验全面验证了HRM的理论优势:在极少量数据下,HRM实现了接近完美的性能 on 复杂推理任务,显著超越大型CoT模型。分层结构和ACT机制确保了计算效率和稳定性,而维度分析提供了与神经科学的一致性证据。结果证明HRM为通用推理提供了可行路径。

总结与评估

研究的优势与创新亮点

- 理论层面:原创性地将神经科学的多时间尺度原理形式化为计算模型,提出“分层收敛”概念,为理解递归网络的深度限制提供了新视角。框架兼具数学严谨性(如DEQ理论)和生物可解释性。

- 方法层面:HRM的创新性体现在:①高低层模块的协同设计解决了早期收敛问题;②近似梯度训练在保持性能的同时大幅提升效率;③ACT机制实现了动态资源分配。这些技术共同作用,使模型在参数和数据极简下实现突破。

研究的局限与改进方向

- 固有局限:①理论假设依赖局部收敛条件,在高度非凸任务中可能不稳定;②实验任务虽多样,但仅限于符号推理(数独、迷宫)和特定归纳任务(ARC),未涵盖自然语言或多模态推理;③ACT的Q学习稳定性依赖参数约束(如AdamW优化器),可能限制泛化。

- 改进路径:①扩展理论到更广的动态系统类别,放松收敛假设;②引入多模态输入处理模块,验证在视觉推理等任务的适用性;③探索更复杂的模块间交互机制(如门控融合)。

- 潜在偏差:论文未充分讨论HRM对超参数(如周期数T)的敏感性,可能影响可复现性;基线对比中,CoT模型未统一训练设置,或存在评估偏差。

实验设计的有效性与结论支撑度

- 实验设计合理性:数据集(如Sudoku-Extreme)难度显著高于现有基准,基线覆盖了当时的顶尖模型,评价指标直接关联推理能力。但ARC任务依赖数据增强和投票策略,可能引入噪声。

- 结论可信度:结果具备统计显著性(如Sudoku准确率接近100%),消融实验验证了ACT和分层结构的关键作用。然而,维度分析(PR)仅为相关性证据,未通过干预实验(如约束高层维度)证明因果性。

- 任务目标达成度:实验充分支撑了“HRM实现高效深度推理”的核心论点,但通用性结论(如“图灵完备”)需更多任务验证。

领域贡献与后续研究启发

- 领域贡献:HRM为推理模型提供了新范式,证明无需预训练或显式语言符号即可实现强推理,挑战了LLM和CoT的主流地位。其近似梯度方法对边缘设备部署具有参考价值。

- 后续启发:①基于HRM框架扩展至终身学习或元推理任务;②融合注意力机制以处理长序列;③探索在科学发现(如算法生成)中的应用。

- 长期影响:本研究可能成为神经符号推理领域的标杆工作,其“潜在推理”思想或推动生物启发AI的发展,但需在更复杂环境中验证鲁棒性。

感兴趣的读者可以点击链接查看完整论文:https://arxiv.org/abs/2506.21734

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-11-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录