智能的本质是压缩吗?CompressARC:不看训练集的单样本推理方法

智能的本质是压缩吗?CompressARC:不看训练集的单样本推理方法

赛博解生

发布于 2026-04-09 13:19:43

发布于 2026-04-09 13:19:43

大家好,我是赛博解生酱。在追求人工智能的道路上,你是否曾因模型对海量算力和数据的无底洞需求而感到困惑?今天给大家带来一篇挑战“预训练”范式的抽象推理研究,即 CompressARC 模型。希望这篇关于信息压缩与智能涌现的深度剖析,能为你的AI研究思路带来新的启发。

在这个充斥着海量数据噪声的深度学习时代,看模型刷榜往往会有一种在混沌系统中寻找决定性规律的无力感 。传统的神经网络之所以能在复杂任务中生存,靠的往往不是对逻辑的深刻理解,而是靠着吞噬数以亿计的参数来死记硬背概率分布。在经典物理学和信息论的交汇处,有这样一种理念:如果你能用最简洁的公式描述最复杂的现象,那么你便掌握了真理 。就像物理学家试图用一个 囊括宇宙的能量逻辑,智能的本质或许并不是大数据的堆砌,而是一套极致的数据压缩机制(Minimal Description Length, MDL) 。

上一篇AI论文解析系列我们拆解了CoT的核心原理,CoT能够赋能transformer解决更高层级复杂度的问题。然而,这些复杂的AI模型离不开互联网规模的预训练支撑 。对于追求“第一性原理”的研究者,或者受限于计算资源的“算力贫困者”来说,一个无需预训练、无需庞大数据库,仅凭逻辑压缩就能在推理瞬间“悟”出规律的模型,才是通往通用人工智能(AGI)的纯粹路径 。CompressARC 恰好提供了这样一条新路径:它不赌历史经验,不猜数据分布,而是通过在推理时将谜题压缩至极限,让智能在极简的程序中自然流淌 。

基本信息

标题: ARC-AGI WITHOUT PRETRAINING (无预训练的ARC-AGI)出处: arXiv,5th Dec; 2025;作者:Isaac Liao, Albert Gu (Carnegie Mellon University)核心内容: 提出了一种名为CompressARC的方法,通过在推理阶段仅针对目标谜题本身进行训练,利用最小描述长度(MDL)原则实现数据压缩,在完全没有预训练和不使用训练集的情况下,解决了20%的ARC-AGI评估谜题。

概要

论文的动机与待解决的问题

在当前的大语言模型(LLM)时代,主流观点认为解决像ARC-AGI这样的抽象视觉推理谜题,必须依赖于海量数据的预训练。现有的SOTA方法(如基于GPT-4o或OpenAI o3的方法)通常依赖互联网规模的数据或经过大量增强的微调数据。然而,ARC-AGI的初衷是测试系统从极少量示例中快速获取新技能的能力。本论文旨在挑战“必须预训练”的假设,探索在极端数据受限(仅使用当前推理的谜题本身,不使用训练集,无预训练权重)的条件下,智能系统究竟能达到何种程度的推理能力。

论文的核心观点与贡献

本文的核心论点是:智能可以通过在推理时对目标数据进行极致压缩(最小化描述长度,MDL)而自然涌现,无需依赖历史经验的预训练。

作者基于奥卡姆剃刀原理(Occam's Razor),认为能生成给定谜题数据的“最短程序”必然捕捉到了数据背后的真实生成规则(即谜题的解)。为了实现这一点的可计算性,作者并未进行穷举搜索,而是将问题转化为训练一个神经网络来“过拟合”当前谜题,通过最小化网络权重编码长度和潜在变量编码长度之和,来实现可微分的压缩搜索。

核心概念的直观解读

【直观比喻】:代码高尔夫(Code Golfing) 想象你正在参加一场编程比赛,题目是“打印出一个特定的复杂图形” 10。

- 笨拙的程序员:会写数千行代码,逐个像素地硬编码打印位置(

print(0,0,red), print(0,1,blue)...)。这种程序虽然能还原图形,但非常长,且无法处理任何变化。 - 聪明的程序员(CompressARC):会寻找图形的规律,写出一行极其精简的代码(例如

for i in 1..10: draw_square(i))。

【比喻映射】:

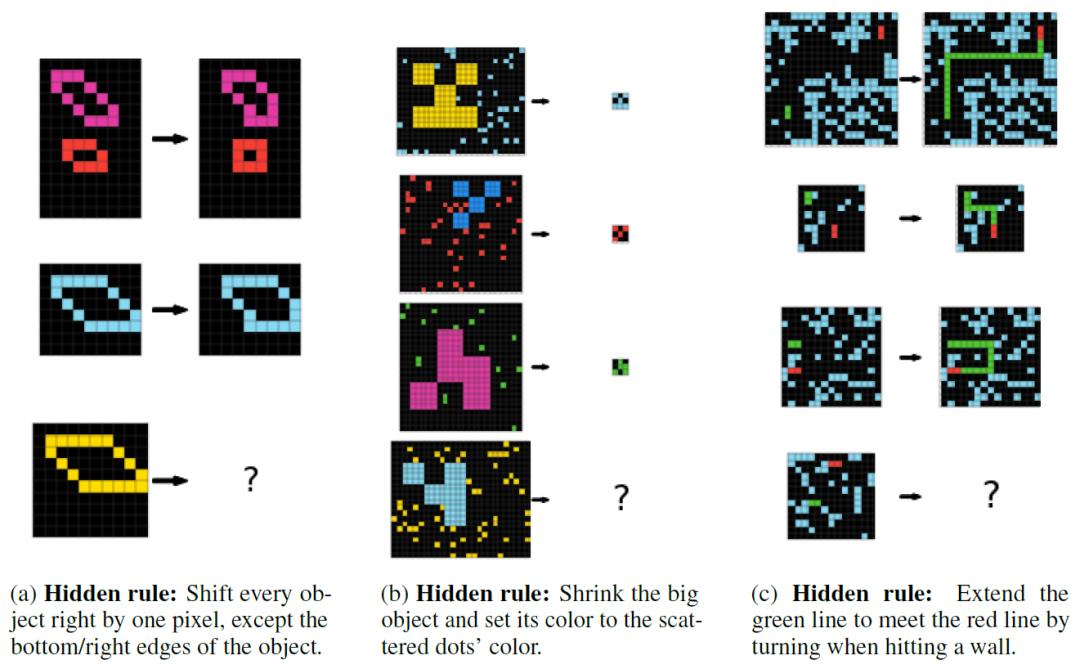

- 图形:对应ARC-AGI中的输入/输出网格示例,示例如下图所示:

论文图1. ARC-AGI-1 三个示例谜题

- 程序长度:对应论文中的“描述长度”(Description Length)。

- 寻找最短代码的过程:对应CompressARC在推理时的训练过程。

- 核心逻辑:如果你能找到一段极短的代码(权重+种子)能完美复现已知的输入输出对,那么这段代码中蕴含的逻辑(for循环、几何变换等)极有可能是通用的,因此可以用来正确地填充未知的测试输出。

关键技术细节实现

在技术本质上,CompressARC利用 变分推断(Variational Inference) 框架来近似最小描述长度。模型被视为一个压缩器,总描述长度 由两部分组成:

- 程序/模型成本:编码神经网络权重所需的比特数(论文中通过硬编码架构和特定初始化简化了这一项,主要关注种子的长度)。

- 数据/生成成本:利用网络生成目标图像所需的“随机种子”的信息量(通过KL散度衡量)以及重建误差(通过交叉熵衡量)。 通过在推理时使用梯度下降优化潜在变量分布参数 和网络参数 ,模型在尝试“压缩”已知谜题数据的过程中,被迫学习到了底层的几何与逻辑规则。

论文的主要贡献点分析

- 提出无预训练的CompressARC框架:这是首个不使用任何预训练数据、也不使用ARC训练集,仅利用测试谜题本身(single sample)进行推理学习的深度学习方法,通过MDL原则实现了20%的评估集准确率。

- 验证了MDL作为智能的可行替代路径:证明了除了大规模预训练之外,基于推理时的信息压缩也是产生抽象推理和泛化能力的有效途径,即使在只有2个示例的情况下也能通过压缩实现泛化。

- 设计了专用的等变神经网络架构:为了支持极少参数(76K)下的高效压缩,作者设计了一种基于“多张量(Multitensor)”的架构,内置了对颜色、旋转、翻转的等变性(Equivariance),并包含了特定的几何操作(如方向性累积最大值 cummax),这为模型提供了极强的归纳偏置。

技术细节与实验验证

方法流程/理论证明

本研究的核心在于将“解决谜题”转化为“寻找能够生成该谜题的最短计算机程序”的问题(即最小描述长度 MDL 原则)。为了解决在巨大的程序空间中搜索的不可行性,作者提出了一种可微分的变分近似方法(CompressARC)。

1. 理论框架:从代码高尔夫到变分优化

CompressARC 并不直接搜索离散的代码字符,而是通过优化一个连续的 模板程序(Algorithm 1) 的参数来实现压缩。

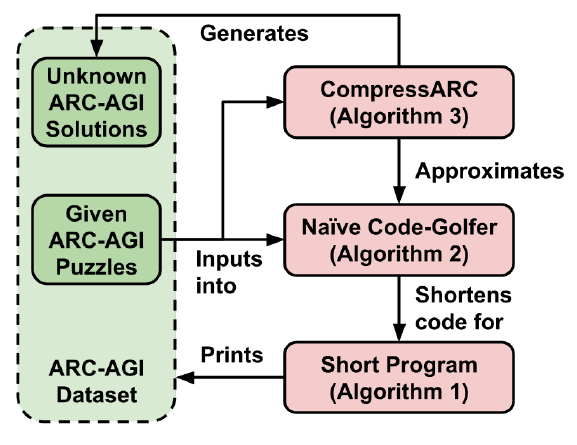

论文图2.该图展示了 CompressARC 的核心哲学,即通过近似一种特定的压缩算法,将整个 ARC-AGI 谜题数据集转换为一个能够精确打印出所有已知网格的最短程序 。基于奥卡姆剃刀原理,模型假设这个最短的程序必然捕获了谜题背后的本质规律,因此当该程序运行并输出那些未知的测试答案时,这些打印出的结果被认为是真实解的最佳预测 。这一流程将传统的逻辑搜索问题巧妙地转化为一个寻找最优压缩表现的优化过程,通过追求极简的代码表达来实现强大的泛化推理。

- 程序总长度定义:程序的长度由两部分组成,即 。

- (模型描述长度):编码神经网络权重 所需的比特数。在本文中,作者通过固定架构设计,重点优化“种子(Seeds)”的长度。

- (数据生成长度):给定模型后,生成特定谜题数据所需的随机种子长度。

- 变分下界近似:论文利用信息论中的相对熵编码(REC)理论,将离散的种子长度近似为连续分布之间的 KL 散度 。

- 如果我们将潜在变量 的后验分布建模为 ,先验分布为 ,那么编码这个 所需的期望比特数(即种子长度)近似等于 。

2. 核心算法流程:推理即训练(原论文Algorithm 3 详解)

CompressARC 的学习过程完全发生在推理阶段(Inference-time),针对每一个单独的测试谜题 ,执行以下严格步骤:

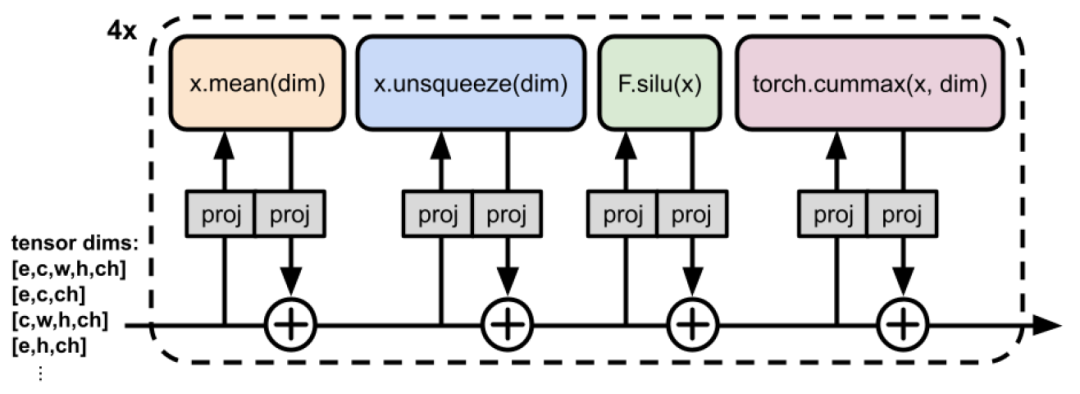

论文图3. 该图揭示了 CompressARC 神经网络的微观构造,其核心是运行在多张量数据上的残差主干网络 。在处理过程中,各种彩色标注的独立操作通过灰色标识的习得投影层,在通道维度上与残差主干进行信息读写 。这种设计使网络对非通道维度的索引置换具有等变性,从而天然地适应 ARC 谜题的对称特性 。虽然诸如累积最大值(cummax)等特定层会为了获取某些几何处理能力而打破部分对称性,但整体架构通过这种灵活的信息流动机制,确保了在极小参数量下仍能高效地在多维抽象空间中提取谜题特征。

- 步骤一:初始化(针对单个谜题)

- 读取谜题 的维度信息(样本数 n\example,颜色数 n\colors,宽 width,高 height)。

- 初始化潜在变量分布参数:均值 和 对角协方差矩阵 (形状为多张量结构,见架构部分图片)。

- 随机初始化神经网络参数 。

- 步骤二:迭代优化循环(2000步) 在每一步优化中,模型试图“压缩”当前谜题 :

- 逻辑注脚:随着训练进行,网络权重 学习通用的几何变换规则,而潜在变量 学习该谜题特有的参数(如特定颜色映射)。

- KL项:迫使 保持简单(接近标准正态分布),只在必要时才偏离以存储关键信息(如“左边是红色”)。

- 重建项:迫使网络输出的 grid\logits 尽可能准确地匹配已知的输入/输出网格 。

- 网络输出 grid\logits,即每个网格位置上颜色类别的对数概率。

- 采样(Sampling):从变分分布中采样潜在变量 。这个 代表了生成该谜题所需的“压缩编码”。

- 前向传播(Forward Pass):将 输入到等变神经网络 中。

- 计算损失函数(Loss Calculation): 目标是最小化总描述长度 ,损失函数由两部分组成: 编码潜在变量所需的比特数重建谜题所需的额外纠错比特数

- 反向传播与更新:计算 ,使用 Adam 优化器同时更新 和 。

- 步骤三:生成解(Inference)

- 训练结束后,保持优化好的 不变。

- 再次采样 ,通过网络生成最终的谜题填充结果 。

- 对测试用例的未知输出部分进行采样或取最大概率(Argmax),得到最终解。

3. 关键架构细节:多张量与等变性

为了支持极少数据下的泛化,作者并未设计通用的 CNN 或 Transformer,而是“工程化”了一个具有强归纳偏置的架构。

- 多张量(Multitensor)数据结构:

- 网络内部不传递单一的 Tensor,而是传递一个“张量桶(Bucket of Tensors)”。

- 包含不同维度的张量,例如

[example, color](存储颜色映射信息)、[example, width](存储列信息)、[example, direction](存储方向信息)等。 - 目的:让网络能够显式地分离和处理不同类型的抽象概念(如“颜色”与“位置”分离)。

- 严格的等变性(Equivariance)设计:

- 置换等变性:网络对颜色 ID 的具体数值不敏感(红色变蓝色,输出也相应变色),对样本顺序也不敏感。

- 几何等变性:通过Directional Layers处理旋转和翻转。网络将图像视为 8 个方向的组合(上下左右+对角)。

- 关键层实现:

- Multitensor Communication Layer:允许不同形状的张量交换信息。通过“广播(Broadcasting)”将低维信息传给高维,通过“求和归约(Sum Reduction)”将高维信息压缩回低维。

- Directional Cummax Layer:这是一个非局部的几何操作。它在特定方向上计算累积最大值。这赋予了模型“射线投射”或“填充直到边界”的能力(这在 CNN 中很难通过小卷积核实现)。

实验验证与应用流程

1. 实验目标

验证在零预训练数据(Zero Pre-training Data)且不查看训练集(No Training Set Access)的极端条件下,仅通过对测试样本本身进行 MDL 压缩,是否能涌现出解决 ARC-AGI 谜题的能力 。

2. 详细实验流程

- 数据集划分:使用 ARC-AGI-1 的公开评估集(400个谜题)和训练集(400个谜题)分别进行测试。

- 配置:

- 每个谜题独立训练。

- 优化器:Adam (LR=0.01) 55。

- 计算预算:每个谜题 2000 次迭代(约 20 分钟/单卡 RTX 4070)。

- 后处理:在生成答案时,结合了指数移动平均(EMA)和频率统计来去噪(详见 Appendix G)。

3. 验证结果与分析

- 定量结果:

- 评估集准确率:20% (Pass@2)。

- 对比基线:同样的推理时训练设置下,标准的 U-Net 仅获得 0.75% 的准确率。这强有力地证明了 CompressARC 的性能来自于 MDL 压缩目标和架构设计,而非简单的过拟合。

- 定性分析:模型学会了什么?(Case Study: Color the Boxes)

[color, direction, channeL]张量:PCA 显示该张量编码了“方向”与“颜色”的对应关系(如:上->红,下->蓝)。[example, height/width, channeL]张量:编码了网格中边界线的具体位置。- 为了验证模型不是“死记硬背”,作者对训练后的潜在变量 进行了 PCA(主成分分析),以通过可视化手段“打开黑盒”(见论文 Figure 6, 7)。

- KL 散度分解:作者发现,在解决“根据方向给盒子着色”的谜题时,大部分张量的 KL 散度降为 0(包含无用信息),只有 4 个特定张量保留了高 KL 值。

- 语义解码:

- 结论:模型确实通过压缩,将谜题的“规则”(Rule)抽象为了潜在空间中的紧凑表示。

- 能力边界评估(根据 Appendix H):

- 多步复合推理(Repeating operations)。

- 抽象计数(Counting)。

- 复杂的拓扑判断(Connectivity)。

- 简单几何变换(Cropping, Translation)。

- 基于条件的填充(Infilling)。

- 物体识别与连线(Connecting dots)。

- 已掌握能力:

- 未掌握能力:

4. 实验结论

实验结果表明,压缩即智能在 ARC-AGI 任务中是成立的。即使没有海量经验(预训练),只要能找到描述当前数据的“最短程序”,该程序往往就能正确泛化到未知的测试用例。

总结与评估

研究的优势与创新亮点

- 理论层面:深刻地将“智能”还原为“压缩”,为AGI的研究提供了一个清晰的、非统计相关性的理论视角。它不仅是说“压缩即智能”,而是通过代码高尔夫的形式给出了可操作的数学定义。

- 方法层面:极致的数据效率是其最大亮点。在当今依赖万亿token训练的时代,该工作证明了对于特定类型的抽象推理,单样本学习(One-shot / Zero-shot in terms of training data)是完全可行的。

- 架构设计:作者提出的“多张量(Multitensor)”架构和等变性设计非常有创意,巧妙地解决了不同尺寸、不同属性(颜色、方向)数据的统一处理问题,避免了传统CNN在处理非网格对称性时的低效。

研究的局限与改进方向

- 计算效率瓶颈:尽管参数量仅76K,但每个谜题需要20分钟的推理时训练(2000步迭代)。相比于预训练模型毫秒级的推理,这在实际应用中极其昂贵且缓慢。

- 改进建议:探索元学习(Meta-learning)或将通用的压缩策略预训练进入模型权重,以加速推理时的收敛。

- 高度手工设计的归纳偏置:虽然没有数据预训练,但模型的架构(如方向性 cummax 层、多张量通信机制)是作者经过深度“工程化”设计的。这某种程度上是将人类的先验知识“硬编码”进了架构中,而非模型完全自发学习。

- 改进建议:减少对特定几何操作的硬编码依赖,探索更通用的图神经网络或Transformer架构在压缩框架下的表现。

- 能力边界明显:目前只能解决20%的题目,对于涉及复杂逻辑链条(如“数数”、“拓扑连通性”)的题目表现不佳。这意味着纯粹的压缩可能难以捕捉深层的算法逻辑。

实验设计的有效性与结论支撑度

- 实验设计合理:作者严格限制了数据使用(不看训练集),并设置了U-Net基线来排除“仅仅是过拟合”的质疑,对比非常有力 80。

- 结论可信:通过对潜在空间(Latent Space)的PCA分析(如Figure 7, 15, 18),作者直观展示了模型是如何将“颜色-方向映射”或“边界框位置”编码进随机种子的。这种可视化的证据极大地增强了结论的说服力,证明模型确实“理解”了规则而非死记硬背。

- 任务达成度:虽然20%的准确率远低于SOTA(LLM方法的87.5%),但在“无预训练”这一极端限制条件下,这是一个非凡的成就,充分支撑了“MDL是产生智能的可行替代路径”这一核心论点。

领域贡献与后续研究启发

- 实质性贡献:该论文是ARC-AGI社区的一股清流,打破了“规模定律(Scaling Law)”的迷信,通过复兴经典的MDL理论,为小模型、少样本推理指明了方向。

- 后续启发:

- 混合路径:未来的SOTA系统可能会结合“预训练的大量知识”与“推理时的MDL压缩搜索”。预训练模型提供先验,MDL用于推理时的适应和纠错。

- 科学发现:正如作者在中提到的,这种方法在药物发现或蛋白质设计等数据受限领域可能具有巨大的潜力。

- 长期影响:虽然CompressARC本身可能不会直接成为工业界的主流方法(受限于推理速度),但其核心思想——测试时训练(Test-Time Training, TTT)作为一种压缩过程——极其具有前瞻性。它预示了AI系统可能会从“静态权重的应用者”转向“动态权重的适应者”。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-24,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录