原创 | 一文读懂Embeding技术

Embedding 技术是一种将高维数据映射到低维空间的方法,通常用于将离散的、非连续的数据转换为连续的向量表示,以便于计算机进行处理。这种技术广泛用于自然语言处理(NLP)、图像处理、推荐系统和其他机器学习应用中,以方便大语言模型处理输入数据。

Embedding 技术将原始数据从高维度空间映射到低维度空间,有助于减少数据的复杂性和计算资源的需求,并提高模型的训练和推理效率;Embedding 向量是连续的,因此可以在数学上进行操作,如向量加法、减法和点积等。这使得模型能够更好地理解数据之间的关系;

Embedding 技术通常会捕获数据的语义信息。在 NLP 中,这意味着相似的单词或短语在嵌入空间中会更接近,而不同的单词或短语会远离彼此。这有助于模型理解语言的含义和语义关系。

嵌入向量通常是可训练的,它们可以通过反向传播算法与模型一起训练。这意味着嵌入可以适应特定任务和数据集,从而提高模型的性能;Embedding 技术通常是上下文感知的,它们可以捕获数据点与其周围数据点的关系。在 NLP 中,单词的嵌入会考虑其周围的单词,以更好地表示语法和语义;Embedding 技术通常将高维数据降维到较低维度,但仍然保留了重要的信息。这有助于减少模型的复杂性,并提高模型的泛化能力。

Embedding 技术不仅在NLP领域有广泛应用,还在计算机视觉、推荐系统、社交网络分析等多个领域中有用途。在NLP中,Word Embedding是一种常见的技术,用于将单词映射到连续向量空间。在计算机视觉中,卷积神经网络(CNN)和循环神经网络(RNN)等模型也使用嵌入来处理图像和文本数据。

Embedding在大语言模型中的主要应用有:

- 作为 Embedding 层嵌入到大语言模型中,实现将高维稀疏特征到低维稠密特征的转换(如 Wide&Deep、DeepFM 等模型);

- 作为预训练的 Embedding 特征向量,与其他特征向量拼接后,一同作为大语言模型输入进行训练(如 FNN)。

作为Embedding 层嵌入到大语言模型中

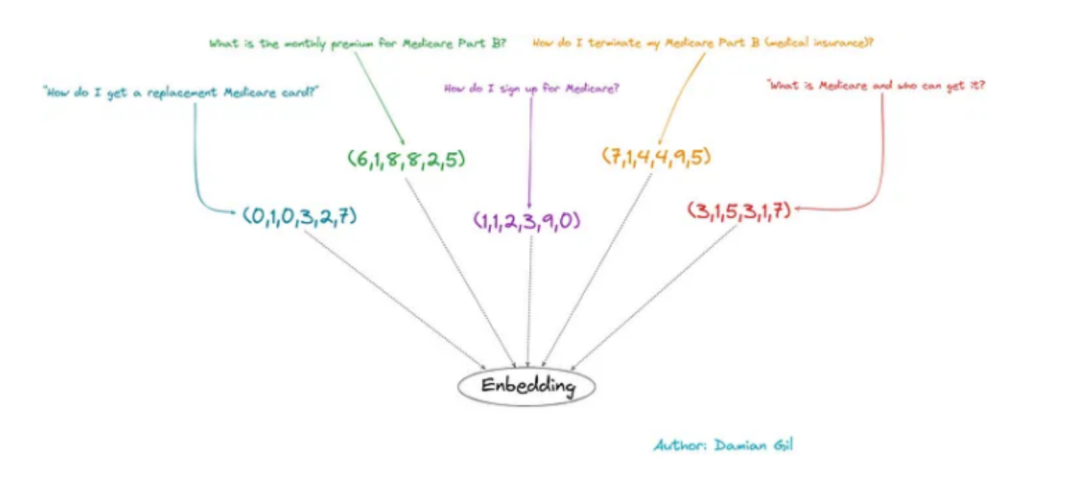

大语言模型无法直接理解书面文本,需要对模型的输入进行转换。为此,实施了句子嵌入,将文本转换为数字向量。

句子嵌入(来源:网络,作者:Damian Gil)

句子嵌入由专门的转换算法实现,可以选择转换算法数字向量的大小。通过句子嵌入对信息进行编码,并将其统一封装为包含所有特征的文本。为此可以创建一个脚本来完成嵌入,调用embedding_creation.py,该脚本收集训练数据集中的值,并创建一个由嵌入提供的新数据集。这是该脚本的代码:

import pandas as pd # dataframe manipulation

import numpy as np # linear algebra

from sentence_transformers import SentenceTransformer

df = pd.read_csv("data/train.csv", sep = ";")

# -------------------- First Step --------------------

def compile_text(x):

text =f"""Age: {x['age']},

housing load:{x['housing']},

Job:{x['job']},

Marital:{x['marital']},

Education:{x['education']},

Default:{x['default']},

Balance:{x['balance']},

Personal loan:{x['loan']},

contact:{x['contact']}

"""

return text

sentences = df.apply(lambda x: compile_text(x), axis=1).tolist()

# -------------------- Second Step --------------------

model = SentenceTransformer(r"sentence-transformers/paraphrase-MiniLM-L6-v2")

output = model.encode(sentences=sentences,

show_progress_bar=True,

normalize_embeddings=True)

df_embedding = pd.DataFrame(output)

df_embedding首先为每一行创建文本,将它存储在一个python列表中,供以后使用;创建Transformer,该模型专门训练在句子层执行嵌入,它在标记和单词层上的编码时只需要给出存储库地址,便可以调用模型。在本例中是“sentence-transformers/paraphrase-MiniLM-L6-v2”。创建的向量的长度为384。利用创建的向量创建一个具有相同列数的数据帧。

作为预训练的Embedding 特征向量

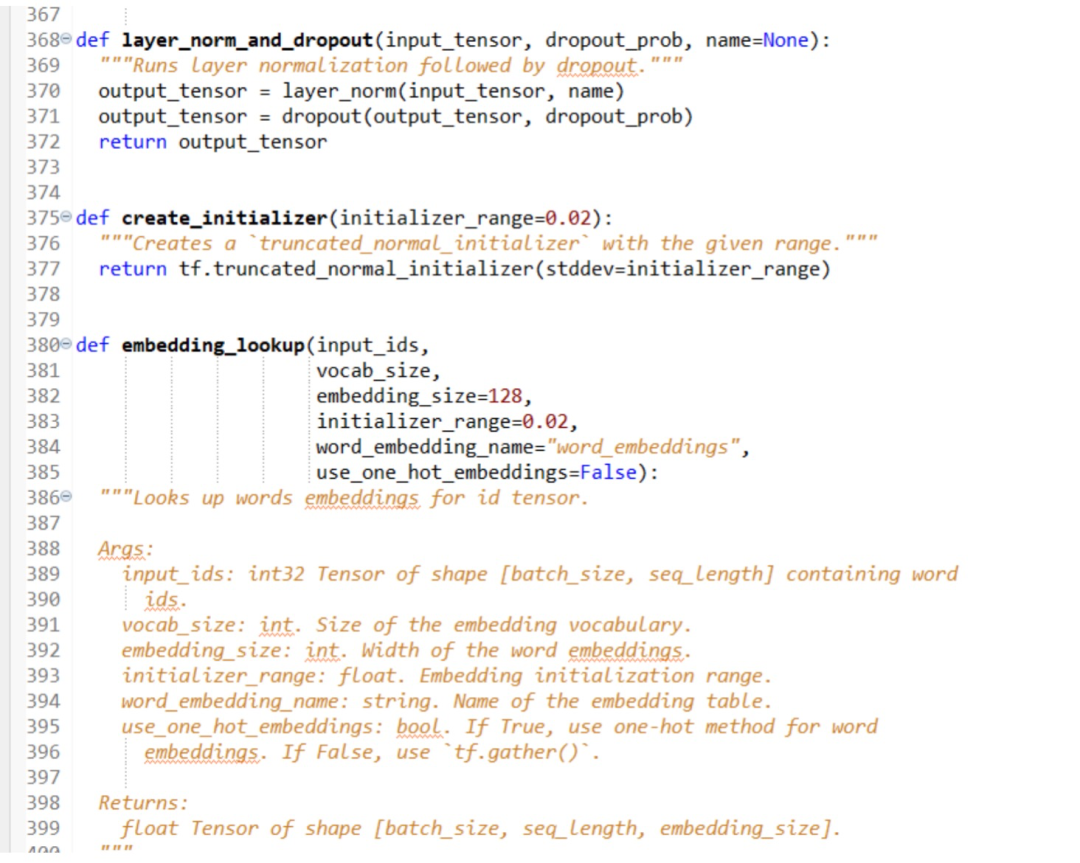

在自然语言处理(NLP)预训练任务中,Embedding 技术能够捕捉数据的语义信息,使得相似的数据在嵌入空间中更接近,有助于模型更好地理解数据之间的关系。典型的Transformer架构中,首先需要构建embedding层,即词嵌入,词嵌入操作将当前序列转化为向量。首先,获取embedding_table,然后到embedding_table里查找每个单词对应的词向量,并将最终结果返回给output,这样一来,输入的单词便成了词向量。但这个操作只是词嵌入的一部分,完整的词嵌入还应在词嵌入中添加其它额外的信息,即:embedding_post_processor。

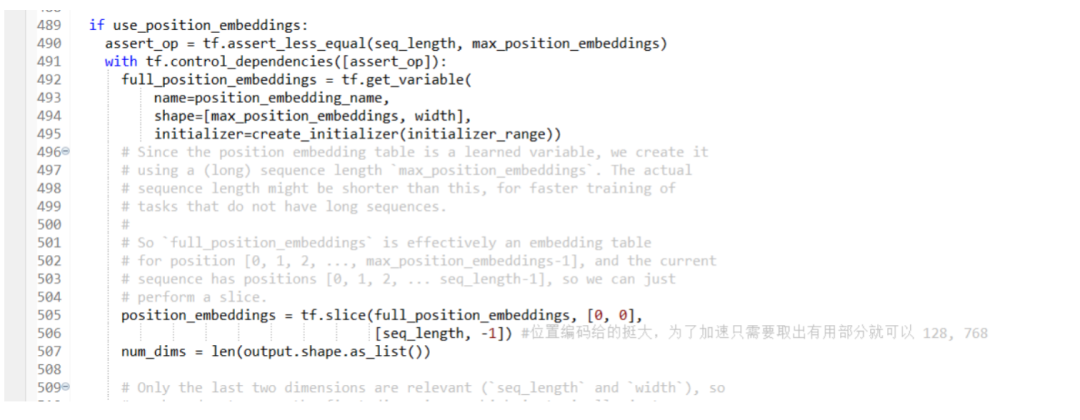

Embedding层不光要考虑输入的单词序列,还需要考虑其它的额外信息和位置信息。Transformer构建出来的词嵌入向量中包含以下三种信息:即输入单词序列信息、其它的额外信息和位置信息。为了实现向量间的计算,必须保持包含这三种信息的词向量的维数一致。

获得位置编码的输出结果之后,在原词嵌入输出向量的基础上,加上额外编码获得的特征向量和位置编码向量,将三个向量求和,返回求和结果,便完成了大语言模型的输入词嵌入,得到了一个包含位置信息的词向量。

Embedding 技术具有许多优点,以下是 Embedding 技术的主要优点:

- 语义信息捕捉:Embedding 技术能够捕捉数据的语义信息,使得相似的数据在嵌入空间中更接近,有助于模型更好地理解数据之间的关系。

- 维度约减:Embedding 技术将高维数据映射到低维空间,减少了计算和内存需求,提高了模型的效率。

- 上下文感知:嵌入向量通常是上下文感知的,可以考虑数据点与其周围数据点的关系,这对于自然语言处理等任务非常有用。

- 可训练:嵌入向量通常是可训练的,可以与模型一起训练,从而适应特定任务和数据集。

- 泛化能力:适当训练的嵌入可以提高模型的泛化能力,从而使其能够处理新数据和未知情况。

Embedding 技术有以下主要缺点:

- 数据依赖性:Embedding 技术的性能高度依赖于训练数据的质量和多样性。如果训练数据不足或不具代表性,嵌入可能不准确。

- 维度选择:选择适当的嵌入维度可以是挑战性的,太低的维度可能丧失信息,太高的维度可能增加计算成本。

- 过拟合:嵌入可以过度拟合训练数据,特别是在小数据集上。这可能导致模型在未见过的数据上表现不佳。

- 计算复杂性:在训练嵌入时,可能需要大量的计算资源和时间,尤其是对于大规模数据集和高维度嵌入。

- 可解释性差:嵌入向量通常是抽象的,难以解释。这使得难以理解模型为什么做出特定的预测或推荐。

总的来说,Embedding 技术为许多深度学习任务提供了有力的工具,但在使用时需要权衡其优点和缺点,并根据具体情况进行调整和改进。

编辑:王菁

数据派研究部介绍

数据派研究部成立于2017年初,以兴趣为核心划分多个组别,各组既遵循研究部整体的知识分享和实践项目规划,又各具特色:

算法模型组:积极组队参加kaggle等比赛,原创手把手教系列文章;

调研分析组:通过专访等方式调研大数据的应用,探索数据产品之美;

系统平台组:追踪大数据&人工智能系统平台技术前沿,对话专家;

自然语言处理组:重于实践,积极参加比赛及策划各类文本分析项目;

制造业大数据组:秉工业强国之梦,产学研政结合,挖掘数据价值;

数据可视化组:将信息与艺术融合,探索数据之美,学用可视化讲故事;

网络爬虫组:爬取网络信息,配合其他各组开发创意项目。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2023-11-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读