【人工智能】Transformers之Pipeline(二十八):视觉问答(visual-question-answering)

【人工智能】Transformers之Pipeline(二十八):视觉问答(visual-question-answering)

LDG_AGI

发布于 2024-12-11 07:37:19

发布于 2024-12-11 07:37:19

一、引言

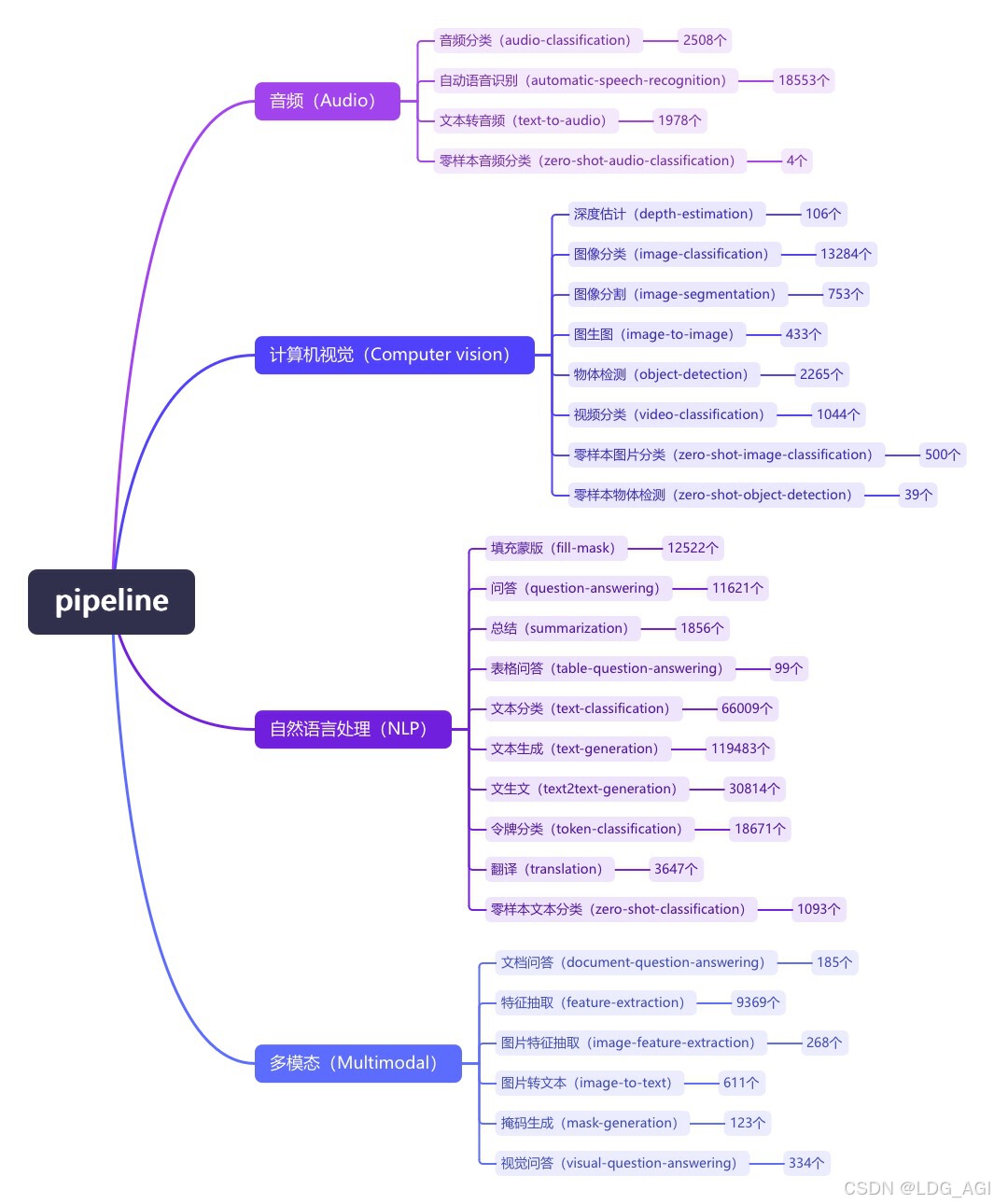

pipeline(管道)是huggingface transformers库中一种极简方式使用大模型推理的抽象,将所有大模型分为音频(Audio)、计算机视觉(Computer vision)、自然语言处理(NLP)、多模态(Multimodal)等4大类,28小类任务(tasks)。共计覆盖32万个模型

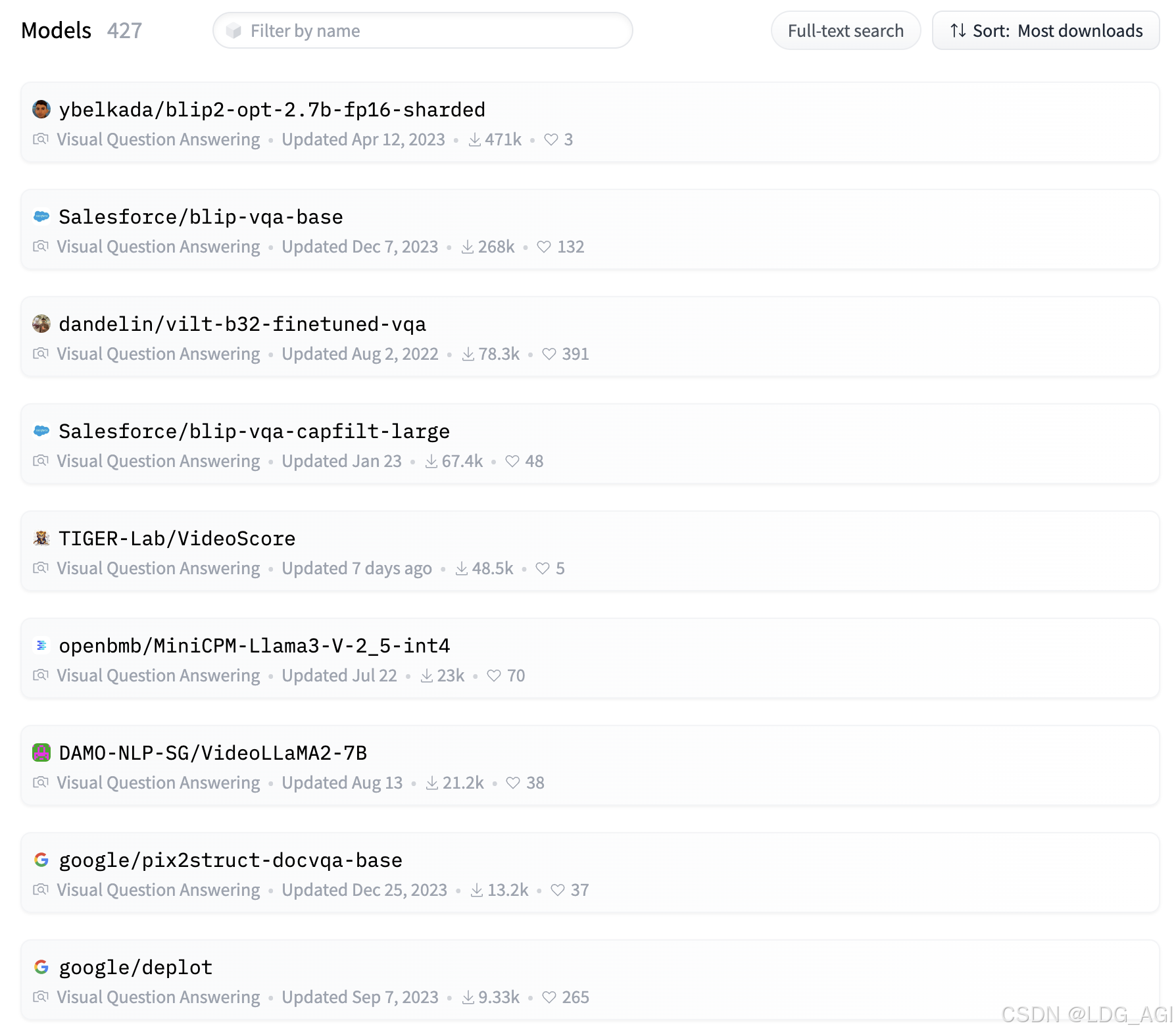

今天介绍多模态的第六篇,也是本专栏的最后一篇:视觉问答(visual-question-answering),在huggingface库内可以使用的视觉问答(visual-question-answering)模型有400个。

二、视觉问答(visual-question-answering)

2.1 概述

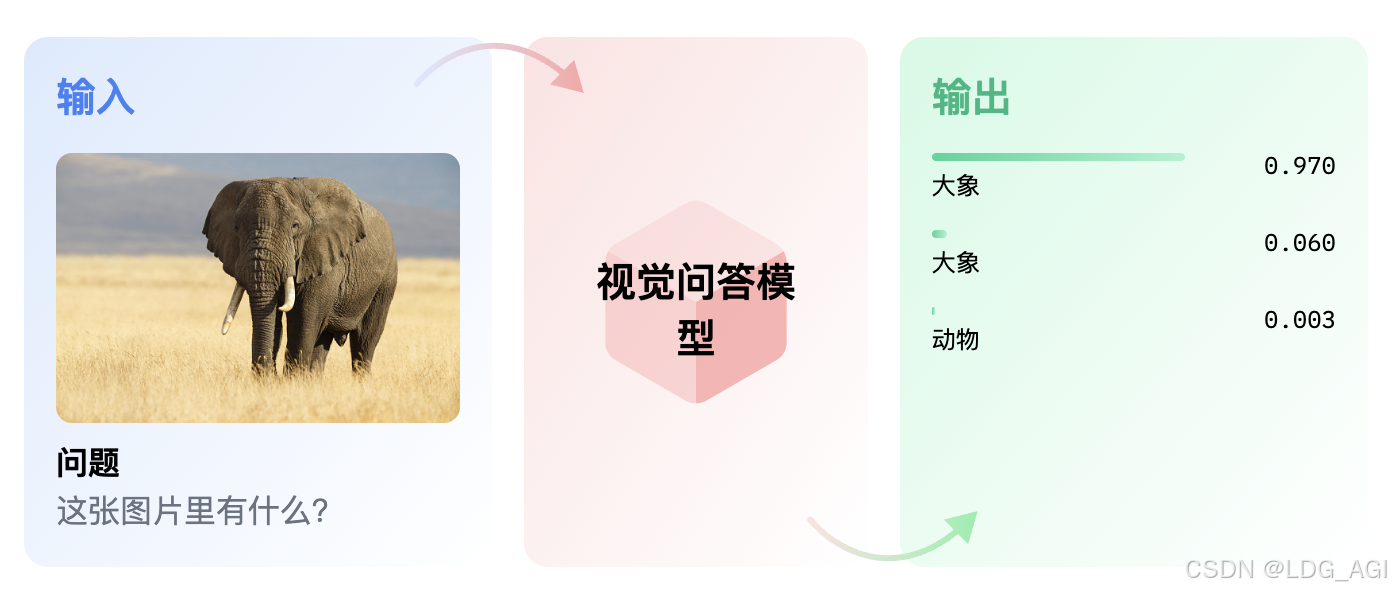

视觉问答(visual-question-answering)是根据图像回答开放式问题的任务。它们输出对自然语言问题的自然语言回答。

2.2 dandelin/ViLT

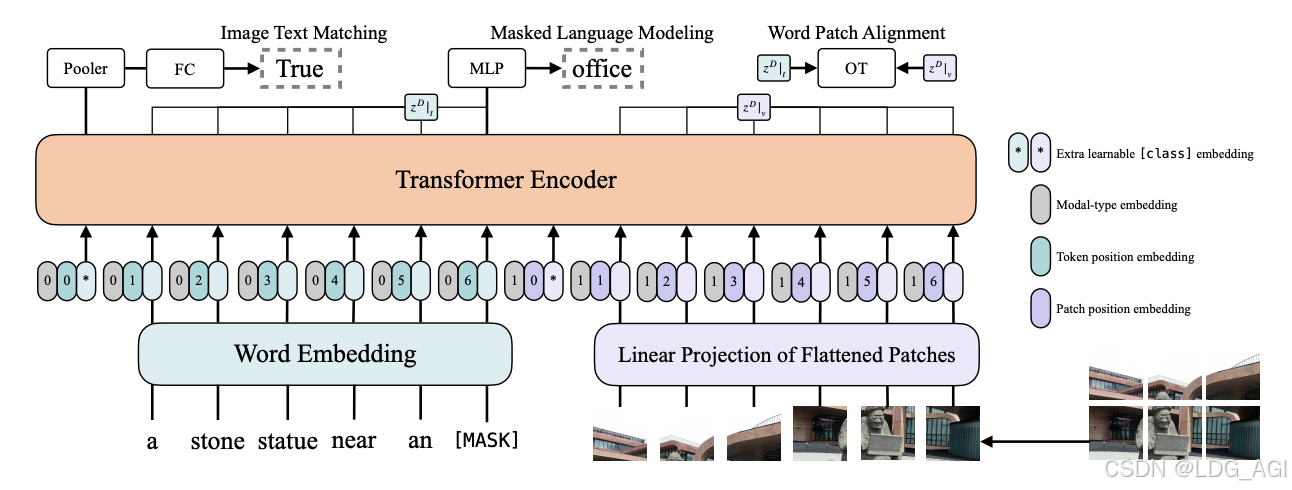

ViLT(Vision-and-Language Transformer Without Convolution or Region Supervision)可以认为是目前最简单的多模态Transformer方法。ViLT使用预训练的ViT来初始化交互的transformer,这样就可以直接利用交互层来处理视觉特征,不需要额外增加一个视觉encoder。

- 文本特征输入部分,将文本看成一个词序列,通过word embedding matrix转化成word embedding,然后和position embedding进行相加,最后和modal-type embedding进行concate。

- 图像特征输入部分,将图像切块看成一个图像块序列,通过linear projection转化成visual embedding,然后和postion embedding进行相加,最后和modal-type embedding进行concate。

- 其中word embedding和visual embedding通过可学习的modal-type embedding标志位来区分,其中0标志位表示word embedding部分,1标志位表示visual embedding部分。

- word embedding和visual embedding分别都嵌入了一个额外的可学习[class] embedding,方便和下游任务对接。

ViLT预训练的优化目标有两个:一个是image text matching(ITM),另一个是masked language modeling(MLM)。

- ImageText Matching:随机以0.5的概率将文本对应的图片替换成不同的图片,然后对文本标志位对应输出使用一个线性的ITM head将输出feature映射成一个二值logits,用来判断图像文本是否匹配。另外ViLT还设计了一个word patch alignment (WPA)来计算textual subset和visual subset的对齐分数。

- Masked Language Modeling:MLM的目标是通过文本的上下文信息去预测masked的文本tokens。随机以0.15的概率mask掉tokens,然后文本输出接两层MLP与车mask掉的tokens。

- Whole Word Masking:另外ViLT还使用了whole word masking技巧。whole word masking是将连续的子词tokens进行mask的技巧,避免了只通过单词上下文进行预测。比如将“giraffe”词tokenized成3个部分["gi", "##raf", "##fe"],可以mask成["gi", "[MASK]", "##fe"],模型会通过mask的上下文信息[“gi”,“##fe”]来预测mask的“##raf”,就会导致不利用图像信息。作者将这个单词全都mask掉,这样就需要借助图像的信息来还原单词。

2.3 pipeline参数

2.3.1 pipeline对象实例化参数

- model(PreTrainedModel或TFPreTrainedModel)— 管道将使用其进行预测的模型。 对于 PyTorch,这需要从PreTrainedModel继承;对于 TensorFlow,这需要从TFPreTrainedModel继承。

- tokenizer ( PreTrainedTokenizer ) — 管道将使用其对模型的数据进行编码的 tokenizer。此对象继承自 PreTrainedTokenizer。

- image_processor ( BaseImageProcessor ) — 管道将使用的图像处理器来为模型编码数据。此对象继承自 BaseImageProcessor。

- modelcard(

str或ModelCard,可选) — 属于此管道模型的模型卡。 - framework(

str,可选)— 要使用的框架,"pt"适用于 PyTorch 或"tf"TensorFlow。必须安装指定的框架。 - task(

str,默认为"")— 管道的任务标识符。 - num_workers(

int,可选,默认为 8)— 当管道将使用DataLoader(传递数据集时,在 Pytorch 模型的 GPU 上)时,要使用的工作者数量。 - batch_size(

int,可选,默认为 1)— 当管道将使用DataLoader(传递数据集时,在 Pytorch 模型的 GPU 上)时,要使用的批次的大小,对于推理来说,这并不总是有益的,请阅读使用管道进行批处理。 - args_parser(ArgumentHandler,可选) - 引用负责解析提供的管道参数的对象。

- device(

int,可选,默认为 -1)— CPU/GPU 支持的设备序号。将其设置为 -1 将利用 CPU,设置为正数将在关联的 CUDA 设备 ID 上运行模型。您可以传递本机torch.device或str太 - torch_dtype(

str或torch.dtype,可选) - 直接发送model_kwargs(只是一种更简单的快捷方式)以使用此模型的可用精度(torch.float16,,torch.bfloat16...或"auto") - binary_output(

bool,可选,默认为False)——标志指示管道的输出是否应以序列化格式(即 pickle)或原始输出数据(例如文本)进行。

2.3.2 pipeline对象使用参数

- image(

str、List[str]、或PIL.Image)——管道处理三种类型的图像:List[PIL.Image]KeyDataset - 包含指向图像的 http 链接的字符串

- 包含图像本地路径的字符串

- 直接在 PIL 中加载的图像

2.3.3 pipeline对象返回参数

- label(

str) — 模型标识的标签。 - score(

int) — 模型为该标签评定的分数。

2.4 pipeline实战

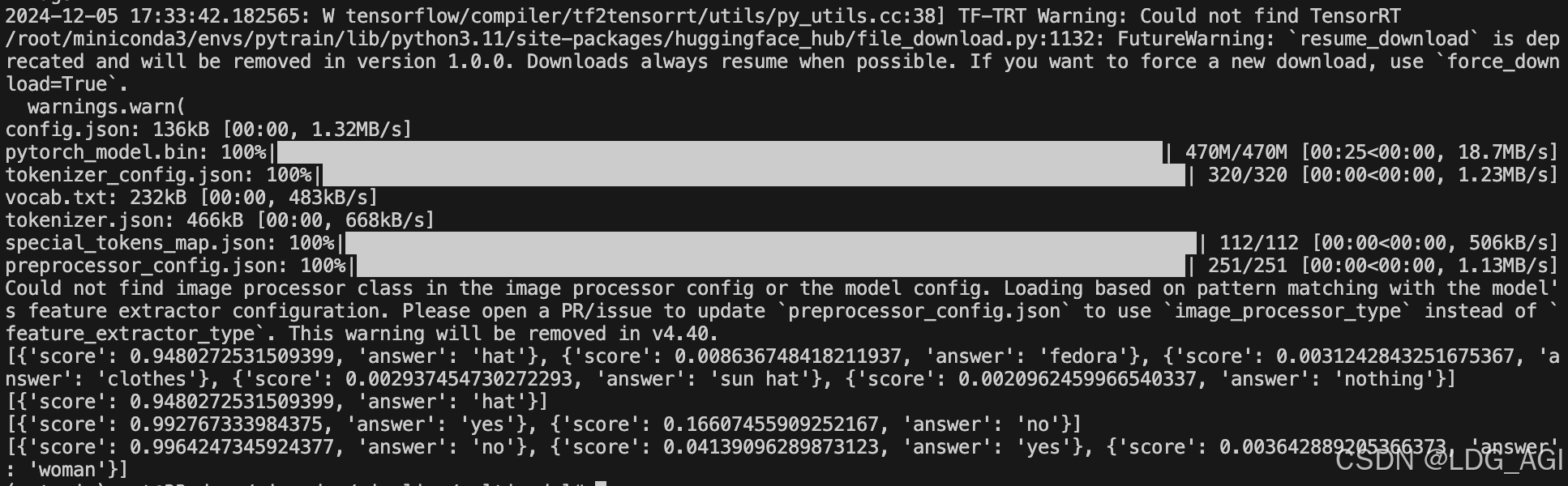

基于pipeline的视觉问答(visual-question-answering)任务,采用dandelin/vilt-b32-finetuned-vqa对图片进行视觉问答,代码如下:

import os

os.environ["HF_ENDPOINT"] = "https://hf-mirror.com"

os.environ["CUDA_VISIBLE_DEVICES"] = "2"

from transformers import pipeline

oracle = pipeline(task="vqa",model="dandelin/vilt-b32-finetuned-vqa")

image_url = "./lena.png"

output=oracle(question="What is she wearing ?", image=image_url)

print(output)

output=oracle(question="What is she wearing ?", image=image_url, top_k=1)

print(output)

output=oracle(question="Is this a person ?", image=image_url, top_k=2)

print(output)

output=oracle(question="Is this a man ?", image=image_url, top_k=3)

print(output)执行后,自动下载模型文件并基于图片,对提出的文本问题进行视觉回答。

2.5 模型排名

在huggingface上,我们将视觉问答(visual-question-answering)模型按下载量从高到低排序,共计427个模型中,文中的ViLT模型排名第三。

三、总结

本文对transformers之pipeline的视觉问答(visual-question-answering)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文中的2行代码极简的使用多模态中的视觉问答(visual-question-answering)模型。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2024-12-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录