高能效光互连(200G LPO、慢而宽光互连、RF微波)与液冷系统

在AI数据中心需求持续爆发的背景下,降低光学传输与连接系统的功耗、优化散热架构已成为行业核心诉求。在HotI 2025会议上,Arista Networks的Andy大佬从高效光学技术与液冷系统两大维度,全面解析当前行业内的技术进展、200G /lane LPO初步测试成果、面临挑战及解决方案。

一、高效光学系统:低功耗与性能的平衡探索

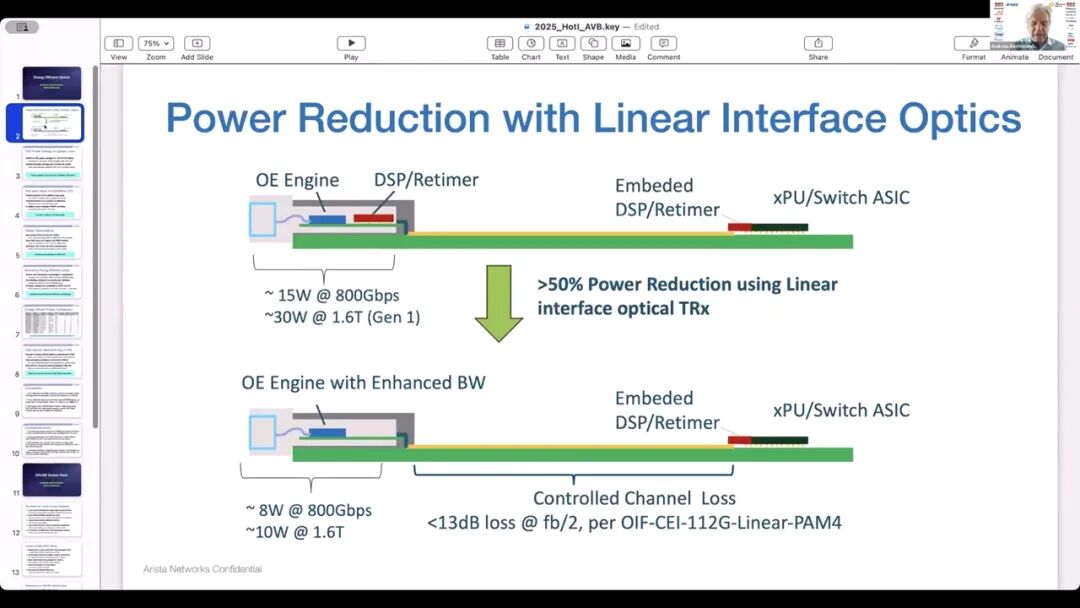

◆ 线性接口的功耗优势:LPO的典型案例

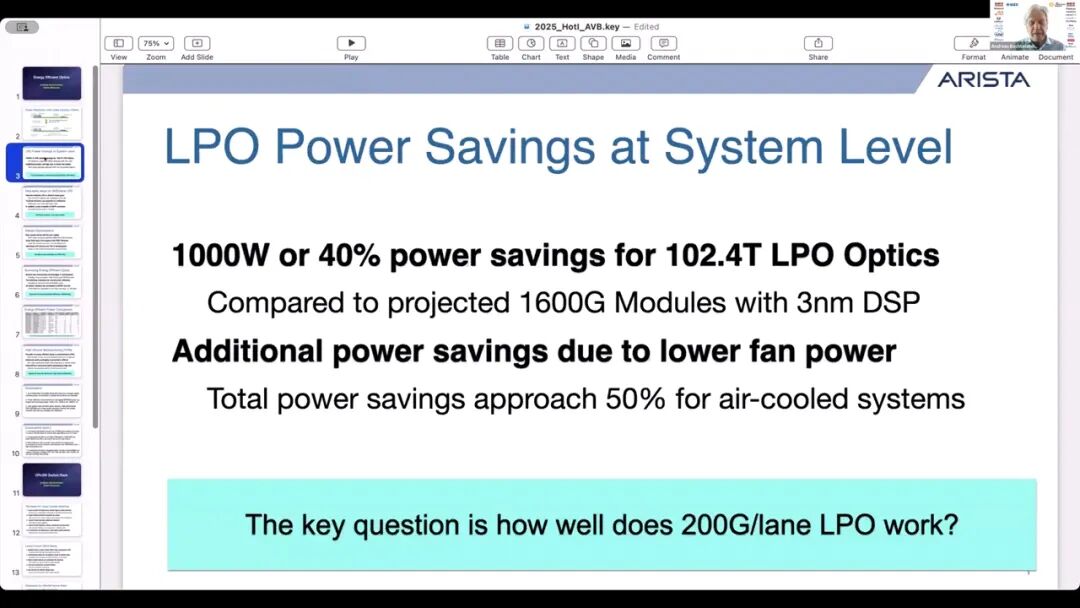

线性接口在接口光学中带来的功耗降低已成为行业共识,且这种优势与接口类型(LPO、NPO、CPO)的关联性较弱。以LPO(线性可插拔光学)为例,传统DSP光学模块的功耗表现如下:第一代1.6T DSP模块功耗为30W,基于3nm制程的版本降至25W,而LPO版本直接低至10W,单模块功耗实现显著下降。

若进一步考虑低风扇功耗带来的额外节能,在风冷系统中,LPO技术的系统级功耗节省可接近50%,这对AI数据中心的整体能效优化具有重要意义。

◆ 200Gb/ lane LPO模块的测试进展与挑战

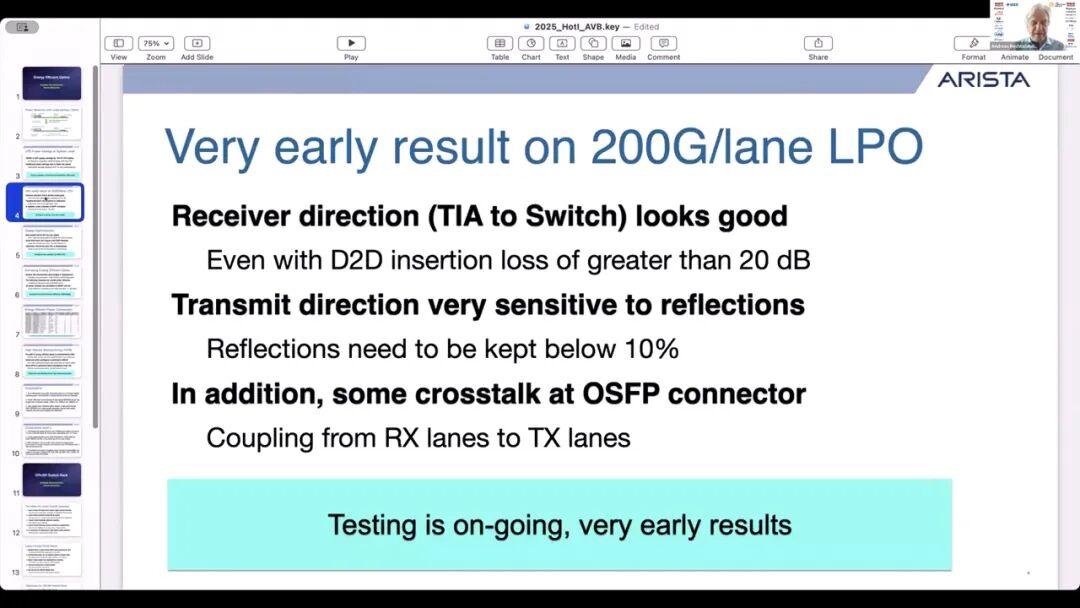

当前200Gb/ lane LPO模块的测试仍处于早期阶段,已获取的初步数据呈现出明显的方向差异:

- 接收方向表现优异:从光学TIA(跨阻放大器)到交换芯片的接收链路性能良好,即便在D2D(芯片到芯片)插入损耗超过20dB的情况下,仍能实现极低的误码率,满足技术指标要求。

- 发射方向还需要优化:发射链路对反射极为敏感,尤其是OSFP连接器处的反射问题,需进一步优化以提升性能;同时,OSFP连接器层面还存在串扰现象——从TIA输出的Rx(接收) lanes与输入至驱动器的Tx(发射) lanes之间会产生信号干扰。

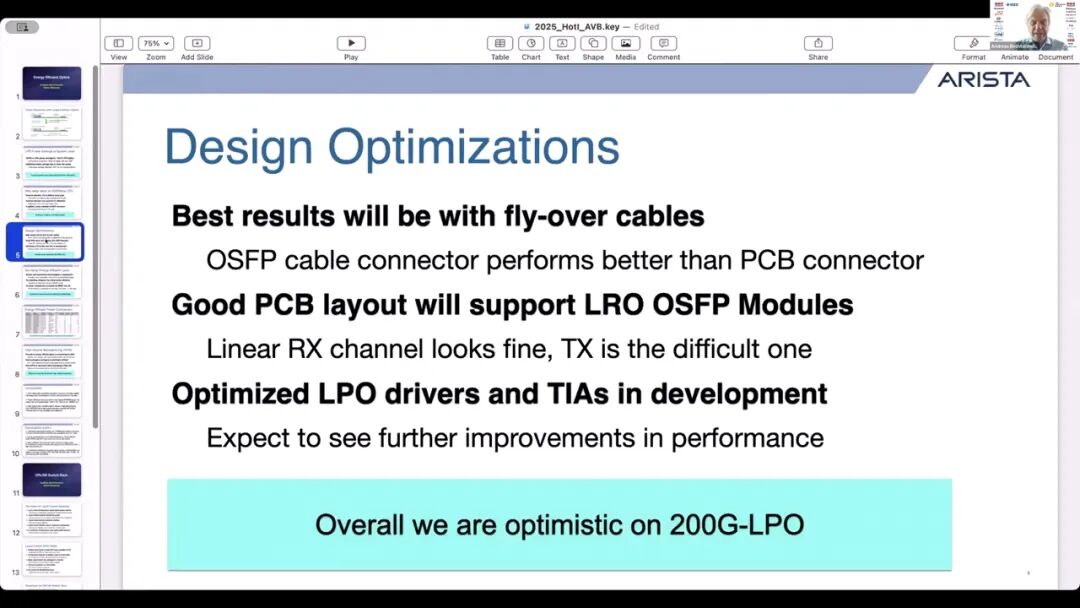

针对上述问题,目前已有初步解决方案思路:采用飞线电缆(flyover cables)可改善信号传输质量,OSFP电缆型连接器的性能显著优于PCB板载连接器,而采用传统走线的PCB板布局仍可支持LPO模块。此外,新一版优化的LPO DRV与TIA仍处于研发阶段,预计这些芯片量产落地后,LPO模块的整体性能将进一步提升。Arista对于200G LPO的可行性还是持乐观态度的。

◆ 多类节能传输技术的功率效率分析

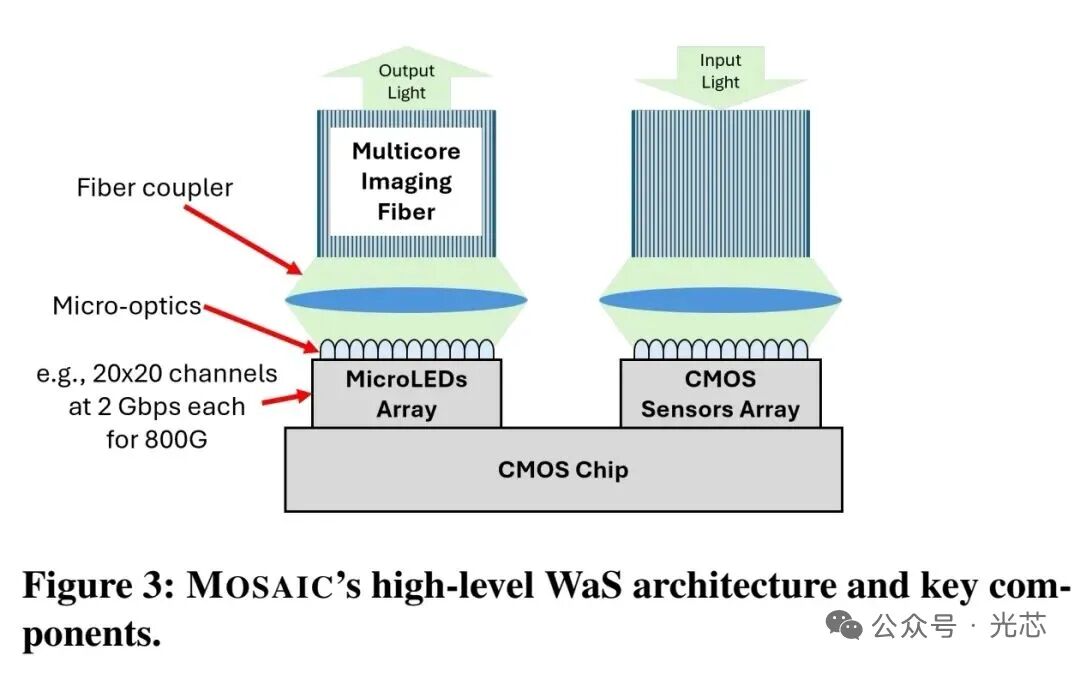

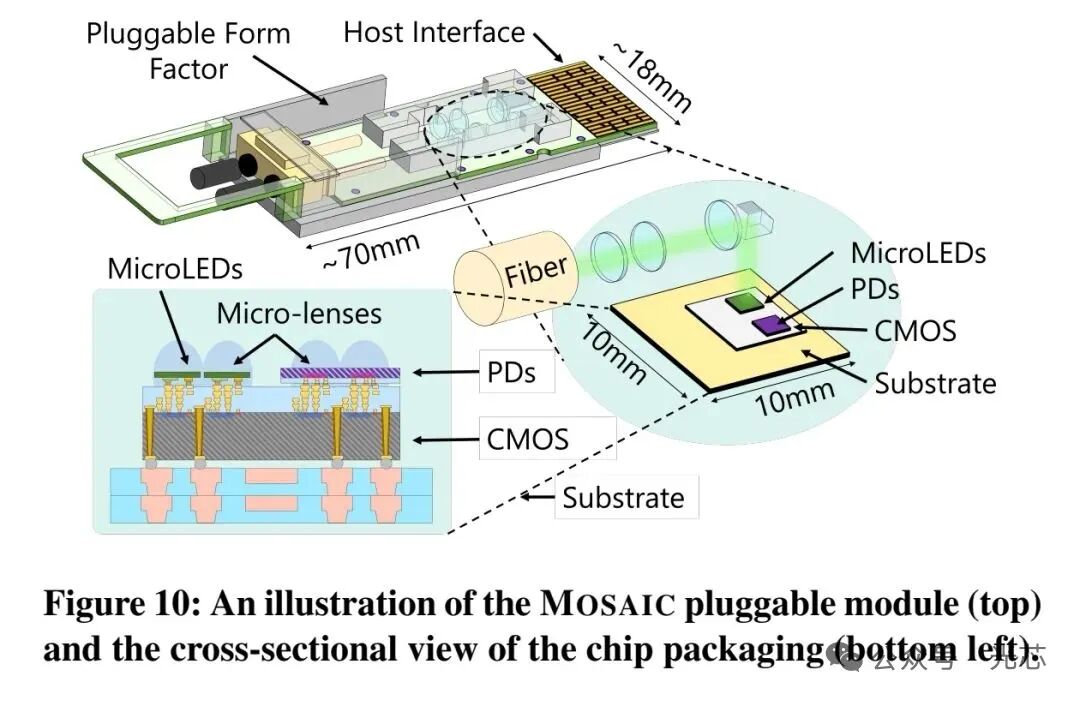

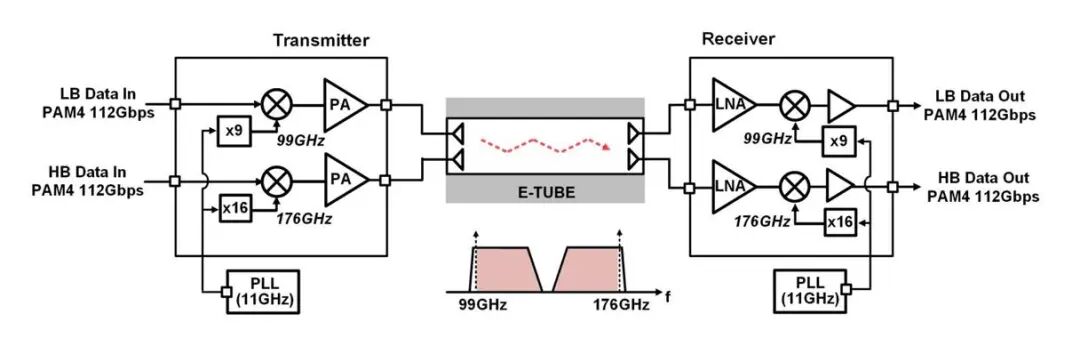

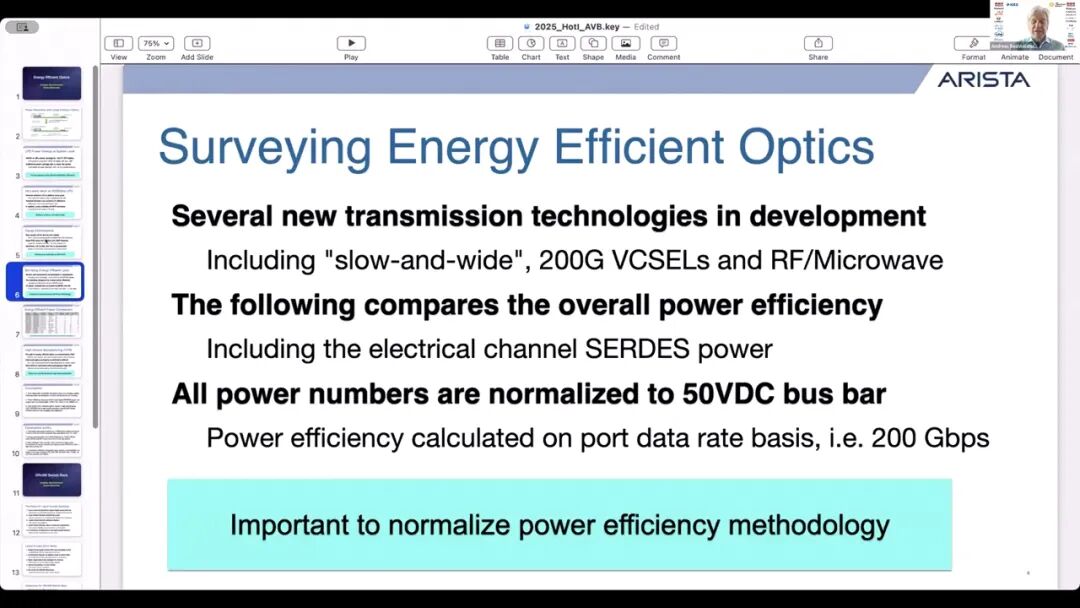

除LPO外,行业内还在研发多种低功耗传输技术,包括慢而宽(slow and wide optics)的microLED/VCSEL、200G VCSEL、RF微波技术等。

MicroLED:微软研究院SIGCOMM论文:MicroLED光互连技术打破光铜取舍,实现高带宽、低功耗、高可靠三者兼得

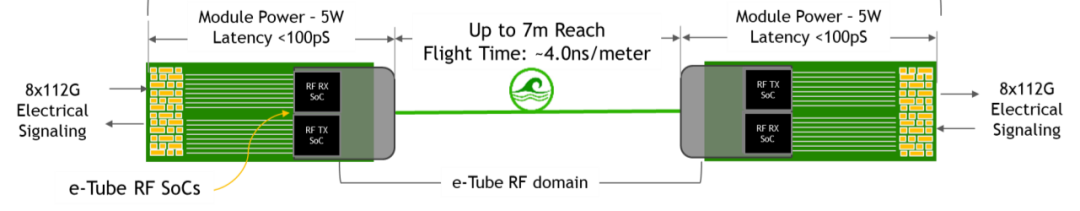

RF微波技术:高速RF收发芯片+塑料波导:<3pJ/b能效+近零时延e-Tube技术为AI集群提供低功耗高可靠互联方案

补充一下RF方案原理和时延的说明

在评估这些技术的功率效率时,需遵循统一的计算标准:

- 功率数值均归一化至“壁插功率”(Wall plug power)或ORv3机架的50V母线水平,避免因基准差异导致的对比偏差;

- 功率效率基于200Gb计算而非224Gb(后者会使效率结果偏高10%)。

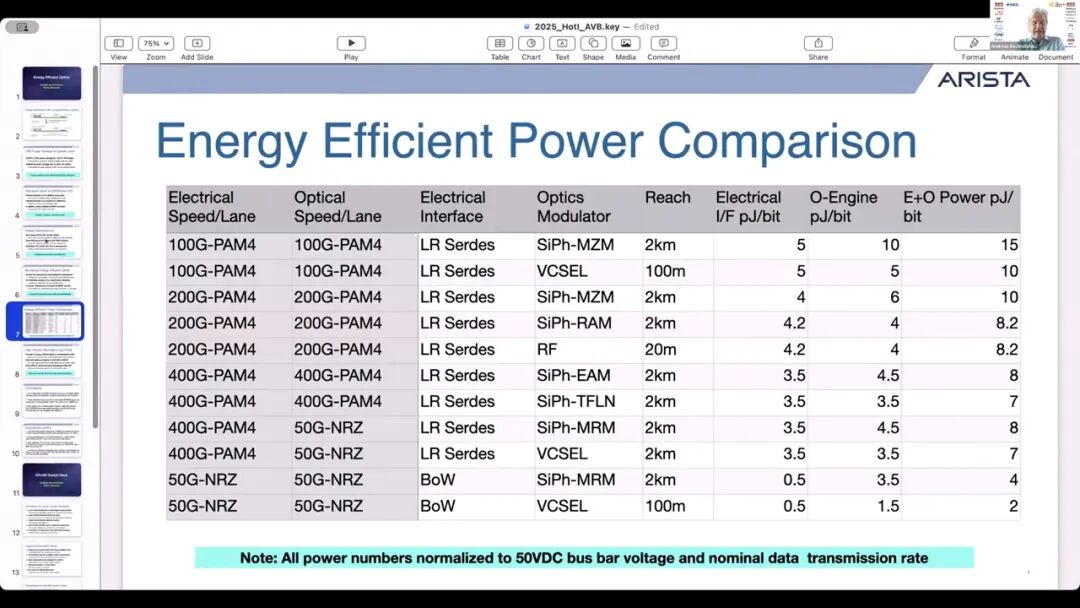

不同技术的功率效率表现具体如下:

(1)100Gb/ lane到200Gb/ lane的技术迭代

200Gb/ lane技术的光学引擎功耗较100Gb/ lane降低近一半,尽管电功耗也有下降(主要源于制程升级:100G serdes多基于5nm制程,200Gb serdes多采用3nm制程),但光学引擎的功耗降幅更为显著。实际应用中(硅光方案),电接口功耗约为10pJ/bit,光学引擎功耗约为6pJ/bit,两者结合实现了整体能效的跃升。

(2)200Gb LR serdes的技术拓展

在200Gb LR(长距离)serdes基础上,搭配不同光学组件可进一步优化功耗:例如采用高线性度环形辅助调制器(ring assisted modulators)或未来的RF微波芯片(虽传输距离有限,但功耗更低),有望实现约20%的额外功耗降低,进一步拓展低功耗应用场景。

(3)400Gb/ lane的技术挑战

400Gb/ lane目前仍处于预测阶段,基于2nm制程的serdes有望进一步降低电功耗,线性接口的光学部分功耗也将略有下降,理论上400Gb LPO模块可实现低功耗运行。但该技术面临核心瓶颈——电通道设计难度极大:

- PAM4信号(交换芯片输出的106GHz奈奎斯特频率信号)即便通过飞线电缆传输至前面板可插拔模块,仍难以稳定工作;

- 行业普遍考虑采用电侧PAM6解决方案,再通过DSP芯片转换为光侧PAM4信号,但DSP芯片会完全抵消功耗优势,导致400Gb模块功耗远高于200Gb LPO、RF微波等技术。

(4)慢而宽光学技术的特点

以50Gb NRZ(不归零码)技术为例,慢宽光学的核心是通过“逆齿轮箱”(inverse gearbox)将高速通道转换为低速通道(其他方案还包括25Gb、4Gb microLED等)。逆齿轮箱基于先进制程时,功耗约为3.5-4pJ/bit,光学部分功耗则因技术类型不同在1 pJ/bit以上,整体功耗取决于组件的搭配方式。在这张表格统计中,可以看到BoW结合慢而宽50G VCSEL的功耗表现最优。

综上,功耗最低的方案当属慢而宽的光学类技术(VCSEL、microLED),其次是适用于短距离场景的RF微波方案,再之后是各类硅光技术方案。

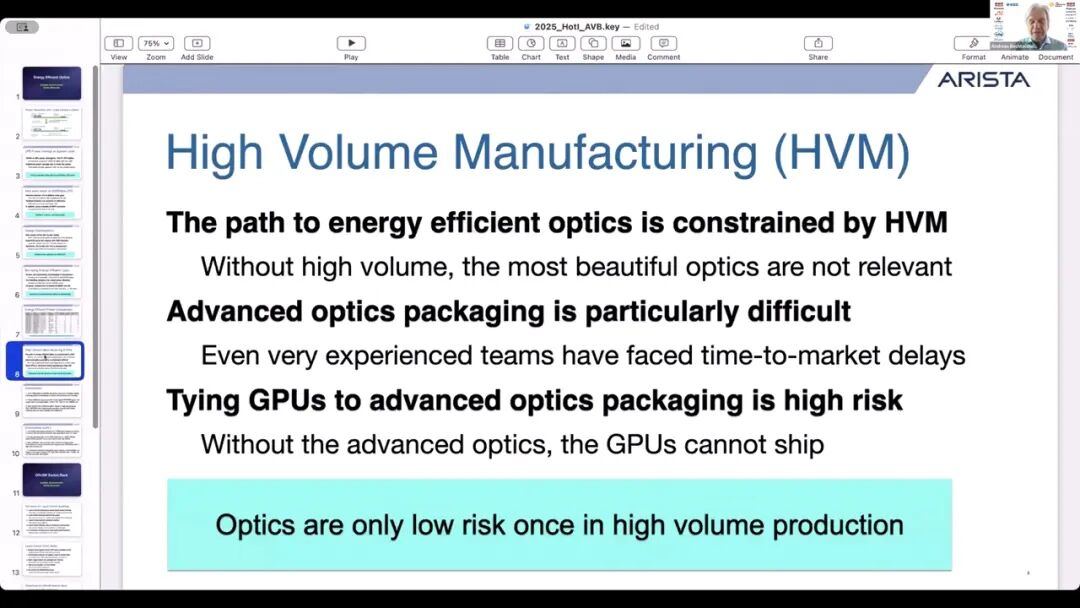

◆ 大规模量产(HVM)对光学技术的关键意义

无论某种光学技术的性能与能效多么优异,若无法实现大规模量产(HVM),则难以具备实际应用价值。当前先进光学封装的量产面临显著挑战:即便经验丰富的技术团队,也常遭遇上市时间延迟问题;若将先进光学封装与下一代GPU或交换芯片结合,还会在GPU本身的量产风险基础上叠加光学封装的风险——缺少适配的光学组件,GPU与交换芯片将无法正常交付。

因此,只有经过量产验证的光学技术,才能被视为低风险方案,具备大规模应用的条件。例如前面所展示的,将原生50Gb每通道(也可能是32Gb每通道)光学组件,以基板级封装的形式与GPU交换ASIC共封装,确实能实现低功耗。但在得到验证之前,这种方案仍存在显著的量产风险。相比之下,可插拔光模块无疑解决了各类光学技术(包括LPO、LRO、DSP、硅光、EML、VCSEL、RF及慢而宽光学等)的可维护性与可支持性问题。

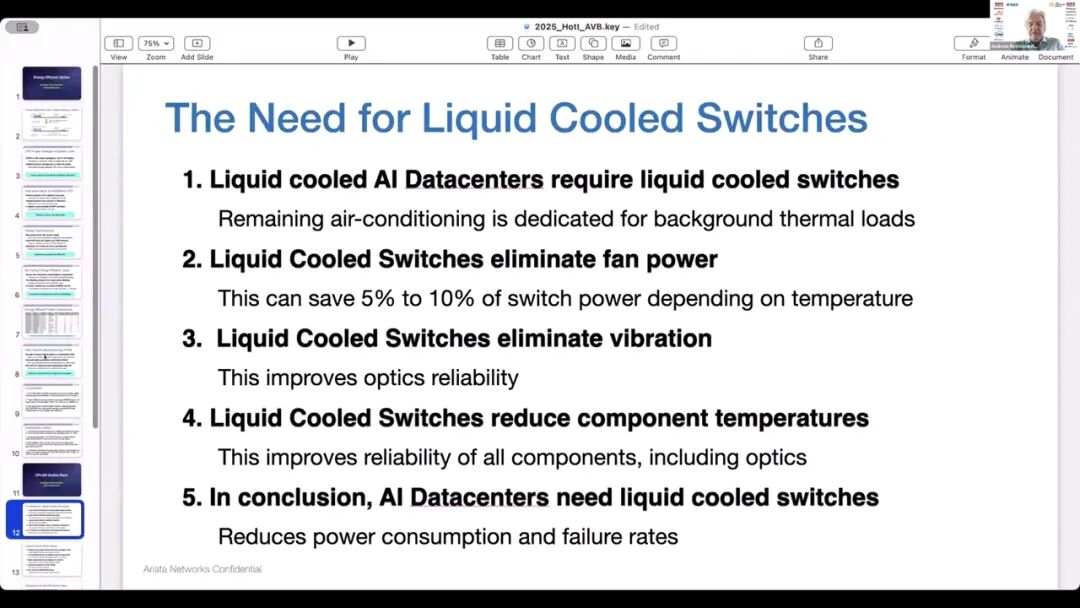

二、液冷系统:AI数据中心的散热刚需与技术创新

◆ 液冷交换机的必要性与核心优势

在液冷AI数据中心中,空调系统仅能处理背景热负荷,无法为交换机等设备提供有效散热,因此液冷交换机成为必然选择。液冷交换机的优势主要体现在三方面:

1. 降低整体功耗:移除风扇可节省总功率的5%-10%(具体比例取决于环境温度),直接优化数据中心的能效指标;

2. 提升光学可靠性:风扇振动也是影响光学组件故障率的重要因素之一(振动减少可降低光学适配偏差);

3. 延长组件寿命:较低的工作温度可提升包括光学组件在内的所有部件的可靠性,降低运维成本。

◆ ORV3机架的优化方向:ORV3W宽机架提案

行业内已提出多种液冷ORV3机架方案(如HPR——高性能机架,支持144kW母线,包含英伟达等企业的技术贡献),但这些方案均未解决交换机机架的核心需求:充足的光纤与电缆布线空间,以及交换机blades的便捷插入机制。

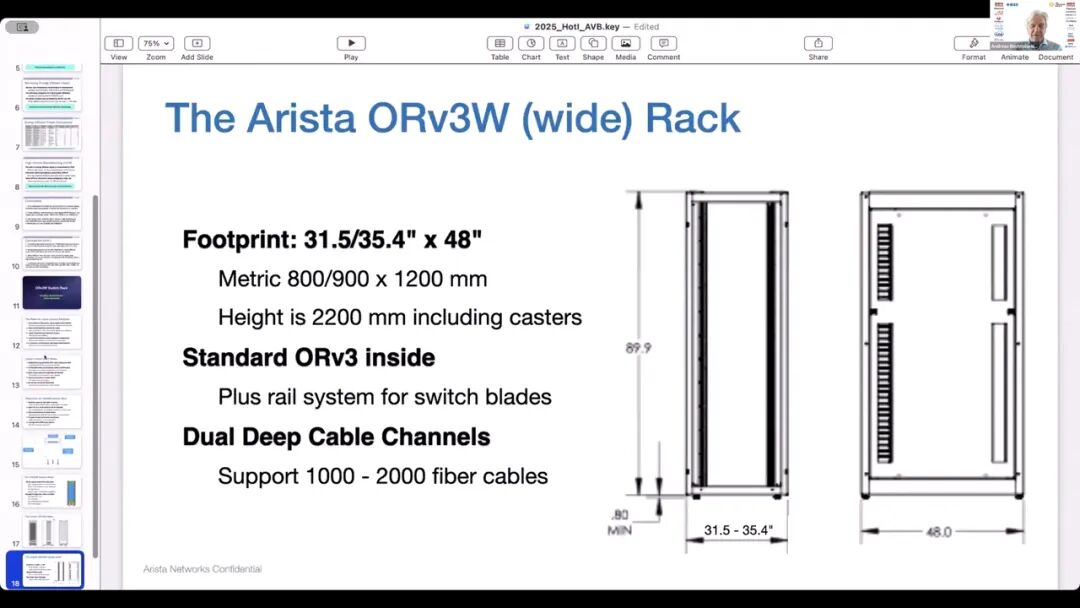

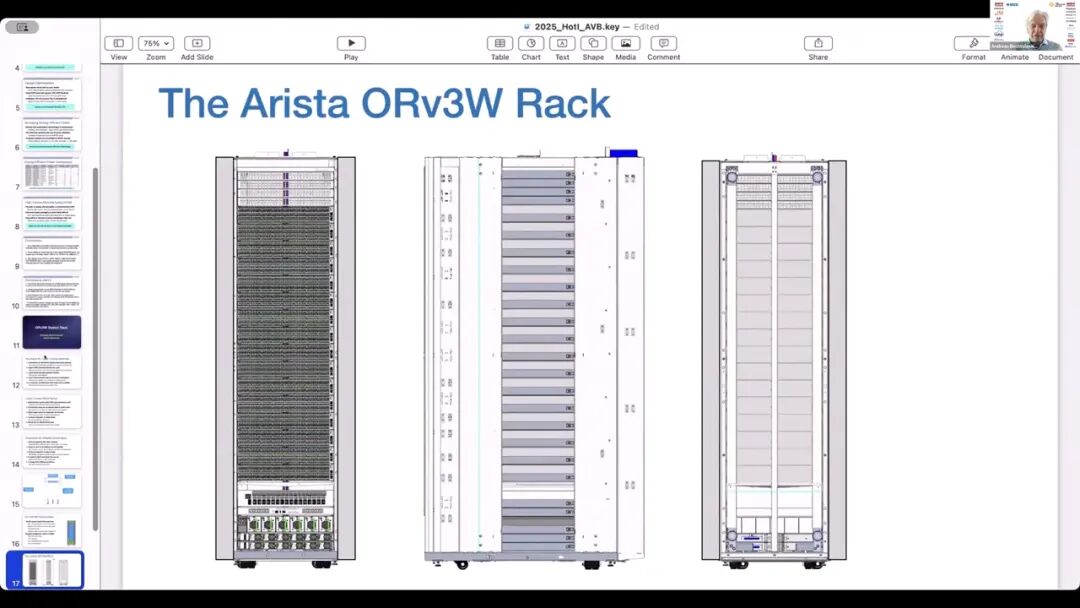

针对这一痛点,Arista提出“ORv3W宽机架”方案(“W”代表“wide”),其核心设计目标是适配下一代高密度交换机,具体特点如下:

- 充足布线空间:提供充裕的光纤和电缆通道空间,支持1000-2000根光纤电缆。

- 高设备容纳量:可容纳最多16个2U交换机刀片(总320U有效负载空间),同时兼容4U电源架、4U管理交换机、4U配线架。

- 便捷安装维护:支持交换机刀片无工具安装,配备带注入器/弹出器的标准化导轨系统,确保设备稳固固定。

- 精准液冷连接:液冷快速接头在X、Y、Z三个维度均精准定位,保障液冷系统稳定运行。

- 兼容现有技术:内部保留标准ORv3架构,可复用ORv3 HPR2电源架及机架级管理系统。

关键参数如下:

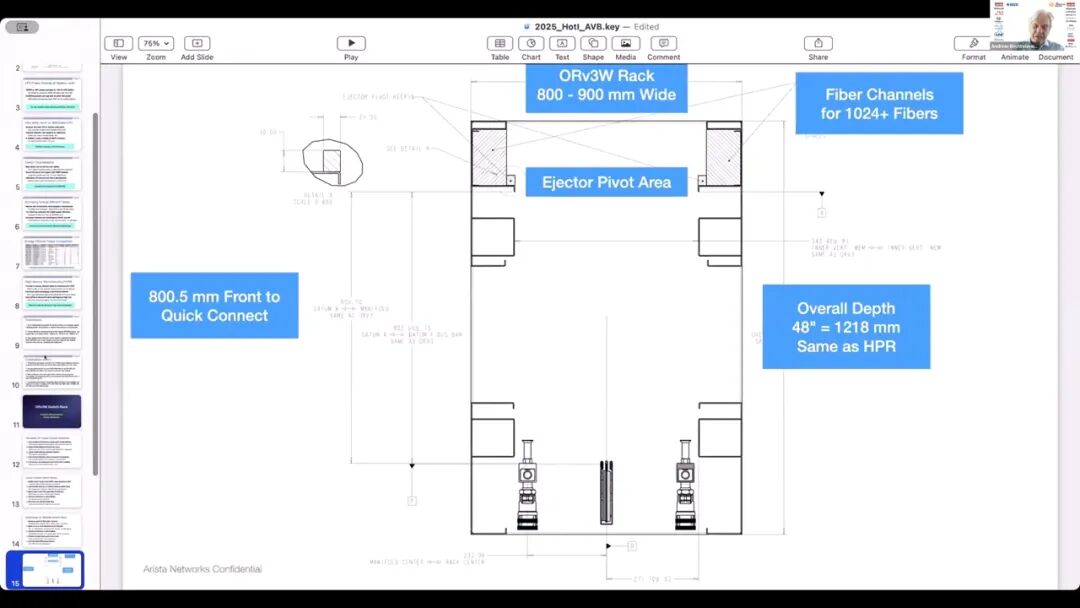

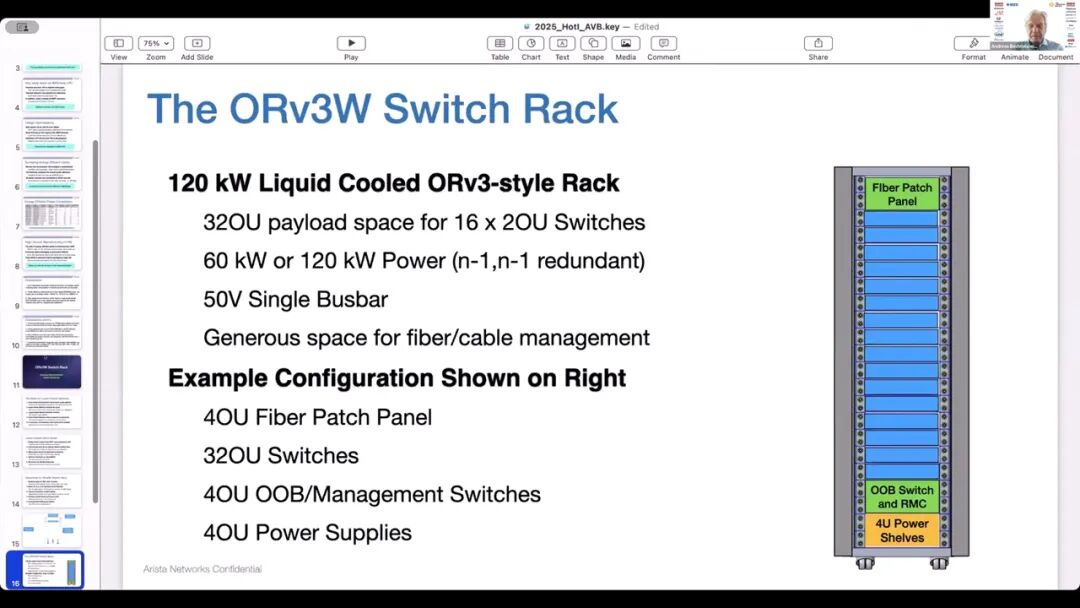

- 尺寸:宽度800-900毫米(英制31.5-35.4英寸),深度与HPR机架一致为1218毫米(48英寸),高度2200毫米(含支脚),采用双深层电缆通道设计。 - 功率与供电:支持60kW或120kW功率(均为n-1冗余配置),配备50V单母线。 - 有效负载:总320U有效负载空间,可配置16个2U交换机、4U光纤配线架、4U带外/管理交换机、4U电源供应器等。

Arista目前已计划将方案提交至OCP,希望通过推动高密度液冷交换机的标准化应用,避免出现大量客户定制化解决方案,降低制造商的研发与生产复杂度。目前该方案仍处于研发阶段,旨在为高密度交换机的落地提供关键架构支撑。

三、总结

AI数据中心的持续扩张对光学传输能效与散热架构提出了严苛要求。在光学领域,线性接口(如LPO)、慢而宽光学、RF微波等技术通过制程升级与组件优化,实现了功耗的显著降低,但高量产验证仍是技术落地的关键;在散热领域,液冷交换机成为刚需,ORv3W宽机架方案则为高密度交换机的部署提供了标准化架构思路。这些技术的协同发展,将为AI数据中心的高效、稳定运行提供核心支撑,同时推动行业向标准化、低功耗方向持续演进。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-09-03,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读