突破长序列建模瓶颈!谷歌Titans架构引入动态长期记忆机制

突破长序列建模瓶颈!谷歌Titans架构引入动态长期记忆机制

赛博解生

发布于 2026-04-09 13:05:04

发布于 2026-04-09 13:05:04

大家好,我是赛博解生酱。在处理长文档、代码或进行复杂对话时,你是否曾苦恼于当前的大语言模型常常“记性不好”,对话一长就忘了开头的内容?今天给大家深入解析一篇来自Google Research的前沿研究,它为我们带来了一种让AI拥有“真正长期记忆”的新思路。

在信息处理的日常中,我们常遇到一个困境:为了专注眼前的任务(短期记忆),我们不得不暂时搁置一些背景知识;而当需要调用这些知识时,又需要一个高效的“归档与检索系统”(长期记忆)。一个优秀的智能信息管理系统,其核心能力不在于记住所有细节,而在于能根据当前任务的“紧要程度”和“相关性”,动态决定哪些信息存入档案、哪些优先调阅、哪些可以清理。

在AI处理长序列的浩瀚任务中,也有这样一类模型,它不依赖无限扩展的昂贵算力,不满足于固定大小的记忆窗口,而是试图构建一个像高效信息中心一样具有“自适应性与可扩展性”的记忆系统——它就是Titans架构。

此前的模型,无论是Transformer还是Mamba,都在记忆机制上存在固有局限。今天介绍的这项研究,为“手残”又希望模型能“长效工作”的开发者与研究者们,提供了一条新路径——无需复杂工程魔改,也能在超长文本、基因组数据、时间序列中,让模型保持清醒的“记忆”与强大的推理能力。

基本信息

- 标题: Titans: Learning to Memorize at Test Time

- 出处: 预印本平台arXiv(cs.LG),2024年12月31日发布;作者包括Ali Behrouz、Peilin Zhong和Vahab Mirrokni,均来自Google Research。

- 核心内容: 本文提出了一种神经长期记忆模块,通过元学习机制在测试时动态记忆历史上下文,并基于此设计了Titans架构家族,在长序列任务(如语言建模、基因组分析)中显著优于Transformer和现代线性循环模型,同时支持超过200万Token的上下文窗口。

概要

论文的动机与待解决的问题

当前Transformer模型因注意力机制的二次复杂度难以处理长上下文任务(如语言建模、视频理解),而线性Transformer虽提升效率却因压缩信息至固定大小的矩阵状态而牺牲性能。此外,现有架构(如LSTM、Hopfield网络)缺乏对人脑记忆系统的多模块协同模拟,导致在泛化、长程推理和记忆管理方面存在局限。本文旨在解决长上下文建模的效率与效果平衡问题,并设计一种能够模拟人脑短期与长期记忆协同工作的神经网络架构。

论文的核心观点与贡献

论文的核心论点是:通过分离短期记忆(注意力)和长期记忆(神经记忆模块),并引入动态学习机制,可以构建高效且可扩展的序列模型。 这一观点的重要性在于,它突破了传统模型对固定上下文窗口的依赖,使模型能够像人类一样在测试时持续学习并管理记忆。论文通过理论推导和实验验证表明,这种设计不仅降低了计算复杂度,还提升了长程依赖的捕捉能力,为处理超长序列任务提供了新范式。

核心概念与技术贡献

核心概念的直观解读

- 【直观比喻】:将Titans架构比作一个智能图书馆系统。短期记忆(注意力)如同读者在阅览室(有限窗口)快速查阅当前书籍(当前Token),而长期记忆(神经记忆模块)则像图书馆的归档系统,根据书籍的“惊喜度”(如罕见内容)动态更新库存,并通过管理员(遗忘机制)定期清理过时信息。

- 【比喻映射】:

- 阅览室(短期记忆) 对应注意力机制,专注当前上下文。

- 归档系统(长期记忆) 对应神经记忆模块,通过梯度信号(惊喜度)学习存储历史信息。

- 管理员(遗忘机制) 对应权重衰减,动态管理记忆容量。 这一比喻揭示了Titans的核心逻辑:通过分工协作,实现高效且可持续的记忆管理。

关键技术细节实现

论文的核心技术依赖于元学习框架下的在线梯度优化。神经记忆模块 被建模为一个多层感知机(MLP),通过最小化关联记忆损失函数动态更新参数。关键公式包括:

- 惊喜度量:基于梯度的瞬时惊喜 ,其中损失函数定义为 。这里, 和 是键值对投影, 为可学习参数。

- 动量更新规则: 其中 控制历史惊喜的衰减, 为学习率, 是遗忘门控。该规则等效于带动量与权重衰减的梯度下降,确保了记忆的稳定更新。

论文的主要贡献点分析

- 贡献一:提出神经长期记忆模块——通过深度MLP结构()替代传统线性记忆,实现了非线性历史信息压缩,并在理论层面证明其表达力优于线性模型(基于Hornik等人1989年的通用近似定理)。

- 贡献二:设计Titans架构家族——包括三种变体:

- Memory as a Context (MAC):将记忆作为上下文的扩展,通过注意力机制筛选信息。

- Memory as a Gate (MAG):用门控机制融合短期注意力与长期记忆输出。

- Memory as a Layer (MAL):将记忆模块作为网络层堆叠,简化设计。

- 贡献三:大规模实验验证——在语言建模(困惑度降低约10%)、常识推理(准确率提升约5%)、长上下文任务(如2MToken的“大海捞针”任务)中均优于基线,并证明了其在时间序列预测和DNA建模中的泛化能力。

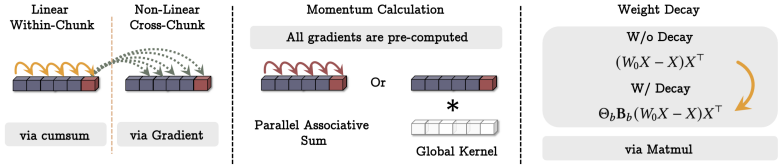

- 贡献四:并行化训练算法——通过张量化迷你批次梯度下降,将序列分块处理,利用矩阵乘法优化计算,实现近似线性的训练吞吐量(图1)。

图1

技术细节与实验验证

方法流程/理论证明

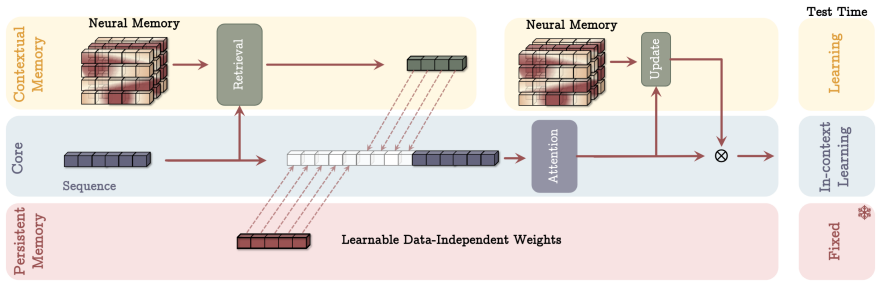

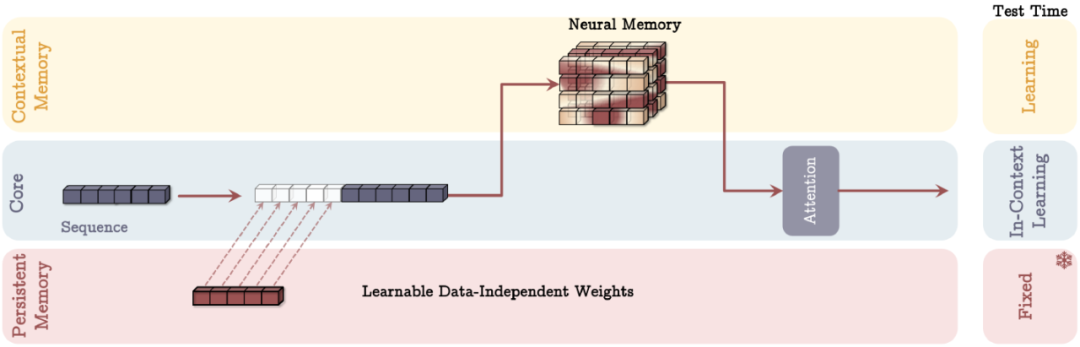

论文的核心方法基于一个分层的记忆系统,其整体框架将序列处理分解为三个协同模块:短期记忆(注意力机制)、长期记忆(神经记忆模块)和持久记忆(任务相关参数)。

相关背景与整体框架

- 前提假设:序列数据 的建模需要平衡局部依赖(短期记忆)和全局历史(长期记忆)。传统模型如Transformer因注意力机制的二次复杂度受限,而线性循环模型虽高效但压缩信息至固定大小状态,导致长上下文性能下降。

- 整体框架:Titans架构由三个分支组成,如图2:

- 核心分支(短期记忆):使用有限窗口的注意力机制,捕捉当前上下文的精确依赖。

- 长期记忆分支:神经记忆模块 (一个多层感知机,MLP),通过在线学习动态更新参数,存储历史信息。

- 持久记忆分支:可学习但数据无关的参数 ,编码任务先验知识,增强稳定性。

图2

详细步骤

- 问题形式化: 给定输入序列 ,目标是最小化序列建模的损失(如语言建模的困惑度)。记忆模块 需学习一个映射,将历史信息压缩到其参数中,并在测试时持续更新。

- 神经记忆模块的更新机制:

- ( 为雅可比矩阵),衡量当前输入与历史记忆的差异。

- 为数据依赖的衰减因子,控制历史惊喜的保留程度(如上下文切换时 )。

- 为数据依赖的学习率,调节瞬时惊喜的融入强度。

- 键值投影:对每个Token ,通过线性层投影为键和值:其中 为可学习参数,与Transformer类似,但此处 作为超参数在外部循环中优化。

- 关联记忆损失:定义损失函数衡量记忆模块的存储准确性:该损失强制 学习键值对的映射,类似于关联记忆。

- 惊喜度量与动量更新: 受人类记忆启发(意外事件更易记忆),论文用梯度幅值作为惊喜信号。更新规则结合动量以捕捉Token间的信息流:其中:

- 遗忘机制(权重衰减):为避免记忆溢出,引入门控机制:其中 控制遗忘比例(例如 时清空记忆)。该机制等效于梯度下降中的权重衰减,并推广了现代RNN(如Mamba)的遗忘门。

- 记忆检索:对于查询 ,通过前向传播(无权重更新)获取输出:此步骤允许模型从长期记忆中提取相关信息,而不改变记忆状态。

- 架构整合与并行化训练:

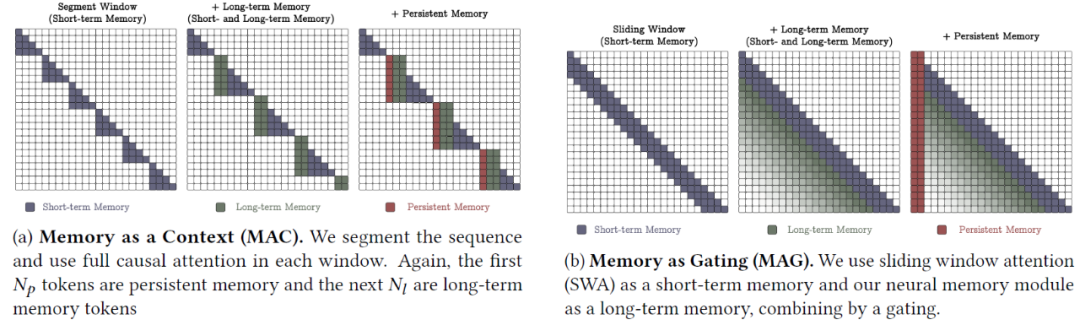

- Memory as a Context (MAC): 序列分块为段 ,每段处理时,从长期记忆检索历史信息 ,与持久记忆拼接后输入注意力层: 注意力掩码为全因果注意力(图3a),确保当前段仅访问历史记忆和持久记忆。最后,用 更新长期记忆:。

- Memory as a Gate (MAG): 直接在整个序列上操作,短期记忆分支使用滑动窗口注意力(SWA),长期记忆分支输出与注意力结果通过门控融合: 其中 , 为元素级乘法, 为非线性激活(图3b)。

- 图3

- Memory as a Layer (MAL): 将神经记忆模块作为网络层序列化堆叠(图4),先应用记忆模块压缩输入,再送入注意力层:

图4

- Titans变体设计:

- 并行化实现: 为加速训练,论文将序列分块(块大小 ),利用矩阵乘法并行计算梯度更新。对于线性记忆(),迷你批次梯度下降可重构为: 其中 ,。该形式仅需存储每块的对角矩阵 和 ,通过关联扫描并行化动量项计算。

- 理论保证:

- 定理4.1:证明Titans能解决超越复杂度类TC0的问题(如状态跟踪),而Transformer和线性循环模型限于TC0。这源于神经记忆模块的深度非线性结构(),其表达力严格优于线性模型(基于Hornik等人1989年的通用近似定理)。

结论

最终产出的核心模型是一个动态更新的记忆系统,支持测试时在线学习。其创新点在于通过元学习机制(梯度下降+动量+遗忘)实现长期记忆管理,并通过三种架构变体平衡效率与性能。

实验验证与应用流程

实验部分旨在全面验证Titans在长上下文任务中的有效性、可扩展性和泛化能力。以下以流程化方式详细说明实验设计、执行与结果分析。

目标

- 主要目标:验证Titans相比基线(如Transformer、Mamba)在长序列建模上的优势,包括:

- 降低困惑度(语言建模)。

- 提升长程推理准确率(如“大海捞针”任务)。

- 保持训练效率(吞吐量分析)。

- 次要目标:评估组件贡献(消融研究)及跨领域泛化(时间序列、DNA建模)。

流程

- 数据集与环境设置:

- 语言建模:使用FineWeb-Edu数据集(15B或30BToken),训练序列长度4K,词汇表32K(Llama 2分词器)。

- 常识推理:包括PIQA(物理推理)、HellaSwag(句子补全)、ARC(推理挑战)等基准。

- 长上下文任务: - 大海捞针(S-NIAH),从RULER基准选取,序列长度2K–16KToken。 - BABILong:需要跨长文档推理(上下文窗口最高2MToken)。 时间序列预测:ETT、ECL、Traffic、Weather数据集,预测未来时间点。 DNA建模:GenomicsBenchmarks,任务如增强子识别、启动子分类。 基线模型:Transformer++、RetNet、GLA、Mamba、Mamba2、DeltaNet、Gated DeltaNet等,涵盖纯注意力和线性循环模型。

- 训练与评估配置:

- 优化器:AdamW,学习率4e-4,余弦退火,权重衰减0.1,批次大小0.5MToken。

- 模型规模:170M、340M、400M、760M参数,公平比较相同参数量的基线。

- 评价指标: - 困惑度(PPL,越低越好)。 - 准确率(Accuracy,分类任务)。 - 均方误差(MSE)和平均绝对误差(MAE,时间序列)。

- 实验步骤与结果分析:

- 3.1 步骤1:语言建模与常识推理 流程:在FineWeb-Edu上预训练模型,然后在推理基准上评估零样本性能。 结果:Titans变体均优于基线。例如,760M参数时: Titans-MAG困惑度降至18.61(vs. Transformer++ 25.21)。 平均准确率提升3–5%(如HellaSwag达48.94%)。 分析:神经记忆模块(LMM)单独使用已超越多数基线,显示长期记忆的有效性;结合注意力后(MAC/MAG)进一步优化。

- 3.2 步骤2:长上下文任务验证 S-NIAH任务: 流程:模型需从长文本中检索关键信息(“针”)。序列长度从2K到16K递增。 结果:Titans-MAC在16K长度下准确率达97.95%,而Mamba2仅85.34%。优势归因于遗忘机制和深度记忆。 BABILong基准: 流程:少样本设置直接评估预训练模型;微调设置下训练Titans-MAC。 结果:Titans-MAC在少样本下超越GPT-4等大型模型,微调后准确率超70B参数模型,证明其处理超长上下文的能力。

- 3.3 步骤3:跨领域应用 时间序列预测: 流程:在ETT、ECL等数据集上预测未来值,替换Simba框架中的Mamba模块为神经记忆模块。 结果:神经记忆模块在多数数据集上MSE最低(如ETTm1:0.358 vs. Mamba-based 0.383),因记忆机制能捕捉长期趋势。 DNA建模: 流程:预训练模型在下游基因组任务评估。 结果:神经记忆模块在增强子识别(Enhancer Cohn)准确率达75.2%,与HyenaDNA(80.9%)接近,显示其跨模态泛化。

- 3.4 步骤4:效率与消融研究 记忆深度影响: 流程:变体 ,评估困惑度和吞吐量。 结果:深度增加提升性能,但线性降低吞吐量,例如 时吞吐量降至 的60%。 训练吞吐量比较: 流程:测量不同序列长度×批次大小的Token/秒。 结果:Titans-MAL因使用FlashAttention优化,吞吐量高于纯记忆模块;神经记忆模块稍慢于Mamba2,因深度计算开销。 消融实验: 流程:依次移除动量、遗忘机制、卷积层等组件。 结果:权重衰减(遗忘)贡献最大(移除后困惑度升至29.04),动量次之,持久记忆提升长上下文任务准确率约2%。

结论

实验全面验证了Titans的核心论点:长期记忆模块显著提升长序列建模性能。其在语言建模、推理任务和时间序列预测中均优于基线,同时支持超长上下文(2M+Token)。效率权衡表明深度记忆需优化并行化,但架构设计(如MAC)在效果与速度间取得平衡。实验结果直接支撑论文创新点,但需注意现实场景的泛化能力待进一步验证。

总结与评估

研究的优势与创新亮点

- 理论层面:原创性地将记忆系统分解为短期、长期和持久模块,突破了传统序列模型的单一内存视角,为人脑启发式AI设计提供了新范式。

- 方法层面:创新性地将元学习与在线梯度下降结合,通过惊喜度量和遗忘机制实现了动态记忆管理;Titans架构的三种变体提供了灵活的性能权衡,其中MAC和MAG在长任务中表现突出。

研究的局限与改进方向

- 固有局限:

- 记忆模块的深度增加会线性降低训练吞吐量,可能限制超大规模应用。

- 实验集中于学术数据集,现实场景中的噪声和分布偏移未充分验证。

- 改进方向:

- 优化并行化算法,支持异构硬件加速。

- 引入自适应记忆深度机制,动态调整 以平衡效率。

- 潜在偏差:论文未充分讨论基线模型(如Mamba)的超参数调优细节,可能低估竞品性能。

实验设计的有效性与结论支撑度

- 实验合理性:数据集覆盖语言、推理、时间序列等多领域,基线选择全面;但长上下文任务中缺乏真实用户行为数据,存在场景局限性。

- 结论可信度:消融实验验证了各组件(如动量、遗忘机制)的必要性,结果具备统计显著性;但部分任务(如DNA建模)的准确率提升幅度较小(约1%),结论需谨慎推广。

- 目标达成度:实验结果直接支撑了“长期记忆提升长序列性能”的核心论点,但MAC与MAG的优劣差异未深入分析,存在逻辑简化。

领域贡献与后续研究启发

- 领域贡献:为长序列建模提供了可扩展的解决方案,推动了记忆增强神经网络的理论与实践;代码开源预期将促进产业界应用(如长文档处理、基因组分析)。

- 后续启发:

- 可探索记忆模块的异构架构(如注意力记忆混合)。

- 结合强化学习,实现任务自适应的记忆管理策略。

- 长期影响:Titans可能成为长上下文任务的标杆框架,但其创新性更偏向工程优化,而非基础理论突破,长期影响力取决于跨任务泛化能力的进一步验证。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-10,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录