【硬核解读】Anthropic新文:大模型“脑科手术”指南:与其事后遗忘,不如预先隔离

【硬核解读】Anthropic新文:大模型“脑科手术”指南:与其事后遗忘,不如预先隔离

赛博解生

发布于 2026-04-09 13:20:09

发布于 2026-04-09 13:20:09

引言

大家好,我是赛博解生酱。在训练大模型的过程中,你是否曾因无法彻底清洗海量数据中的“有毒样本”而感到焦虑?今天给大家带来一篇来自Anthropic的前沿安全研究,SGTM(Selective GradienT Masking),希望对大家理解大模型的安全防御机制带来全新的架构视角。

对充满了噪声与0-day漏洞的预训练(Pre-training)数据空间进行分析和质控,常常能体会到系统安全架构师(Security Architect)面对海量未知流量时的如履薄冰。一个操作系统之所以能在黑客的狂轰滥炸中保持稳定运行,靠的不是试图编写一个完美的杀毒软件去查杀每一个病毒特征码,而是设计出一套极强的沙箱隔离机制(Sandbox Isolation)。

在AI安全的浩瀚图纸中,也有这样一种策略,它不奢求完美的数据清洗,不依赖脆弱的事后修补,而是试图在打地基时就构建一个具有“容错性”的隔离区——它就是SGTM(选择性梯度掩码)。作为一名追求系统鲁棒性的研究员,深知在大模型时代,“漏网之鱼”是不可避免的。即使是极少量的有毒数据,也能像蚁穴一样溃堤。因此,一个能够应对“不完美数据”的架构级防御策略,能够满足我们对系统安全性的核心诉求——无需把每一粒沙子都洗干净,也能在最后交付时通过简单的“拆除违建”,精准移除危险能力。而Anthropic提出的SGTM模型,恰好提供了这样一套“定向爆破”的施工蓝图。

基本信息

标题: Beyond Data Filtering: Knowledge Localization for Capability Removal in LLMs

出处: arXiv:2512.05648v1 [cs.LG] (2025年12月5日) | 作者机构:Anthropic, Imperial College London, University of Edinburgh, Constellation

核心内容: 提出了一种名为SGTM的预训练阶段技术,通过梯度掩码将特定领域的知识(如危险知识)定位到模型的特定参数子集中,以便在训练后直接移除,其在面对数据标签噪声时比传统的数据过滤更具鲁棒性。

概要

动机与待解决的问题

随着大语言模型(LLM)能力的增强,其潜在的“双重用途”风险(如生物武器制造、网络攻击)引起了广泛关注。

- 现有方法的局限:目前主流的防御手段是数据过滤(在预训练前清洗有害数据)。然而,这种方法面临巨大挑战:大规模数据标注昂贵且难以精确;随着模型样本效率(Sample Efficiency)的提升,即使少量的漏网之鱼(False Negatives)也足以让模型学会危险能力。

- 后期防御的脆弱性:训练后的“遗忘”(Unlearning)或拒绝回答训练通常容易被对抗性微调(Adversarial Fine-tuning)所破解。

- 核心挑战:如何在标签不可避免存在噪声(Label Noise)的情况下,在预训练阶段有效地阻止模型习得特定能力?

核心观点与贡献

本论文提出,通过架构层面的知识定位(Knowledge Localization)而非单纯的数据剔除,可以构建更安全的模型。SGTM(Selective GradienT Masking)不仅是一种技术改进,更是一种安全范式的转变。作者证明了即使大量有害数据未被标记(被误认为是良性数据),SGTM也能利用吸收特性(Absorption Property)——即未标记的有害数据倾向于更新那些已经被指定用于存储有害知识的参数——从而实现有效的能力移除。这比单纯依赖数据分类器的过滤方法具有更高的容错率。

核心概念与技术贡献

直观解读

- 【直观比喻】:传染病隔离病房与免疫系统

- 普通训练就像是一个开放的社区,所有人都混在一起(所有数据更新所有参数),一旦有感染者(危险数据),病毒就会扩散到每个人。

- 数据过滤就像是在社区门口设卡,试图阻拦感染者。但如果检测不准(标签噪声),感染者混入社区,瘟疫依然会爆发。

- SGTM就像是在社区内建立了一个专门的隔离病房(Forget Parameters)。

- 【比喻映射】

- 隔离机制:当检测到确诊患者(标记的有害数据)时,强制要求他们只能进入隔离病房活动(只更新Forget参数,不影响Retain参数)。

- 日常运行:健康人群(保留数据)在社区活动时,隔离病房是关闭的(Retain数据训练时Mask掉Forget参数),互不干扰。

- 吸收特性(核心亮点):即使有未被发现的感染者混在健康人群中,由于隔离病房已经聚集了大量类似的病源特征,感染者的行为特征会在梯度更新时自然地指向隔离病房(梯度范数分析证实了这一点),而不是感染健康区域。

- 最终销毁:训练结束后,直接把隔离病房整体切除(将Forget参数置零),从而彻底消除隐患。

关键技术细节实现

该方法建立在Transformer架构之上,利用梯度路由(Gradient Routing)的思想。不同于Cloud et al. (2024) 提出的基于激活值的掩码(Activation Masking),SGTM采用参数梯度掩码(Parameter Gradient Masking)。

- 参数切分:将每个Transformer块中的部分注意力头()和MLP神经元()指定为,其余为。

- 差异化更新:在反向传播过程中,根据数据标签手动将特定参数子集的梯度置零(),从而控制信息流向。这在数学上保证了特定样本只能修改特定权重,且相比激活掩码,减少了对模型整体梯度流的破坏(特别是对下游投影层的更新阻塞)。

主要贡献点分析

- 提出SGTM算法:改进了现有的梯度路由方法,通过对参数梯度(而非激活梯度)进行掩码,减少了对保留(Retain)性能的损害,同时更严格地限制了遗忘(Forget)样本向非遗忘参数的信息泄漏。

- 验证了对标签噪声的鲁棒性:在双语合成数据集实验中证明,即使高达20%-40%的遗忘数据未被标记(漏标),SGTM依然能有效移除目标语言能力,且性能优于数据过滤和之前的梯度路由变体。

- 揭示了“吸收”机制与Scaling Law:通过梯度范数分析,从机理上解释了为何未标记数据会自动更新。同时发现,随着模型规模增大,从遗忘数据泄漏到保留参数的信息量(Leakage)呈现下降趋势,这表明该方法在大模型上可能更有效。

- 证明了抗微调的鲁棒性:实验显示,通过SGTM移除能力后的模型,在面对对抗性微调时,重新习得知识的速度比最新的遗忘算法(RMU)慢7倍,且与严格数据过滤的效果相当。

技术细节与实验验证

方法流程/理论证明:Selective GradienT Masking (SGTM)

SGTM 的核心在于预训练阶段的架构级干预。它不依赖于后期微调,而是通过在训练过程中对特定参数子集实施“梯度路由”和“参数掩码”,强制将特定领域的知识(Target Knowledge)“定位”到模型的一小部分参数中。

1. 模型架构与参数切分 (Parameter Split)

SGTM 基于标准的 Transformer 块(包含多头注意力机制 MHA 和多层感知机 MLP)。对于每一个 Transformer 层,作者将参数物理划分为两个互不重叠的集合:遗忘参数集 (Target/Forget Parameters) 和 保留参数集 (Retain Parameters)。

- 切分逻辑:

- 注意力层 (MHA):假设共有 个注意力头,指定其中的 个头及其对应的投影矩阵()属于 。

- 前馈层 (MLP):假设中间隐藏层维度为 ,指定其中的 个神经元对应的权重属于 。

- 输出投影与偏置:相关的输出投影矩阵()也会根据输入维度被切分。

- 形式化定义 (基于 Appendix F): 以 MLP 层为例(设 为第一层权重, 为第二层权重): 其中, 和 归入 ,其余归入 。注:Embedding 层和 LayerNorm 通常归入 ,除非另有说明。

2. 数据集定义

为了模拟现实中标签不完美的场景,训练数据 被划分为三个子集:

- :被明确标记为包含目标知识(有害/需移除)的数据。

- :被明确标记为保留知识(通用/无害)的数据。

- :未标记数据(现实中可能包含漏标的有害数据)。

3. 训练干预协议 (Training Interventions)

SGTM 在预训练过程中,根据当前 batch 数据的来源,执行两种截然不同的干预操作。这是算法的核心逻辑:

- 情况 A:当输入样本来自遗忘集 ()

- 目标:确保这些数据产生的知识只更新 ,绝对不污染 。

- 前向传播:正常计算,使用全量参数 。

- 反向传播 (核心操作):

- 与现有技术对比:Cloud et al. (2024) 使用的是“激活掩码”(即在前向传播时就挡住激活值)。SGTM 选择“参数梯度掩码”是因为激活掩码会阻断反向传播的信息流(导致下游层无法收到正确的梯度信号),而 SGTM 允许梯度流经整个网络,仅在更新那一刻拦截。

- 计算全量参数的梯度 。

- 选择性梯度掩码 (Selective Gradient Masking):在应用优化器之前,强制将保留参数的梯度置零。

- 执行参数更新(此时只有 会发生变化)。

- 情况 B:当输入样本来自保留集 ()

- 目标:训练模型在没有 的情况下也能完美处理通用任务(模拟切除后的状态)。

- 前向传播 (核心操作):

- 反向传播:由于前向计算时 未参与(值为0),其梯度自然为0(或显式置0),仅更新 。

- 选择性参数掩码 (Selective Parameter Masking):在计算前,临时将遗忘参数置为零。

- 使用 进行前向计算。这相当于在特定神经元上应用了确定性的 Dropout。

- 情况 C:当输入样本来自未标记集 ()

- 操作:不进行任何掩码,进行标准的联合训练(更新所有参数)。

- 吸收机制 (Absorption Mechanism):这是 SGTM 的“魔法”所在。由于 已经强烈地引导 学习特定领域的特征,未标记数据中潜在的漏网之鱼(即未被发现的有害数据)会发现利用 能更有效地降低 Loss。因此,即使没有显式引导,这些漏标数据的梯度也会自然地流向 ,而不是 。

4. 训练后消融 (Post-training Ablation)

训练结束后,执行最终的“手术”:

此时,模型中所有定位了目标知识的参数被永久移除。由于 在训练期间(情况 B)已经适应了 的缺失,通用能力得以保留;而由于 从未被 更新(情况 A),目标能力被彻底遗忘。

实验验证与应用流程

为了验证该方法的有效性,论文设计了三个递进的实验场景。

实验一:合成环境下的抗噪性验证 (TinyStories)

- 目标:在完全可控的标签噪声下,验证 SGTM 是否优于数据过滤。

- 数据集:TinyStories 的双语版(英语作为 Retain,西班牙语作为 Forget)。总量 1.2B Tokens。

- 模型:64M 参数的 Transformer。

- 变量设置:

- 未发现的遗忘率 (Undiscovered Forget Rate):模拟标签噪声。例如 10% 意味着 10% 的西班牙语数据被错误地放入了 ,只有 90% 在 。

- 基线方法:

- Data Filtering:简单地丢弃 ,只在 上训练。

- Gradient Routing (Cloud et al.):使用激活掩码的旧方法。

- 结果分析:

- 权衡曲线:SGTM 在所有噪声水平下都构成了 Pareto 前沿。

- 鲁棒性:当漏标率从 0% 增加到 40% 时,Data Filtering 的遗忘效果(Forget Loss)迅速恶化(因为模型从未标记数据中学到了西班牙语);而 SGTM 的遗忘效果保持稳定。

- 机理验证 (梯度范数):作者计算了梯度范数 。结果显示,未标记的西班牙语数据产生的梯度,主要集中在 上,而对 的更新微乎其微。这实证了“吸收机制”的存在。

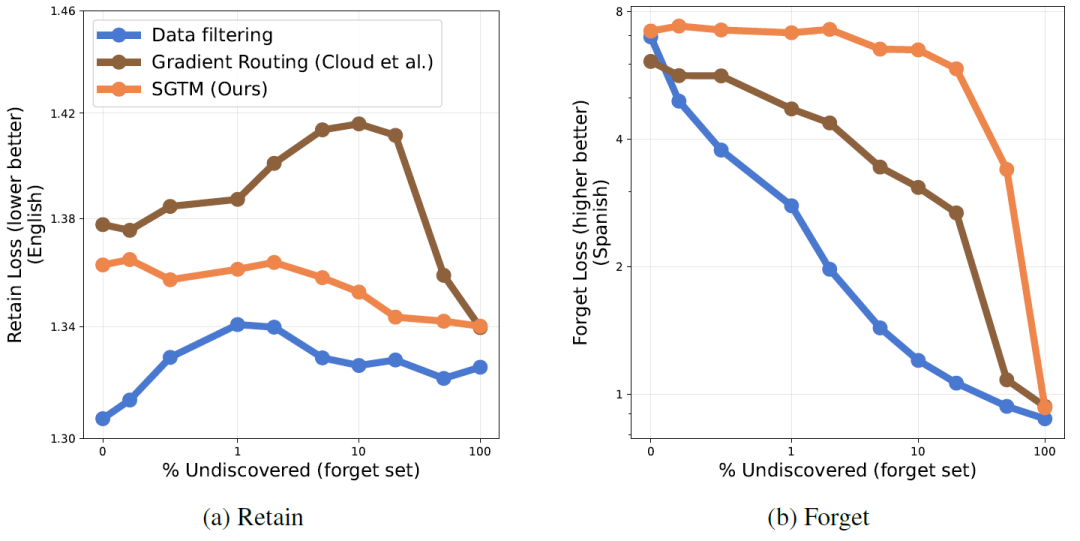

SGTM 稳健地移除了遗忘知识,即使在大部分遗忘数据未被标记(漏标)的情况下依然有效。 图片从双语(英语/西班牙语)TinyStories 数据集训练的模型中移除西班牙语时的 (a) 保留集 和 (b) 遗忘集 的校准损失。

(a) 保留集(Retain):SGTM 始终比 Cloud 等人 (2024) 提出的梯度路由变体实现更低的保留损失(性能更好),同时保持更高的遗忘损失——在所有测试的发现率上都实现了对先前梯度路由方法的帕累托优化。

(b) 遗忘集(Forget):对于所有考虑的非零标签错误率,SGTM 表现出比梯度路由和数据过滤更强的遗忘能力(Loss 更高)。

实验二:现实大规模数据验证 (Wikipedia)

- 目标:在真实世界的标签噪声下(分类器不完美),移除复杂的概念性知识。

- 数据集:英文 Wikipedia (3.7B Tokens)。

- Target: Biology (生物学)。

- Neighbor: Medicine/Chemistry (医学/化学 - 容易被误伤的知识)。

- General: History/Culture (历史/文化)。

- 模型:254M 参数模型。

- 参数配置:指定 1 个注意力头(共32个)和 64 个 MLP 神经元(共4096个)为 。

- 基线设置:

- Weak Filter:仅移除被分类器标记为 Biology 的文档。

- Strict Filter:移除 Biology + Medicine + Chemistry + Environment(以此来保证生物学被删干净,但牺牲了邻近知识)。

- 结果与度量 (Compute Penalty):

- 为了更直观地衡量性能损失,作者将 Loss 转换为“计算惩罚”。即:为了达到该 Loss,基线模型需要额外多少计算量?

- 生物学移除 (Forget):SGTM 的效果介于 Weak 和 Strict Filter 之间,但更接近 Strict(移除彻底)。

- 邻近知识保留 (Retain-Neighbor):SGTM 的计算惩罚为 38%,远好于 Strict Filter 的 67%(保留了更多医学知识)。

- 通用知识保留 (Retain-General):SGTM 引入了约 5-6% 的计算惩罚(Loss 略高)。这表明 SGTM 的训练效率略低于标准训练,这是为了安全性支付的代价。

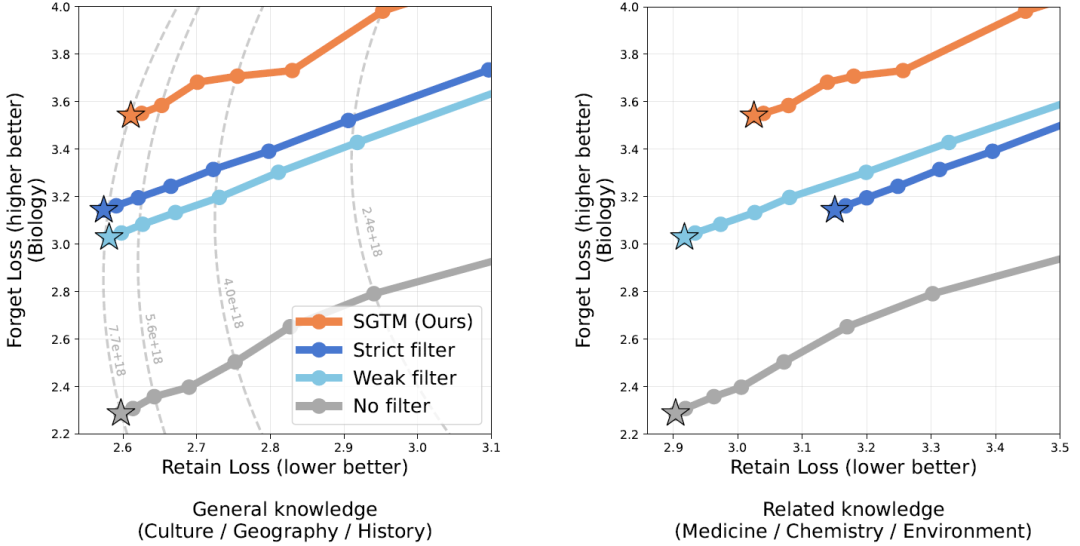

与数据过滤相比,在从 Wikipedia 训练的模型中移除生物学知识时,SGTM 显示出更好的“保留/遗忘”权衡(Trade-off)。 将选择性梯度掩码 (SGTM) 与两个数据过滤基线进行了比较:

弱过滤 (Weak):仅移除分类为“生物学”的文章。 强过滤 (Strict):还移除了“医学与健康”、“化学”以及“地球与环境”文章。

Y轴:显示遗忘损失(生物学),数值越高表示对生物学知识的移除越强(越安全)。

X轴:显示保留损失(非生物学主题),数值越低表示通用能力保留越好。 每条线代表一次训练运行的进度,每个点是以相等间隔记录的检查点。星号表示最终检查点。虚线显示了相等的计算支出(FLOPs,右图未显示)。 结论:在通用知识(左图)和生物学邻近知识(右图)上,SGTM 在任何给定的保留损失值下都产生了更高的遗忘损失。不过,SGTM 会产生一定的计算效率惩罚,需要更多的计算量才能达到相同的保留损失值。

实验三:对抗性微调的鲁棒性 (Adversarial Fine-tuning)

- 目标:验证知识是真的被“移除了”,还是仅仅被“压抑了”?如果是压抑,微调应该能很快恢复。

- 流程:

- 取消融后的 SGTM 模型。

- 使用包含生物学知识的数据集进行全参数微调(Adversarial Attack)。

- 记录 Forget Loss 随微调步数的变化。

- 对比对象:

- RMU (Representation Misdirection for Unlearning):当前最先进的训练后遗忘方法。

- Strict Data Filtering。

- 结论:

- RMU 非常脆弱,仅需 50步 (13M Tokens) 微调,生物学知识就完全恢复到基线水平。

- SGTM 极其顽固,需要 350步 (92M Tokens) 才能恢复,恢复难度是 RMU 的 7倍。

- SGTM 的恢复曲线与 Strict Data Filtering 几乎重合。这证明 SGTM 实现了物理级别的知识清除,其效果等同于模型从未见过这些数据。

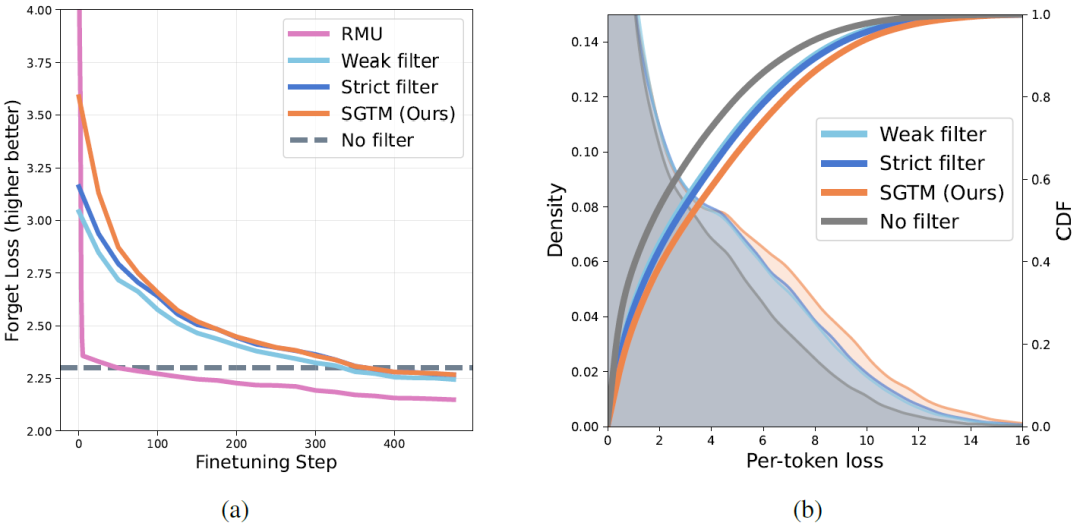

(a) SGTM 从 Wikipedia 模型中移除知识的过程对“对抗性微调”具有极强的鲁棒性。通过在移除生物学知识后的模型上进行对抗性微调来测量“重学习率”: RMU(一种最先进的传统训练后机器遗忘方法):表现非常脆弱,仅在 50步 内就迅速达到了基线遗忘损失(知识完全恢复)。

SGTM:需要 350步 才能恢复,与强数据过滤 (Strict Filter, 350步) 一样鲁棒,且略微优于弱过滤 (325步)。它还在前 150 个微调步骤中保持了对强数据过滤的优势。每个微调步骤代表 260k 个遗忘 Token。

(b) SGTM 通过广泛的而非孤立的 Token 失败来移除生物学知识。 我们在消融后的 SGTM 和数据过滤基线的生物学测试集上绘制了校准后的“每 Token 损失分布”。与过滤方法相比,SGTM 将分布整体向更高的损失值移动,表明其较高的遗忘损失反映了生物学知识在所有 Token 上的广泛退化,而不是仅有少数几个 Token 出现了极高损失。

4.4 扩展分析:Leakage 与 Scaling Law

- Leakage 定义:作者定义了一个指标“Leakage”,用于量化从未标记数据中泄漏到 的信息量。计算方法是将 SGTM 模型的 Forget Loss 等效为“标准模型训练了多少个遗忘 Token”。

- Scaling Law 发现:作者在 8M 到 64M 的模型上进行了缩放实验。结果发现,随着模型规模的增加,Leakage 率呈现单调下降趋势。

- 这意味着模型越大,SGTM 的“隔离”和“吸收”效果越好。这对于未来在数十亿参数模型上应用该技术是一个非常积极的信号。

总结与评估

研究的优势与创新亮点

- 理论与机制的深度:论文不仅仅提出了一个Trick,还通过 梯度范数(Gradient Norms) 分析深入挖掘了其背后的机理,证实了“未标记的同类数据倾向于更新同一组参数”的假设。这为处理标签噪声提供了一个优雅的内生解决方案。

- 方法实现的优越性:相比于Cloud et al. (2024) 的激活掩码,SGTM的参数梯度掩码更加“干净”。激活掩码会阻断反向传播流向底层参数,导致训练不稳定或信息流受阻;SGTM则允许梯度流经整个网络,仅在更新步骤进行拦截,这在保留通用能力方面表现更佳。

- 从源头解决问题:与事后亡羊补牢的“机器遗忘(Machine Unlearning)”不同,SGTM是预训练阶段的防御(Pre-training Mitigation),类似于“设计安全(Safety by Design)”,这在防御深度上远超后期修补。

研究的局限与改进方向

- 模型规模的局限:实验最大模型仅为254M参数,这与当今数十B甚至上T参数的前沿模型相去甚远。虽然Scaling Law分析暗示了正面趋势,但在Mixture-of-Experts (MoE) 等复杂大模型架构上的有效性仍未可知。

- 任务代理的局限:移除“西班牙语”或“生物学百科知识”只是移除危险能力的代理任务(Proxy Task)。真实的生物武器制造能力可能与通用生物学知识高度纠缠,如何精准定义和分割 在现实中极为困难。

- 计算效率惩罚:SGTM会导致通用能力的训练效率下降(约5-6%的计算惩罚)。在训练成本极高的前沿模型训练中,这可能是一个阻碍商业应用的因素。

- 改进方向:

- 在更大规模(7B+)模型上验证Scaling Law是否失效。

- 探索动态分配 的机制,而不是预先固定比例。

- 结合MoE架构,研究是否可以将特定的Expert作为隔离区,而非在每个Block内切分MLP。

实验设计的有效性与结论支撑度

- 实验设计严谨:使用了合成数据(完全控制标签噪声)和现实数据(真实噪声)双重验证,逻辑闭环完整。

- 指标诚实:作者没有回避SGTM在Retain Loss上的劣势,并通过“Compute Penalty”这一直观指标量化了这种代价,增加了结论的可信度。

- 结论支撑度高:对抗性微调的对比实验非常有说服力,直接击中了当前Unlearning方法“只治标不治本”的痛点,有力支撑了SGTM进行物理知识定位的有效性。

领域贡献与后续研究启发

- 领域贡献:该工作是AI安全领域从“数据中心(Data-centric)”向“架构中心(Architecture-centric)”防御转移的重要一步。它证明了模型架构可以被设计成对数据噪声具有免疫力。

- 后续启发:

- 双模式发布:论文提出了一种可能性,即训练一个模型,发布两个版本:完整版(保留,给受信任用户)和安全版(切除,给公众)。这种“一次训练,多种部署”的模式具有极高的商业和安全价值。

- 安全缩放定律(Safety Scaling Laws):关于Leakage随模型规模增大而减小的发现,可能开启关于大模型是否天生比小模型更容易进行知识隔离的研究新方向。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-30,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录