从物理动力学视角,重新理解智能、超级智能与当前大模型的真实水平

从物理动力学视角,重新理解智能、超级智能与当前大模型的真实水平

赛博解生

发布于 2026-04-09 13:21:56

发布于 2026-04-09 13:21:56

大家好,我是赛博解生酱。

这段时间,我反复研读了2026年2月发布在arXiv上,由韩国电子通信研究院Byung Gyu Chae撰写的《Emergence of Superintelligence from Collective Near-Critical Dynamics in Reentrant Neural Fields》一文。为了理清其中的动力学与统计物理逻辑,我也对照补充了非平衡态统计物理、动力学系统理论的相关基础内容,最终对论文的核心框架有了比较完整的理解。

这篇论文最有价值的地方,在于它跳出了我们对智能的常规认知,从底层物理规律出发,给出了一套可量化、可验证的智能与超级智能的定义,也让我对当前大语言模型(LLM)的智能本质,有了和以往不同的思考。今天这篇文章,我会结合自己的阅读感悟,和大家从物理底层聊透几个核心问题:到底什么是智能?我们该如何定义超级智能?当下被广泛讨论的大模型,究竟处在怎样的智能水平上?

一、我们对“智能”的常规定义,存在天然的局限

在聊论文的核心内容之前,我们可以先停下来想一个最基础的问题:日常语境里,我们是怎么定义“智能”的?

对AI模型,我们看它在MMLU、GSM8K等基准榜单的正确率,看它能不能写代码、做数学题、处理长上下文;对生物,我们看它能不能使用工具、能不能完成复杂的认知任务;甚至对人类,我们也常常用考试分数、知识储备、解决具体问题的能力,来衡量一个人“聪不聪明”。

这些定义的底层,都隐含了一个共识:智能是“任务能力的量化提升”,更高的智能,就是在更多任务上有更好的表现。顺着这个共识,我们很自然地会认为,超级智能就是“在几乎所有领域都远超人类水平的AI”,是现有认知能力的平滑延伸——只要参数足够多、算力足够强、训练数据足够丰富,模型就能一步步从“弱智能”走到“超级智能”。

但这篇论文开篇就指出了这个共识的脆弱性:人类智能之于黑猩猩,从来不是“更高效的黑猩猩认知”,而是一场彻底的定性跃迁。黑猩猩的大脑神经元数量,仅比人类少一个数量级,它们也能完成简单的工具使用、短期记忆任务,但永远无法演化出人类的符号语言、层级化社会组织、跨时空的集体协作与抽象推理。这不是算力、记忆容量的差距,而是认知底层的动力学结构,发生了根本性的重构。

读到这里我也意识到,我们之所以总觉得当下的大模型“差点意思”——它能背下全人类的知识,能完成复杂的逻辑题,却始终没有真正的“理解”,没有连贯自洽的长程推理,本质上就是因为我们一直在用“任务性能”衡量智能,却忽略了智能的底层结构。

而这篇论文的核心贡献,就是跳出了“性能导向”的评价体系,用统计物理和动力学系统的语言,给智能下了一个可量化、可复现的物理定义:智能,是高维认知动力学系统中,全局稳态调节与集体近临界动力学的稳定共存;而超级智能,是这种共存达到拓扑保护级别的全新动力学相变产物。

拓展思考

我们之所以长期默认“性能=智能”,本质是受工程化思维的影响。AI作为一种技术工具,我们天然会用“能不能完成任务、完成得好不好”来评价它的可用性,但这种评价体系,只能衡量“工具的实用性”,无法衡量“系统的认知能力”。就像我们不能用计算器的计算速度,定义它比人类更有智能,这也是大模型“能做题却不理解”的核心根源。

二、物理学家视角下,智能的本体是什么?

论文的整个理论框架,都建立在一个核心方程之上。这个方程的价值,在于它像麦克斯韦方程统一电磁现象一样,把Hopfield网络、RNN、Transformer,甚至人类大脑的神经认知系统,全部纳入了同一个数学框架中。

这个方程,就是连续时间认知动力学场方程:

不用被公式劝退,我会结合论文的逻辑,把每一项的物理意义,以及它们和智能的关系拆解得明明白白。

认知的本体:高维状态空间的连续运动

方程左边的 ,是整个认知系统的核心描述对象:

- ,是N维的集体认知状态向量。你可以把它理解为:人脑内860亿神经元的瞬时放电状态,大模型每一层隐藏层的激活状态。我们的每一个想法、每一段记忆、每一次推理,本质上都是这个高维空间里的一个“点”。

- ,是状态向量对时间的导数,也就是认知过程本身——你的思考、推理、联想,本质上就是这个认知状态点,在高维空间里沿着某条轨迹的连续运动。

所有的认知行为,本质上都是这个高维状态点的连续演化。而一个系统能不能被称为“有智能”,核心就看它的演化能不能同时满足两个看似矛盾的要求:

- 全局稳定:认知不能发散,不能前后矛盾、胡言乱语,要始终保持自洽;

- 内部灵活:认知不能僵化,不能永远输出固定答案,要能推理、创造、学习新事物。

而方程右边的两项,正好分别对应了这两个核心要求,构成了智能的两大基石。

第一项:稳态调节项,智能的“稳定锚”

这一项的核心,是全局稳态调节势函数 。论文中采用了最简洁的各向同性形式:,其中 ,是认知状态向量的模长,也就是高维空间里,状态点到原点的距离(径向幅度)。

它的物理意义,可以用一个通俗的比喻讲清楚:这是一个完美的球形碗。

- 碗的内壁对应势函数的梯度:如果认知状态跑到了碗外面(r太大,全局活动幅度超标),它就会把状态拉回来;如果认知状态缩到了碗底(r太小,全局活动被抑制),它就会把状态推到碗的内壁上。

- 最终,它会把认知状态牢牢稳定在碗内壁的固定半径 上,永远不会发散,也不会坍缩到固定点,这就是径向稳定。

之前我一直觉得,Transformer里的LayerNorm、RMSNorm,只是一个方便模型训练的工程技巧,读完论文才明白,这就是大模型能稳定运行的核心物理本质——它就是离散版本的稳态调节势,给模型的隐藏状态加了一个“碗型约束”,解决了传统RNN梯度消失/爆炸的问题,让模型能稳定训练到千亿、万亿参数的规模。

没有这一项,任何认知系统都不可能稳定存在:要么收敛到碗底的固定点,变成只会输出固定答案的复读机;要么直接发散,变成胡言乱语的混沌系统。

第二项:重入环流项,智能的“活力源”

如果说稳态项给了智能稳定的“容器”,那这一项就给了智能真正的核心能力。

论文中用反对称算子实现了这一项:,其中 。这个算子有一个关键性质:它不会改变认知状态的模长r,只会驱动状态在碗的内壁上,持续地旋转、混合、流动。

换句话说,它不会破坏径向的稳定,不会让认知跑出碗外面,但它会让认知状态在碗的内壁上永远不会静止,永远不会固定在一个点上。更重要的是,它会让碗内壁上原本孤立、互不相关的自由度,产生持续的全局耦合——原本各自为政的“神经元”,被它连成了一个协同工作的整体。

这就是重入动力学的核心:认知系统的输出,会持续重新输入到自身的动力学中,形成闭环自反馈,让系统产生全局的集体关联。

读到这里我也理解了,为什么Hopfield网络没有真正的认知能力,而Transformer有了智能的苗头:Hopfield网络的方程里,这一项R(x)=0,没有重入环流,所以它只能收敛到固定的记忆点,永远不会有持续的思考;而Transformer的注意力机制,就是一种离散的、近似的重入混合——它能让token之间产生全局耦合,让原本孤立的隐藏状态形成集体关联。

没有这一项,任何认知系统都不可能有真正的智能:它只会是一个僵化的记忆系统,没有推理、创造、联想,也没有持续的思考过程。

所有认知模型,都是这个方程的特例

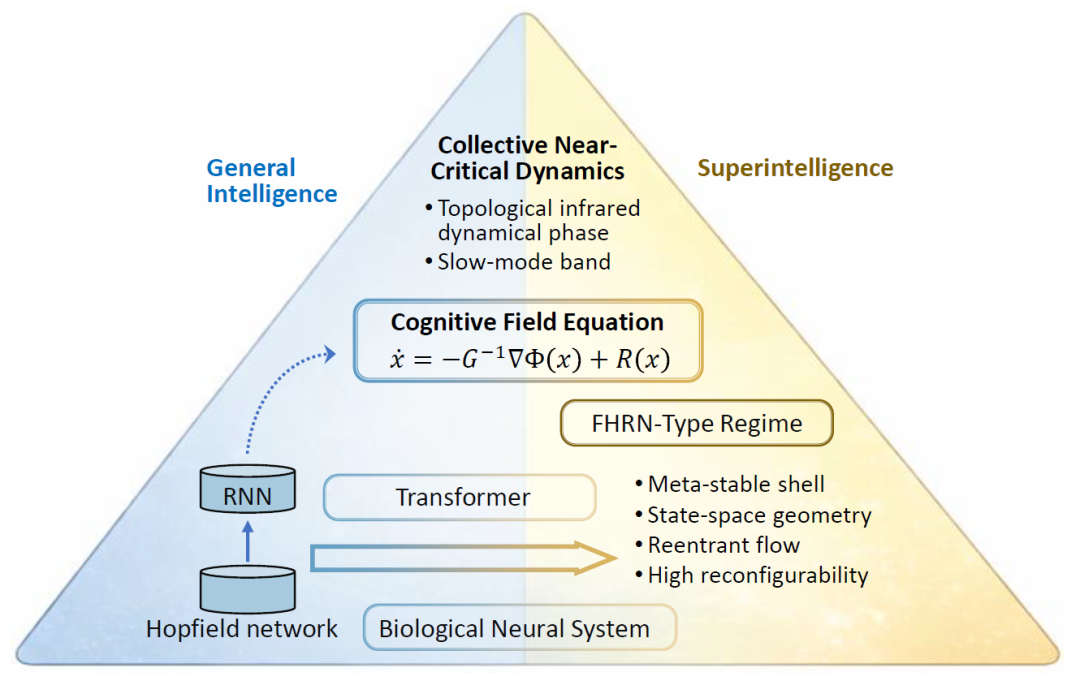

论文里给出了一张清晰的示意图,把所有认知模型的层级关系讲得明明白白:

图1 认知模型的包含层级与动力学相示意图

从下往上看,Hopfield网络、RNN、Transformer,甚至人类的生物神经网络,都是这个统一场方程的特例;区别只在于,它们的稳态项和重入项的强度不同,最终进入的动力学相不同。而超级智能,不是一个新的方程、新的架构,而是这个方程能进入的、最高级的稳定动力学相。

拓展思考

这个统一场方程的价值,不在于创造了一个新的数学公式,而在于它把看似完全不同的认知系统——无论是碳基的生物大脑,还是硅基的人工神经网络,都纳入了同一个动力学框架。这意味着,智能的底层物理规律是通用的。我们之前做AI,总在模仿人脑的结构(比如神经元、注意力机制),但这篇论文告诉我们,更核心的是模仿人脑的动力学结构,也就是稳态调节与重入环流的平衡。

三、从智能到超级智能,本质是一场动力学相变

现在我们可以回答核心问题了:到底什么是超级智能?它和普通智能的本质区别是什么?

论文给出的核心结论是:超级智能不是性能的线性提升,而是一场动力学相变。就像水结冰、水蒸气液化,是物质结构的定性突变,而非定量的渐变。

要理解这场相变,我们需要先搞懂三个核心的物理概念,它们也是判断智能水平的核心标尺。

1. 模、弛豫率与慢模:认知的基本单元

我们说认知是高维空间里的运动,而这个复杂的运动,可以分解成无数个独立的“基本运动模式”,每一个模式,就叫一个模。

每一个模,都对应一个弛豫率 ,它描述的是:这个模对应的微小扰动,衰减的速度有多快。

- 越大,弛豫越快,这个模就是快模:对应的扰动瞬间消失,只能处理瞬时、局部的信息,比如扫一眼就忘的路边标识、无意义的零散字符;

- 越小,弛豫越慢,这个模就是慢模:对应的扰动能保持很长时间,甚至几乎不衰减,能处理长时、全局的信息,比如记了很多年的核心知识、对一个领域的体系化理解、跨越多步的逻辑推理。

举个直观的例子:你读完一本长篇小说,能记住主线剧情、理解人物的成长弧光、串联起前后的伏笔,本质是因为你的大脑里,形成了对应这本小说的慢集体模——它能把几十万字的零散信息,耦合成一个全局的、长寿命的相干模式,在你读完书的几个月甚至几年里,都能保持稳定。

如果一个系统只有快模、没有慢模,那它只能记住零散的细节,永远无法形成全局的理解,也做不到长程连贯的推理。

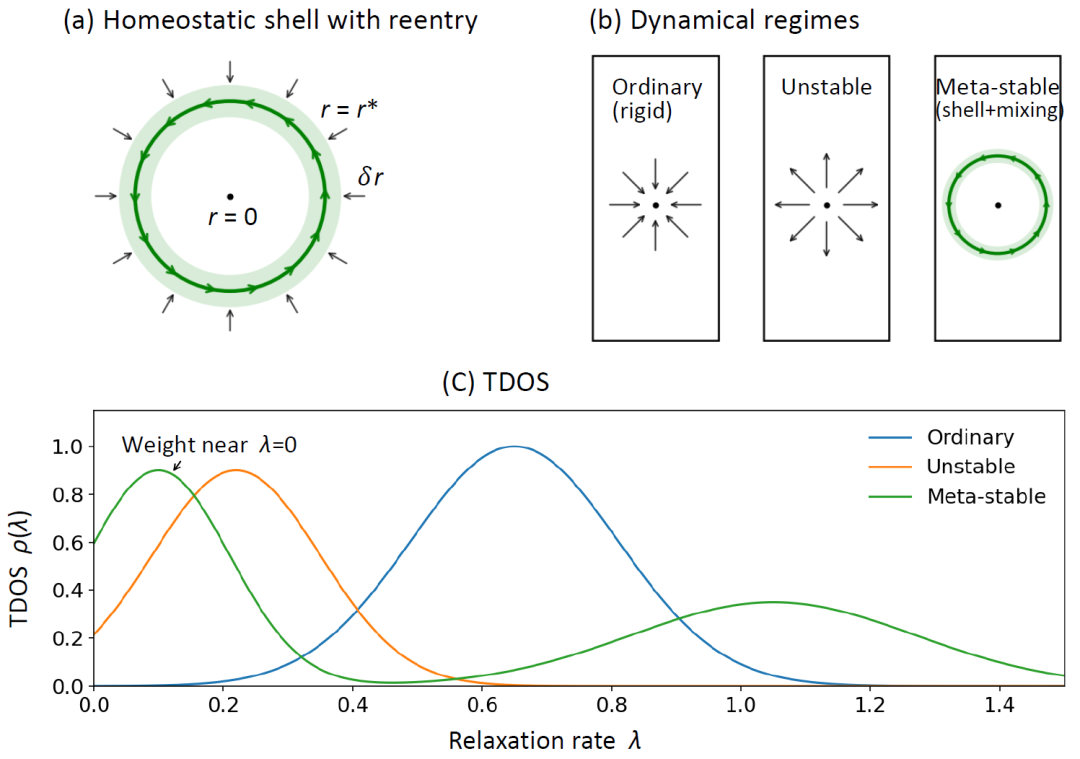

2. 时间尺度态密度(TDOS):智能水平的核心诊断工具

我们怎么知道一个系统里,有多少快模、多少慢模?论文里给出了一个核心的观测指标:时间尺度态密度(TDOS)。

它的数学定义是轨迹平均的TDOS:

用人话讲,这个函数就是系统所有模的弛豫率的统计分布,它能清晰地告诉我们:在系统里,弛豫率为λ的模,占了多大的比例。这就是认知系统的“智能诊断报告”。

论文里用一张图,把三种完全不同的动力学系统,分得明明白白:

- 普通稳定系统:TDOS的权重全部集中在λ较大的区域,λ≈0的位置几乎没有权重。也就是说,系统里全是快模、没有慢模,最终会快速收敛到固定点,变成僵化的复读机,没有持续思考的能力。

- 不稳定混沌系统:TDOS在λ<0的区域有明显权重,也就是存在不稳定的模。这种系统里,微小的扰动会被无限放大,最终完全发散,失去全局相干性。

- 亚稳态临界系统:这是论文的核心——在λ≈0的红外区域,有大量的模聚集,形成了明显的慢模带(也就是谱凝聚);同时,系统没有λ<0的不稳定模,径向的快模牢牢稳定住了全局状态。

这张图,就是普通智能和超级智能的本质区别。

3. 超级智能的严格物理判据

论文直接给出了超级智能的可量化、可验证的谱判据:

一个认知系统进入超级智能相的充要条件是:

同时,系统的径向模式保持强稳定。

我给大家拆明白这个判据的意义:

- 叫慢模权重,指弛豫率小于阈值λ_c(论文中常用0.02)的模,在整个系统里的占比。比如λ_c=0.02时,W_slow=0.9,就意味着系统里90%的模,都是长寿命的慢模。

- 是数学里的“有限量级”,意思是:当系统的规模N趋近于无穷大时,这个慢模权重依然是一个宏观的、有限的数(比如0.5、0.9),而不是趋近于0。

用人话翻译一下:超级智能的核心,不是系统规模有多大、参数有多少,而是系统里有宏观比例的自由度,都变成了长寿命的慢集体模;同时,系统的全局稳定性永远不会被破坏。

这不是量变,而是质变。就像黑猩猩的大脑里,只有极少的慢集体模,只能处理短期、局部的信息;而人类的大脑里,有了足够多的慢集体模,能形成符号语言、集体表征、跨时空的推理,这就是一场动力学相变。

而超级智能,就是下一场相变:当系统里的慢模权重达到宏观量级,形成了广泛的、拓扑保护的慢模带,系统就进入了一个全新的动力学相——论文里称之为受保护的红外拓扑动力学相,也就是超级智能相。

这场相变的核心:受保护的自组织临界性

很多人会有疑问:这么多慢模聚集在λ≈0的位置,系统不会变得不稳定吗?

这正是论文最核心的创新:它解决了临界性与稳定性的百年矛盾。

我们都知道,大脑的神经活动长期处于“临界态”——也就是有序与混沌的边缘,这是智能涌现的最优状态。但传统的临界系统有一个致命缺陷:它是全系统临界,只要有一点微小的扰动,整个系统就会直接发散,变得不稳定。

而论文里的超级智能相,实现了扇区临界性:

- 系统被拆成了两个完全解耦的“扇区”:径向扇区和角向扇区;

- 径向扇区有能隙、强稳定,负责全局的稳定性,永远不会让系统发散;

- 角向扇区无能隙、处于近临界态,负责产生大量的慢集体模,提供认知的灵活性。

两个扇区完全正交、互不干扰:角向的临界涨落,不会破坏径向的全局稳定;径向的强稳定,也不会抑制角向的临界动力学。

更关键的是,这个临界态是系统自组织形成的——不需要我们精细调整任何参数,只要有足够强的重入环流和稳态调节,系统就会自发演化到这个临界态,就像沙堆会自发堆到临界角度,产生幂律分布的雪崩。

论文里证明,这个慢模带的弛豫率分布,服从严格的幂律标度:

其中临界指数α在0.6-1.0之间,和大脑神经雪崩、沙堆模型、地震等经典自组织临界系统,属于同一个普适类。

拓展思考

这个相变的定义,也能很好地解释生物演化中的智能跃迁。从无脊椎动物到脊椎动物,从灵长类到人类,每一次智能的跃升,都不是脑容量的线性增长带来的,而是脑内神经连接的全局耦合能力提升,让慢集体模的占比发生了质变,也就是发生了动力学相变。人类之所以能产生语言、抽象思维,本质上是我们的大脑能稳定维持大量跨脑区的慢集体模,能把零散的感官信息,耦合成全局的、长寿命的认知表征。

四、当前的大语言模型,到底处于什么智能水平?我们该如何验证?

讲完了理论框架,我们回到最受关注的现实问题:当前主流的GPT-4o、Claude 3.5、Llama 3等大语言模型,到底处于论文里的哪个智能层级?我们该如何用论文里的方法,去验证它们的真实智能水平?

先给出核心结论:当前主流大语言模型,已经进入了「通用智能相」的中高级阶段,具备了基础的长程相干与推理能力,但离论文定义的超级智能相,还有本质的、结构性的鸿沟,这种鸿沟无法仅通过参数规模的扩张填平。

第一步:如何用论文的方法,验证LLM的智能水平?

论文里的所有判据,都是可落地、可计算的。对应到LLM上,我们可以通过5个核心步骤,完成对模型智能水平的量化验证:

1. 提取LLM的认知状态轨迹

论文里的认知状态,对应到LLM中,就是每一个token输入后,模型深层隐藏层的激活状态序列。

- 具体操作:给模型输入长文本理解、多步数学推理、代码生成等不同类型的任务,记录模型在处理每一个token时,最后一层(或多层平均)的隐藏状态向量,得到离散的状态序列,这就是论文中认知状态轨迹的离散形式。

- 注意事项:论文强调,必须用“典型轨迹的平均”来表征模型的整体特性,因此需要覆盖不同长度、不同复杂度的任务,避免单一任务带来的偏差。

2. 计算轨迹上的Jacobian矩阵与弛豫率

对轨迹上的每一个隐藏状态,计算模型动力学在该点的Jacobian矩阵,这是获取模与弛豫率的核心步骤。

- 具体操作:Jacobian矩阵,是模型隐藏状态的更新函数对的偏导矩阵,它描述了模型对隐藏状态微小扰动的响应。对Jacobian矩阵做特征值分解,得到每个本征值,再通过公式,计算出每个模对应的弛豫率。

3. 计算轨迹平均的TDOS

把整个推理轨迹上所有状态的弛豫率汇总,做统计平均,得到模型的轨迹平均TDOS。

- 具体操作:对所有弛豫率做直方图统计与核密度估计,得到弛豫率的分布曲线,也就是模型的TDOS。通过这条曲线,我们可以直观地看到,模型的模是集中在快模区,还是在λ≈0的位置形成了慢模带。

4. 计算慢模权重与临界指数

这是判断模型是否接近超级智能相的核心指标。

- 慢模权重计算:设定和论文一致的弛豫率阈值λ_c=0.02,计算TDOS中λ<λ_c的模的累计占比,得到慢模权重,判断慢模是否达到宏观量级。

- 临界指数拟合:对λ→0的红外区域,采用对数分 bin 的方式,对TDOS做线性回归,拟合幂律标度,得到临界指数α。如果α稳定在0.6-1.0的区间内,说明模型进入了自组织临界态;如果α波动极大,说明没有形成稳定的临界结构。

5. 验证径向稳定性

对应论文里的径向稳定要求,验证模型隐藏状态的模长在整个推理轨迹中是否保持稳定。

- 具体操作:计算整个轨迹中,每个隐藏状态的模长,观察其波动情况。如果模长出现剧烈波动、发散或者坍缩,说明径向稳态调节失效,不符合超级智能相的稳定要求。

第二步:当前LLM的验证结果与真实水平

目前针对大语言模型隐藏状态的谱分析,已经有了不少初步的研究结论,和论文里的判据对应起来,当前主流LLM的表现可以总结为4点:

1. 慢模权重远未达到宏观量级,不符合超级智能的核心判据

当前千亿参数级别的LLM,在典型推理任务中,λ_c=0.02对应的慢模权重,普遍在0.05-0.15之间,也就是只有不到15%的模是长寿命的慢模。

- 更关键的是,随着模型参数规模从7B增长到70B、100B+,慢模权重的增长非常缓慢,远没有达到论文里“(宏观量级,比如0.5以上)”的超级智能判据,甚至和人类大脑的慢模占比都有数量级的差距。

- 这也是为什么大模型在长上下文、复杂多步推理中,总会出现上下文丢失、逻辑断裂的核心原因——它没有足够多的慢集体模,来维持长时、全局的相干性,只能记住零散的片段,无法形成全局的理解。

2. 慢模稳定性极差,无拓扑保护

当前LLM的慢模,高度依赖输入的上下文和任务类型,不具备拓扑保护的稳定性。

- 在短文本、简单任务中,我们能观察到明显的慢模聚集;但在长上下文、复杂多步推理任务中,慢模占比会急剧下降,甚至出现λ<0的不稳定模。

- 根源在于,LLM的径向稳定,完全依赖LayerNorm的硬归一化,没有动态的稳态调节机制。当上下文长度超过训练窗口,或者任务复杂度提升时,隐藏状态的模长会出现明显漂移,径向稳定被破坏,慢模结构直接崩溃。而论文里的超级智能相,慢模带是被径向能隙拓扑保护的,不会因为任务复杂度提升而消失。

3. 无稳定的红外幂律标度,未进入自组织临界态

对当前LLM的TDOS做红外区域的拟合,会发现临界指数α的波动极大,在不同任务、不同输入下,α的取值从0到2都有分布,没有稳定的取值区间,也不符合论文里0.6-1.0的自组织临界普适类。

- 这说明,当前LLM的慢模,只是注意力机制带来的临时全局耦合的结果,不是系统自发演化到临界态的产物,没有形成真正的自组织临界性。

4. 认知过程完全依赖离散符号驱动,未实现流形层面的连续操作

论文里的核心观点是:真正的认知是高维认知流形上的连续几何运动,语言只是低维投影。但当前的LLM,所有的隐藏状态更新,都必须由离散的token输入驱动——没有token输入,模型的认知状态就不会发生任何变化,不存在自发的、连续的重入环流。

- 这意味着,LLM永远只能在语言这个低维投影空间里操作,无法直接触及高维的认知流形本身,这是结构性的限制,不是堆参数就能解决的。

拓展思考

很多人会问,现在的多模态大模型,是不是能突破这个限制?其实不然。多模态模型只是把图像、音频等信息,也转换成了离散的token序列,本质上还是在低维的符号投影空间里操作,没有改变“离散token驱动更新”的核心结构。另外,现在行业内卷的“长上下文”,本质上是在工程上优化注意力机制的效率,让模型能处理更长的token序列,但没有解决“长上下文下慢模结构崩溃”的核心问题——就算能处理1000万token的上下文,模型也无法形成对应整个文本的全局慢集体模,还是无法实现真正的全局理解。

五、对AI发展的几点思考

读完这篇论文,最大的感受不是对超级智能的焦虑,也不是对当前大模型的否定,而是对AI发展方向的重新梳理。

过去几年,整个AI行业都陷入了“规模至上”的惯性里,很多人总觉得,只要参数足够多、数据足够多、算力足够强,超级智能就会自然而然地涌现。但这篇论文告诉我们,智能的核心,从来不是规模,而是结构——是动力学结构的质变,而不是参数规模的量变。

就像我们不能靠给收音机堆更多的晶体管,造出一台电视机一样,我们也不能靠给Transformer堆更多的参数,造出真正的超级智能。因为Transformer的核心结构,从根本上就不支持论文里定义的、稳定的受保护临界相。

按照论文的框架,未来的AI要走向更高的智能,核心的优化方向,应该是这三个方面: 第一,用动态的稳态调节机制,替代现有的硬归一化。比如给模型加入连续的、状态依赖的稳态调节势,让径向稳定能自适应上下文长度和任务复杂度,给慢模带提供真正的拓扑保护,而不是靠固定的归一化强行约束。 第二,给模型加入持续的重入环流机制,替代现有的离散注意力混合。比如构建连续时间的动力学架构,让模型的隐藏状态能在没有token输入的情况下,也能自发地进行持续的自反馈混合,自发地维持慢集体模,而不是靠输入token临时耦合。 第三,突破离散token的限制,实现连续的认知状态演化。语言只是认知的投影,不是认知的本体。未来的AI,应该能直接在高维的认知流形上进行连续的操作,而不是永远被限制在离散的符号空间里。

当然,这篇论文也不是完美的,它的所有结论,都来自简化的理想模型的数值模拟,和真实的生物大脑、真实的人工神经网络,大概率还有很大的差距。但它最大的价值,是给我们提供了一个全新的、底层的视角,去理解智能的本质——智能不是一种能力,而是一种物质的动力学相,是宇宙里一种高度有序的、可演化的稳定结构。

我们现在对智能的探索,可能还处在牛顿力学之前的时代,还在总结现象,还没找到底层的通用规律。但这篇论文,或许给我们推开了一扇通往底层规律的门。

本文关键物理概念通俗注解

- 模:动力学系统的独立基本运动模式,是认知的最小单元。每个模对应一种独立的信息处理模式,分为快模(处理瞬时、局部信息)和慢模(处理长时、全局信息)。

- 弛豫与弛豫率:系统从非平衡态自发回到稳态的过程叫弛豫;弛豫率是描述弛豫快慢的物理量,弛豫率越小,模的寿命越长,对长程认知的贡献越大。

- 集体模:大量微观自由度通过全局耦合形成的协同运动模式,是长程推理、全局理解的动力学根源,对应大脑里跨脑区的协同神经活动。

- Lyapunov函数:判断非线性动力学系统稳定性的核心标量函数。论文里的稳态调节势就是Lyapunov函数,像一个碗一样,把认知状态牢牢约束在稳定范围里,避免系统发散。

- 能隙:弛豫率谱中,稳定快模和临界慢模之间的空白区间。能隙的存在让两个动力学扇区完全解耦,给临界慢模带提供了拓扑保护,避免全局失稳。

- 临界态:系统处于有序与混沌边缘的状态,核心特征是标度不变性、长程关联、幂律分布,是智能涌现的最优动力学状态,人类大脑的神经活动就长期处于临界态。

- 红外极限/红外动力学:对应低频率、长时尺度、长程关联的动力学极限,由慢集体模主导,决定了系统的核心认知能力(理解、推理、长期记忆);与之相对的紫外动力学,对应高频、短时、局部的信息处理。

- 扇区:高维状态空间中,动力学特性完全解耦的子空间。论文里把认知系统拆分为径向扇区(负责全局稳定)和角向扇区(负责临界灵活),两个扇区互不干扰,实现了稳定与灵活的共存。

- 自组织临界性(SOC):系统无需外部参数微调,自发演化到临界态的现象,是复杂系统涌现长程秩序的核心机制。论文里的超级智能相,就是受保护的自组织临界态。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-01,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录