Windows 10上安装Node.js的初学者指南

原创Windows 10上安装Node.js的初学者指南

原创用户11001451

发布于 2024-03-01 10:07:55

发布于 2024-03-01 10:07:55

引言

Node.js是是一个强大的JavaScript运行时环境,建立在Chrome的V8 JavaScript引擎上,让你能够在服务器端运行JavaScript。

通过本教程,你将学会如何设置Node.js和npm(节点包管理器等现代Web开发的必备工具。无论你是希望构建Web应用程序、创建服务器端脚本,还是涉足全栈开发,安装Node.js都是你的第一步。那么,让我们开始吧!

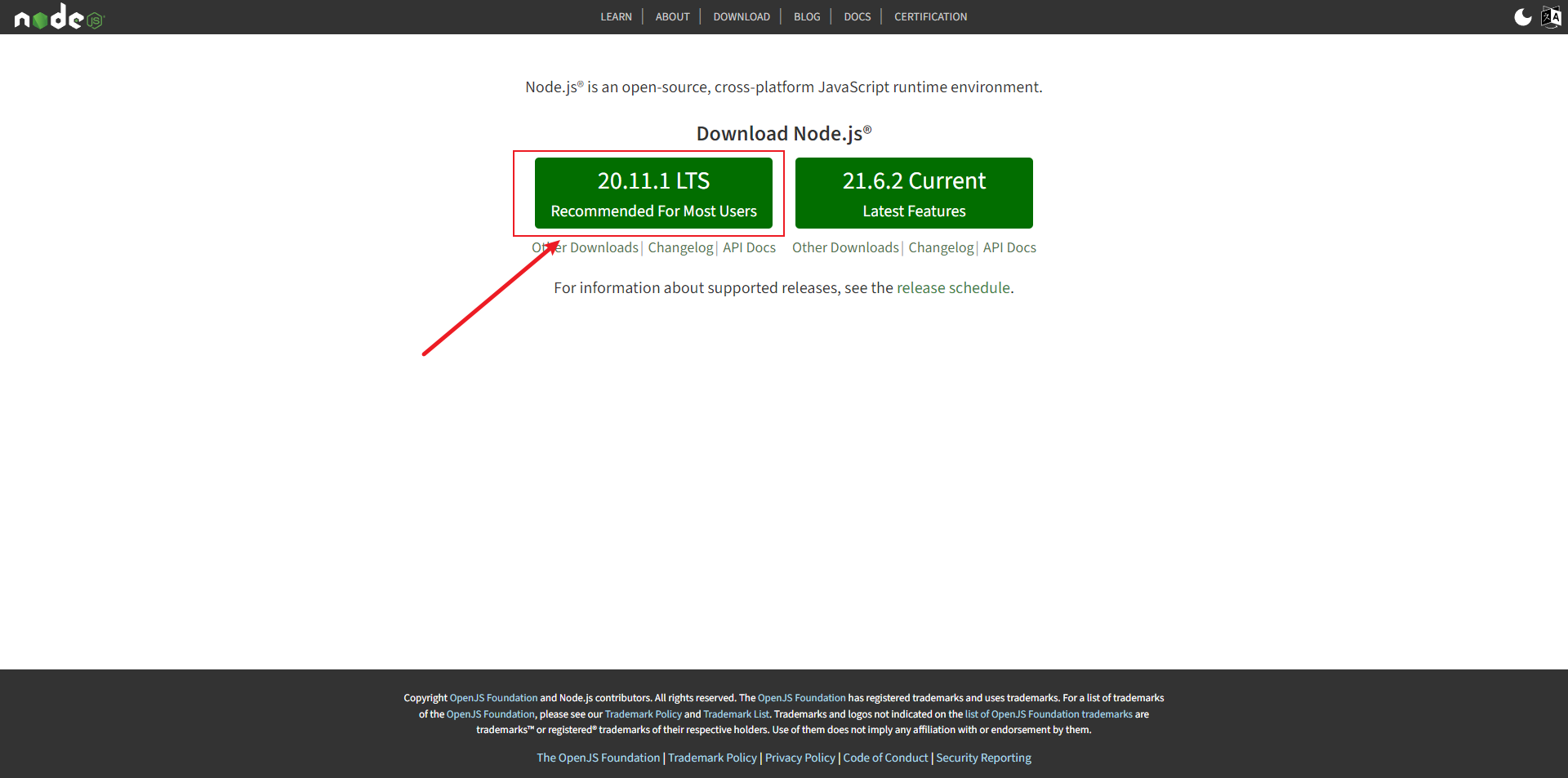

步骤1:下载Node.js安装程序

- 访问官方Node.js网站:https://nodejs.org/

- 你会看到两个版本可供下载:LTS(长期支持)和Current。对于初学者,我推荐LTS版本,因为它的稳定性和延长的支持。

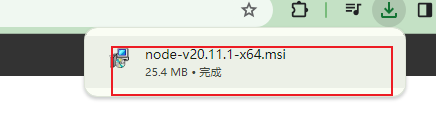

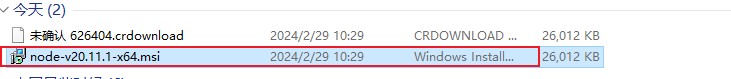

- 点击LTS按钮下载Windows安装程序(.msi文件)。确保选择与你的Windows架构(32位或64位)相匹配的版本,在浏览器的右上角点击在 在文件夹中显示

步骤2:安装Node.js和npm

- 下载安装程序后,运行.msi文件开始安装向导。

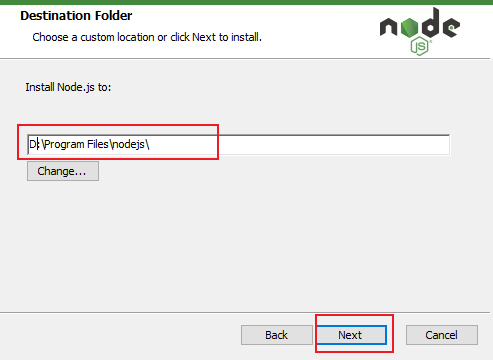

- 按照安装向导中的提示操作,点击“下一步”同意许可协议,选择安装文件夹(你可以保留默认位置,也可以修改安装路径到D盘),

这里教大家一个简单的方法:鼠标光标移到C的后面,编辑安装路径,将C改为D

改好后像下图这样,然后 Next

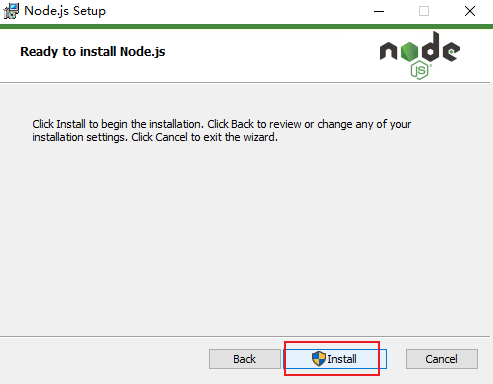

- 选择要安装的组件。我推荐保留默认设置,默认设置包括了npm,一路 Next 即可

- 在“准备安装Node.js”屏幕上,点击“安装”,需要提供管理员权限,等待安装完成。

步骤3:验证安装

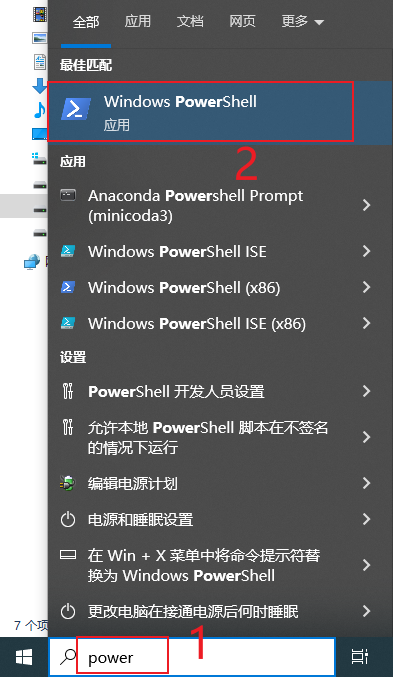

- 为了确保Node.js和npm正确安装,打开命令提示符(你可以通过在Windows搜索栏中输入

cmd或powershell)

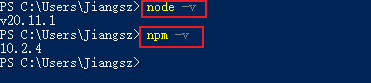

- 输入

node -v并按Enter键。这个命令检查安装的Node.js版本。如果安装成功,你应该会看到版本号。 - 接下来,输入

npm -v并按Enter键检查npm版本。同样,你应该会看到版本号,确认npm已正确安装。

结语

恭喜你!你已经在你的Windows 10上成功安装了Node.js和npm。

如果你有任何问题或需要进一步的帮助,都可以随时向我提问哟

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录