ollama v0.18.0正式发布:云模型无缝直连、Claude Code自动压缩窗口、错误处理与交互体验全面升级

ollama v0.18.0正式发布:云模型无缝直连、Claude Code自动压缩窗口、错误处理与交互体验全面升级

福大大架构师每日一题

发布于 2026-03-31 21:08:11

发布于 2026-03-31 21:08:11

在这里插入图片描述

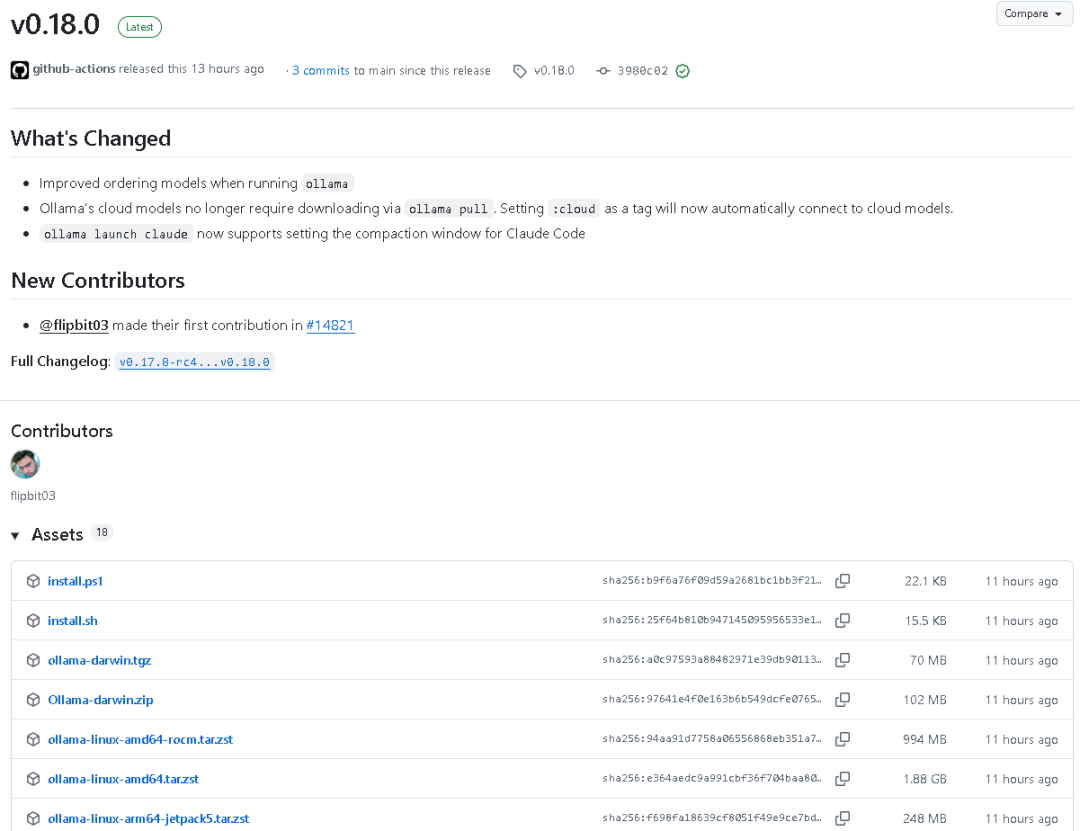

在这里插入图片描述

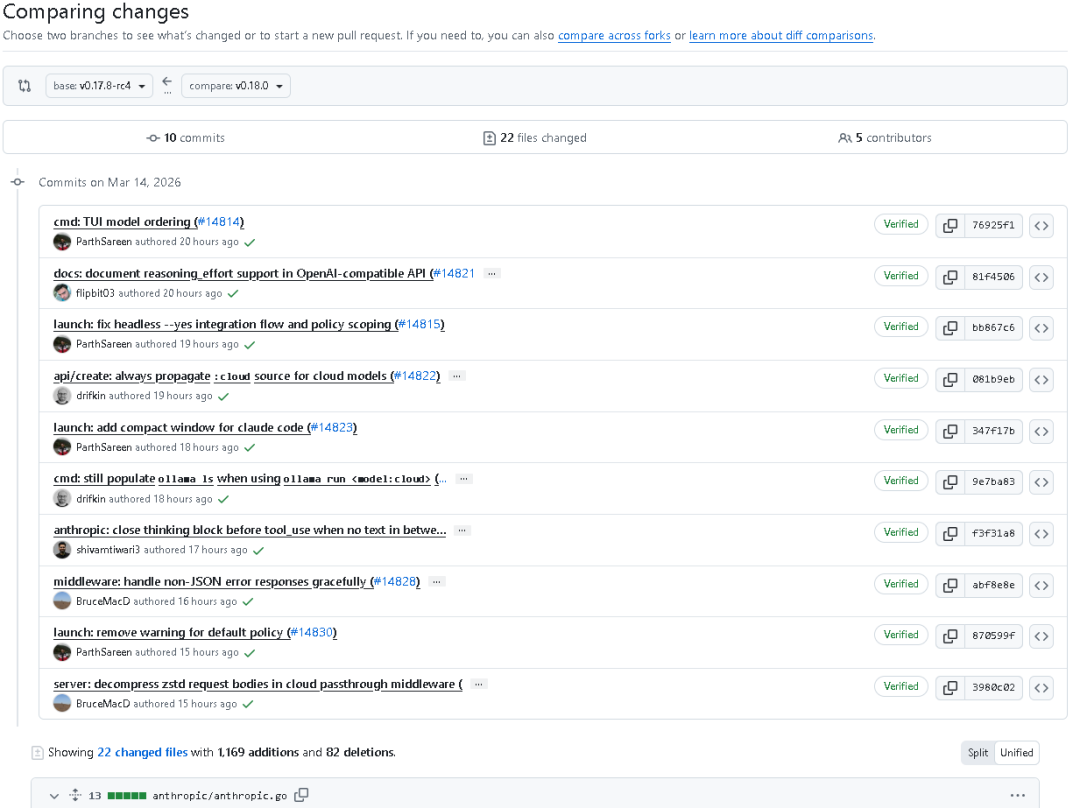

在这里插入图片描述

2026年3月14日,ollama v0.18.0正式发布,这是一次极具里程碑意义的版本更新。本次更新围绕云模型、集成启动、Claude代码支持、OpenAI兼容接口、命令行体验及中间件处理能力等多个维度进行了系统优化和重大改进。无论是使用本地模型还是云端大模型的开发者,都能在此版本中获得更加流畅、智能和安全的体验。

以下为本次 v0.18.0 版本的详细更新内容与技术解读。

一、核心亮点综述

- 1. 云模型全面接入:

- • 现在无需通过

ollama pull下载云模型,只需在模型名称后添加:cloud标签,即可自动连接云端模型。 - • 系统在调用

ollama run <model:cloud>时,会自动拉取云模型的“stub”信息,完成兼容性适配。 - • 改进了模型源的传播逻辑,在创建云模型衍生版本时维护明确的来源标识。

- • 现在无需通过

- 2. Claude代码增强:

- • 新增支持设置 Compaction Window(压缩窗口)功能,针对 Claude Code 云模型自动设定窗口大小以优化上下文处理。

- • 对 Claude 本地与云模型环境变量装载进行了精细优化,确保自动选择正确模型与上下文。

- 3. OpenAI兼容API增强:

- • 文档新增了

reasoning_effort参数支持说明,可在推理型模型中控制推理强度("high"、"medium"、"low"、"none")。 - • 完善了推理/thinking控制字段,实现对推理模型的细粒度策略控制。

- • 文档新增了

- 4. 命令行功能升级:

- • 改进模型排序及启动行为,优化 TUI(终端交互界面)中的选项逻辑。

- • “--yes” 无头模式强化:在不交互的环境中可自动批准并拉取缺失模型。

- • 新增云模型检测与自动补全机制,使显式云模型在列表中同样被

ollama ls正确识别。

- 5. 中间件与服务器改进:

- •

middleware层在处理非 JSON 错误时可自动回退字节错误提示,避免解析错误干扰。 - • 新增 zstd 解压支持,在云代理中间件可自动解码压缩请求体,实现高效传输。

- • 限制最大解压后体积(20MB),防止超大请求导致资源消耗。

- • 改进云代理 passthrough 流程,检测

Content-Encoding: zstd并清除标头后运行。

- •

二、详细更新内容解读

(一)命令行 cmd 模块优化

在 cmd/cmd.go 中,新增加了 ensureCloudStub 函数,用于匹配传统 ollama run some-model:cloud 的行为。当用户显式指定云源模型时,系统会自动尝试拉取对应的云 stub 文件。此步骤保证即便本地未缓存模型,也能正常启动连接。

命令行的执行流程现在支持:

- • 自动标准化模型名;

- • 若云模型 stub 不存在则自动下载;

- • 若下载失败不会中断生成,而是以“尽力而为”方式继续任务。

测试文件 cmd/cmd_test.go 增加了多组验证用例:

- • 当显式云模型 stub 缺失时,系统会拉取标准化命名;

- • 若 stub 已存在,则跳过下载;

- • 即使下载失败,仍继续调用

/api/generate保证生成任务不受影响。

此外,新增针对云模型继承关系的测试场景:

在 NewCreateRequest 中,当启动会话以 :cloud 结尾时,父模型若无 cloud 来源,则自动清理父模型标记,防止错误地创建本地衍生版本。

(二)Claude启动模块增强

cmd/launch/claude.go 的 modelEnvVars 函数进行了重构:

- • 现在返回的环境变量中包含

CLAUDE_CODE_AUTO_COMPACT_WINDOW,用于自动根据云模型上下文大小设置 Claude Code 的压缩窗口。 - • 若模型为云模型,会通过查表机制获得合适的上下文限制值并自动写入环境变量。

对应测试 cmd/launch/claude_test.go 校验:

- • 本地模型不会生成该变量;

- • 云模型能正确设定窗口值(例:

glm-5:cloud对应202752); - • 未知云模型不会写入压缩窗口参数,保持空值。

该改动显著提升了 Claude 在多模型之间切换时的记忆稳定性与上下文利用率。

(三)Launch命令与策略优化

在 launch.go 中,新增了对 LaunchPolicy 的升级:

- 1. 将默认策略函数改造为

defaultLaunchPolicy(interactive, yes bool); - 2. 当带有

--yes标记时(包括非交互环境),自动将确认模式设为“自动批准”,缺失模型策略设为“自动拉取”。 而在无交互且未指定 yes 的场景,则强制要求明确输入并在模型缺失时失败退出。

同时,在无头模式下,--yes 启动时增加安全检查:

若用户未显式指定

--model参数,则命令会直接报错提示 —— “requires --model ”,确保自动化执行不会错误启动。

另一个重要改进点是: 在无交互但带有自动批准模式时,系统会自动选择“上次使用的模型”进行运行。 这项优化避免了脚本化任务中因模型选择项缺失导致的中断。

测试 launch_test.go 对此功能给出充分验证:

- • 模拟无交互

--yes场景时,系统能自动选用上次运行模型; - • 若模型不存在会自动拉取;

- • 日志中输出明确指示“Headless mode: auto-selected last used model”。

(四)模型列表与选择逻辑增强

更新后的 buildModelList 和 TUI 选择器逻辑增强了“本地与云模型的精确匹配”机制:

- • 当存在本地与云端同名模型时,系统优先匹配完全相同的名称;

- • 若本地正好为“qwen3.5”,则不会误选“qwen3.5:cloud”作为当前;

- • 同时在 TUI 渲染中保证高亮显示准确,提升人工交互选择的直觉性。

在 selector.go 的 cursorForCurrent 函数中新增两阶段匹配逻辑:

- 1. 优先匹配完全相同的模型名;

- 2. 其次才考虑前后缀形式(例如

"qwen3.5:cloud"与"qwen3.5")。

与此同时,multiSelectorModel.toggleItem 也进行了升级:

- • 当取消默认选中模型时,会自动寻找最近的已选项作为新的默认项;

- • 若上方无选项,则寻找到最近下方项;

- • 保持列表稳定,防止失焦状态。

这些修改使得多模型选择流程更自然、更合理,尤其在编辑器集成与多模型协作场景下显著提升使用体验。

(五)中间件处理与错误容错升级

在 middleware/anthropic.go 与 middleware/openai.go 中,对错误响应处理进行了安全回退改造:

- • 当收到非标准 JSON 错误响应时,系统不再直接返回解析错误,而是将原始字节内容作为错误信息。

- • 避免了反复出现在日志中的 JSON Unmarshal 错误提示。

同时,新增 maxDecompressedBodySize 限制(20MB),并在云代理层引入 zstd 解压与体积控制。

在云代理 (server/cloud_proxy.go) 中:

- • 增加 zstd 解码器,当请求中包含

Content-Encoding: zstd时会自动解压; - • 完成解压后移除该头部,防止后续逻辑误判;

- • 对超大解压体积请求返回

400 Bad Request,保护系统资源安全。

测试 cloud_proxy_test.go 中验证了完整流程:

- • 压缩请求体能被正确解码,middleware 成功检测到

"model":"test-model:cloud"; - • 超大体积请求触发安全响应。

该系列优化让 ollama 在云代理链路中面对混合编码响应时更加稳定与高效。

(六)OpenAI兼容接口文档与推理控制更新

在 docs/openai_compat.md 和相关实现层中,v0.18.0 对 OpenAI 兼容性接口进行了进一步完善,使得 ollama 的 OpenAI 格式推理 API(/v1/chat/completions 与 /v1/completions)与主流云模型的适配更加完整。

1. 新增参数:reasoning_effort

- • 新参数可选值包括

"none","low","medium","high"。 - • 用于控制推理模型(如思维链推理、逻辑规划类模型)的计算与思考强度。

- • 低模式下优先快速返回结果,高模式下倾向进行更多内部推理步骤。

2. 扩展推理元数据输出

- • 新增

thinking字段支持,当模型提供内部推理痕迹时可通过专有 schema 输出。 - • 增加了兼容

X-Ollama-Thinking等 HTTP 头的能力,以保障流式响应过程中推理过程的透明性。

3. 完善兼容测试

在 middleware/openai_test.go 与 api/openai_test.go 中新增多组用例,确保:

- • 当启用

reasoning_effort=high时返回延时与token消耗可控; - • JSON 响应完全符合 OpenAI SDK 解析标准;

- • 测试覆盖了 “system + user + tool_calls” 等复杂对话格式。

这一系列改进意味着从 v0.18.0 开始,ollama 的 OpenAI 接口可作为外部应用无缝接入的通用标准接口,不论使用哪种模型后端(本地或云端)都无需修改调用逻辑。

三、总结与升级建议

ollama v0.18.0 是一次打通 本地模型与云模型交互壁垒 的关键版本。 从底层结构到开发者体验,它实现了三大跃迁:

- 1. 模型来源统一: 同一个命令可同时使用本地模型与 cloud 模型,告别传统 pull/push 流程。

- 2. 生态兼容全面: OpenAI、Claude、Anthropic 多线兼容,同步增强上下文与推理控制。

- 3. 开发体验优化: 交互界面、命令行无头模式、中间件链路、压缩与安全控制全面升级。

对于开发者的建议:

- • 若你使用脚本自动部署或服务端生成任务,可开启

--yes模式并显式指定--model参数。 - • 若你是 Claude Code 用户,请注意新的

CLAUDE_CODE_AUTO_COMPACT_WINDOW环境变量,可显著改善上下文利用率。 - • 若接入 OpenAI SDK,可直接指向

http://localhost:11434/v1,获得最佳兼容体验。

🚀 结语

代码地址:github.com/ollama/ollama

ollama v0.18.0 通过云端智能接入与全栈优化,正在重塑「本地 + 云」混合大模型体验。 无论你是热衷本地推理的开发者,还是依赖多云 LLM 的企业团队,这一版本都为你提供了更自由、更安全、更高效的模型运行方式。

·

我们相信人工智能为普通人提供了一种“增强工具”,并致力于分享全方位的AI知识。在这里,您可以找到最新的AI科普文章、工具评测、提升效率的秘籍以及行业洞察。 欢迎关注“福大大架构师每日一题”,发消息可获得面试资料,让AI助力您的未来发展。

·

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录