ollama v0.19.0 发布!Web 搜索插件上线、多模型兼容修复、MLX 与 KV 缓存全面优化,本地大模型体验再升级

ollama v0.19.0 发布!Web 搜索插件上线、多模型兼容修复、MLX 与 KV 缓存全面优化,本地大模型体验再升级

福大大架构师每日一题

发布于 2026-03-31 21:34:43

发布于 2026-03-31 21:34:43

在这里插入图片描述

在这里插入图片描述

在这里插入图片描述

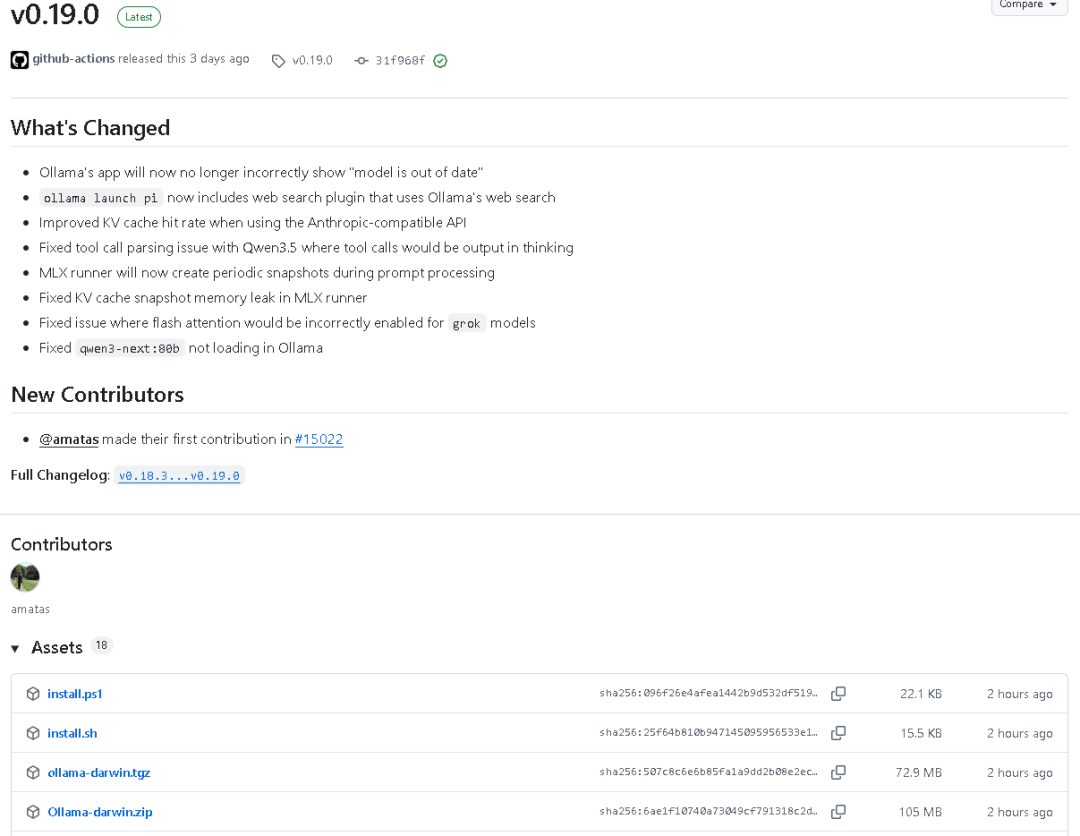

ollama v0.19.0于2026年3月30日正式发布,作为本地大模型部署与运行的核心工具,本次更新聚焦用户体验优化、功能增强与底层问题修复,覆盖应用交互、插件能力、API性能、模型兼容、MLX运行器、注意力机制等多个核心维度,同时包含26次提交、58个文件改动,全面提升ollama的稳定性、兼容性与实用性。

一、核心功能更新

- 1. 应用体验优化 ollama应用将不再错误显示“模型已过时”提示,彻底解决此前版本中模型状态判断异常的问题,避免用户被无效提示干扰,提升使用流畅度。

- 2. Web搜索插件集成 ollama launch pi功能新增内置Web搜索插件,该插件直接使用ollama官方Web搜索能力,无需额外配置即可让本地模型具备联网搜索能力,拓展本地大模型的信息获取边界,支持实时检索最新数据。

- 3. Anthropic兼容API性能提升 优化使用Anthropic兼容API时的KV缓存命中率,减少重复计算与资源消耗,提升API调用的响应速度与效率,尤其在高频、长对话场景下效果显著。

- 4. Qwen3.5模型工具调用修复 修复Qwen3.5模型工具调用解析问题,解决此前版本中工具调用内容被错误输出在思考模块的问题,确保工具调用逻辑清晰、结果准确,保障Qwen3.5模型的函数调用能力正常生效。

- 5. MLX运行器增强

- • MLX运行器在提示词处理过程中会创建周期性快照,实现状态的持续备份,避免处理中断导致的进度丢失;

- • 修复MLX运行器中KV缓存快照的内存泄漏问题,优化内存资源占用,提升长时间运行的稳定性;

- • 优化MLX运行器的缓存驱逐与LRU跟踪逻辑,提升缓存管理效率;

- • 合并setStateRaw与setStateDetached为setState,简化API调用逻辑,降低开发与使用复杂度。

- 6. 模型兼容与机制修复

- • 修复Grok模型的Flash Attention错误启用问题,确保Grok模型在ollama中运行时,注意力机制配置符合模型特性,避免性能异常或兼容性问题;

- • 解决qwen3-next:80b模型无法在ollama中加载的问题,完善对该大参数模型的支持,拓展ollama可运行的模型范围。

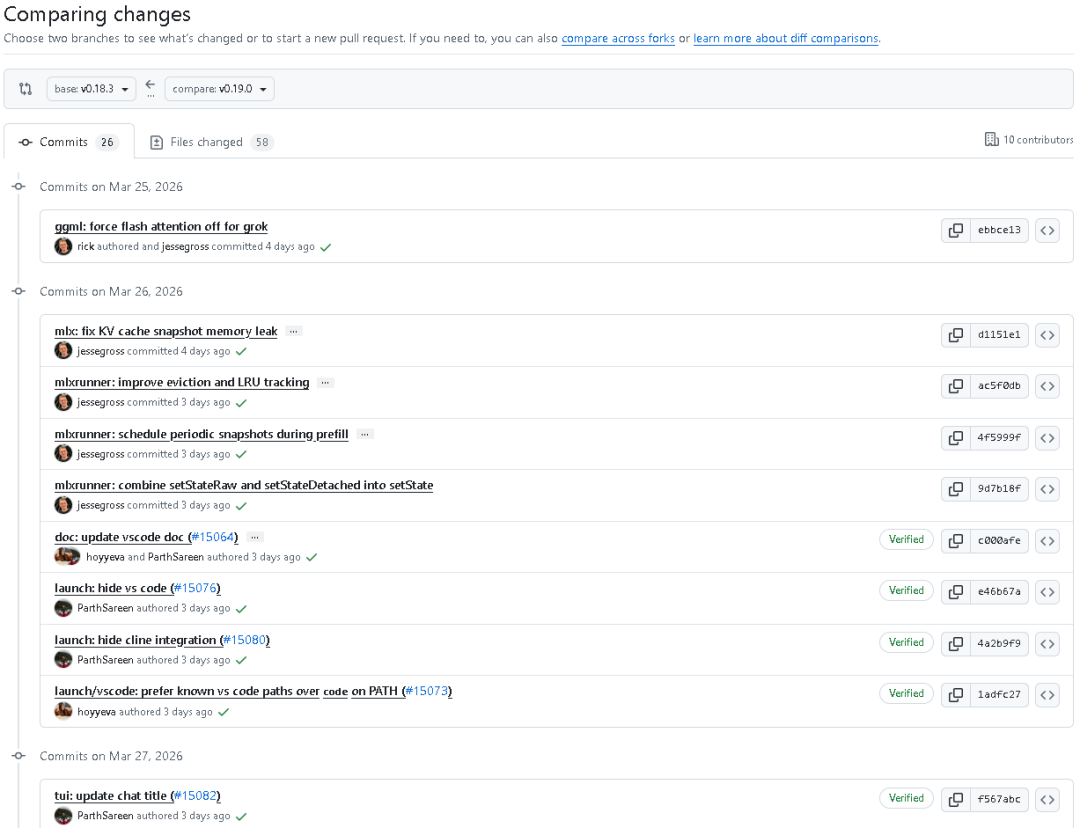

二、提交与改动详情(按时间梳理)

2026年3月25日

- • ggml模块:强制关闭Grok模型的Flash Attention,从底层解决Grok模型注意力机制配置错误问题。

2026年3月26日

- • MLX模块:修复KV缓存快照内存泄漏,优化内存管理;

- • MLX运行器:改进缓存驱逐与LRU跟踪逻辑,提升缓存效率;

- • MLX运行器:在预填充阶段调度周期性快照,实现状态自动备份;

- • MLX运行器:合并setState相关接口,简化调用逻辑;

- • 文档:更新VS Code相关文档,完善开发工具集成说明;

- • launch模块:隐藏VS Code集成入口、Cline集成入口;

- • launch/vscode模块:优先使用已知VS Code路径,而非PATH中的code命令,提升工具调用准确性。

2026年3月27日

- • TUI模块:更新聊天标题,优化交互界面展示;

- • CI模块:在Linux系统中包含MLX JIT头文件,完善编译依赖;

- • launch模块:对本地模型,当服务器上下文长度低于64k时发出警告,帮助用户提前规避长文本处理问题;

- • CI模块:强化CUDA包含路径处理,提升GPU环境兼容性;

- • 模型解析器:修复Qwen3.5工具块在思考块中启动时的关闭逻辑,解决工具调用解析异常;

- • 解析器:优化Qwen3.5流式工具调用解析,并添加回归测试,保障功能稳定性;

- • 应用模块:修复模型“过时”错误提示,优化用户体验;

- • Anthropic模块:修复因工具调用参数重排序导致的KV缓存复用降级问题,提升API性能;

- • launch模块:跳过MLX模型的上下文长度警告,并显示模型名称,优化提示逻辑;

- • Anthropic模块:修复内容块中的空输入问题,避免API调用异常;

- • 服务器模块:拉取模型时保留原始清单字节,保障模型完整性。

2026年3月28日

- • MLX模块:修复视觉能力与最低版本兼容问题,完善多模态支持;

- • launch模块:自动安装pi并管理Web搜索生命周期,简化插件使用流程;

- • launch模块:优化已添加模型的多选功能,提升操作便捷性;

- • 回滚上下文长度警告变更,调整提示策略。

2026年3月29日

- • 模型模块:为qwen3-next添加对传统ssm_in投影的兼容性,解决模型加载失败问题;

- • 命令模块:在配置中设置OpenCode默认模型,优化模型调用默认配置。

三、更新总结

代码地址:bgithub.xyz/ollama/ollama

ollama v0.19.0版本从用户体验、功能拓展、底层性能、模型兼容四大方向发力,新增Web搜索插件拓展本地模型能力,修复多模型(Qwen3.5、Grok、qwen3-next:80b)的核心问题,优化MLX运行器与KV缓存机制,同时完善API、CI、工具集成等模块的细节,全面提升ollama的稳定性、兼容性与易用性,为本地大模型开发者与用户提供更优质的运行环境。

·

我们相信人工智能为普通人提供了一种“增强工具”,并致力于分享全方位的AI知识。在这里,您可以找到最新的AI科普文章、工具评测、提升效率的秘籍以及行业洞察。 欢迎关注“福大大架构师每日一题”,发消息可获得面试资料,让AI助力您的未来发展。

·

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-30,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录