不止提升准确率:CoT 赋能 Transformer 的本质是 “串行计算”

不止提升准确率:CoT 赋能 Transformer 的本质是 “串行计算”

赛博解生

发布于 2026-04-09 13:05:34

发布于 2026-04-09 13:05:34

引言

大模型的思维链(Chain of Thought)是一种通过分步解题来解决复杂问题的方法,其本质就是在输出最终回答之前输出更多的中间token。这一模式即LLM的“深度思考”模式,赋予模型“深度思考”的能力。为什么引入更多的中间token就能提升出更准确、更 Complete 的答案?究竟什么样的思维链式是好的?引入思维链可以解决哪些问题以及该方法的上限是什么?今天这篇论文对上述问题从理论角度进行了深入的分析,可以帮我们更好理解CoT的神奇魔力。

一、从“单打独斗”到“团队协作”的思维升级

想象一下,一位天才工程师被要求解决一个复杂的组装问题。如果只给他最终指令(比如“造一辆汽车”),他可能会因信息过载而束手无策。但如果我们允许他先写下中间步骤(“先安装引擎,再组装车轮,最后调试电路”),他就能一步步攻克难题。这就是链式思考(Chain of Thought, CoT)为Transformer带来的根本性变革——从“并行处理”的蛮力计算,升级为“串行推理”的思维链条。

本篇论文《Chain of Thought Empowers Transformers to Solve Inherently Serial Problems》(ICLR 2024)由Zhiyuan Li(TTIC/斯坦福)、Hong Liu(斯坦福)、Denny Zhou(Google DeepMind)和Tengyu Ma(斯坦福)合作完成,通过理论分析和实验验证,揭示了CoT如何让低深度Transformer突破计算局限,解决原本无法处理的串行问题。

二、为什么传统Transformer“智商不够用”?

传统Transformer(尤其是低深度模型)在数学推理、符号运算等任务上表现不佳,并非因为模型参数不足,而是源于其计算本质的并行性限制。论文指出了两大核心缺陷:

- 深度瓶颈:Transformer的深度(层数)决定了其能进行的“串行计算步数”。在没有CoT的情况下,常数深度(如3-6层)的Transformer只能表达AC0或TC0复杂度类的问题(如模加运算),无法处理需要多步推理的任务(如置换组合或电路求值)。

- 精度陷阱:实际训练中使用的有限精度(如16位浮点数)会引入舍入误差,导致迭代运算(如累加)的关联性被破坏,进一步削弱了模型的表达力。

用比喻来说,传统Transformer像一个“并行工厂”,所有流水线同时开工,适合组装简单零件(并行任务),但遇到需要“先A后B”的复杂工序(串行任务)时,就会因缺乏调度而卡壳。

三、CoT如何化身“推理助理”?

核心思想

CoT的创新点在于:允许模型在输出最终答案前,自回归地生成一系列中间Token(即“思考步骤”)。每一步的中间输出会作为下一步的输入,从而将计算深度从固定的层数扩展为可变的步骤数(T步CoT ≈ T层虚拟深度),能解决P/poly问题。由于P/poly包含所有多项式时间可解问题(如密码学任务、优化问题),这意味着Transformer+CoT理论上可近似任何“结构化的复杂函数”,而非仅依赖黑箱拟合。

关键组件与工作流程

论文通过理论构造证明,一个常数深度、对数嵌入维度的Transformer,配合T步CoT,可以模拟任何大小为T的布尔电路(即表达P/poly类问题),其核心机制概要如下:

- Token化推理步骤:

- 每个中间步骤对应电路中的一个逻辑门(如AND、OR)。例如,在解决电路值问题(CVP)时,CoT步骤会依次计算每个门的输出。

- 位置编码被用来存储门类型、输入门ID等元信息,嵌入维度仅需O(log n)即可编码多多项式规模电路。

- 注意力机制作为信息调度器:

- 在每一步中,注意力层像“项目经理”一样,从历史记录中提取所需的前驱门结果(通过键值查询实现)。

- 前馈网络则扮演“计算员”,根据注意力汇总的信息执行当前门的逻辑运算。

- 有限精度下的稳健性:

- 论文首次严格建模了浮点数舍入误差,证明即使有限精度下,CoT仍能通过误差累积控制保持可靠性。

技术亮点

- 复杂度跃迁:无CoT时,Transformer限于TC0;有CoT后,可表达P/poly(所有多项式大小电路问题)。

- 资源效率:仅需对数级嵌入维度(O(log n))即可支持复杂推理,避免了参数爆炸。

四、实力验证:CoT在硬核任务上的“降维打击”

论文在四个关键任务上验证了CoT的效力:

- 模加运算(Modular Addition):

- 属于TC0类问题,传统Transformer即使深度=1也能解决(因为高度并行)。

- 但CoT在长序列输入下表现更稳定(见图1)。

图1.对于模加这类相对简单的并行任务,CoT依然能带来性能提升,尤其是在模型深度受限时。这表明CoT不仅能解决“不能做”的问题,也能优化“可以做”的任务的稳健性。

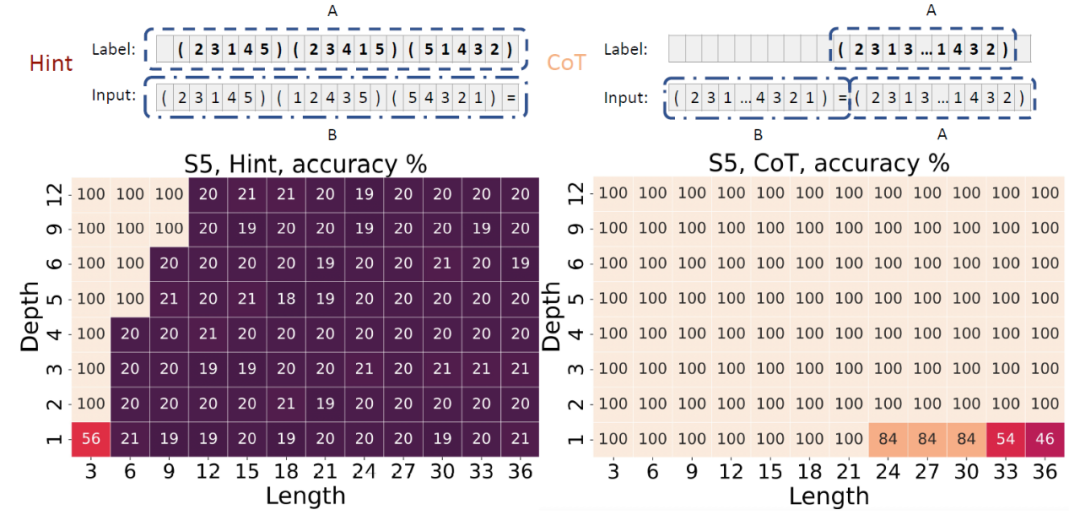

- 置换组合(Permutation Composition, S5):

- 属于NC1完全问题,公认无法被TC0电路解决(除非TC0=NC1这一猜想不成立)。

- 结果:无CoT时准确率≈20%(随机猜测);有CoT后深度=1即可接近100%(见图2)。

图2.该图直观展示了CoT在解决复杂串行问题上的决定性作用。对于置换组合任务,只有在启用CoT时,模型性能才能随着训练显著提升并接近完美,而基线模型和仅提供额外提示标签的模型表现均不理想。

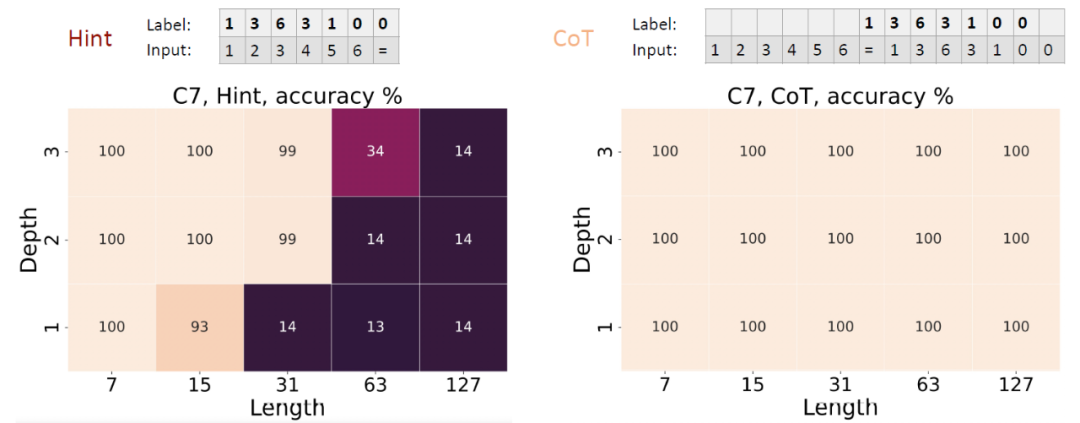

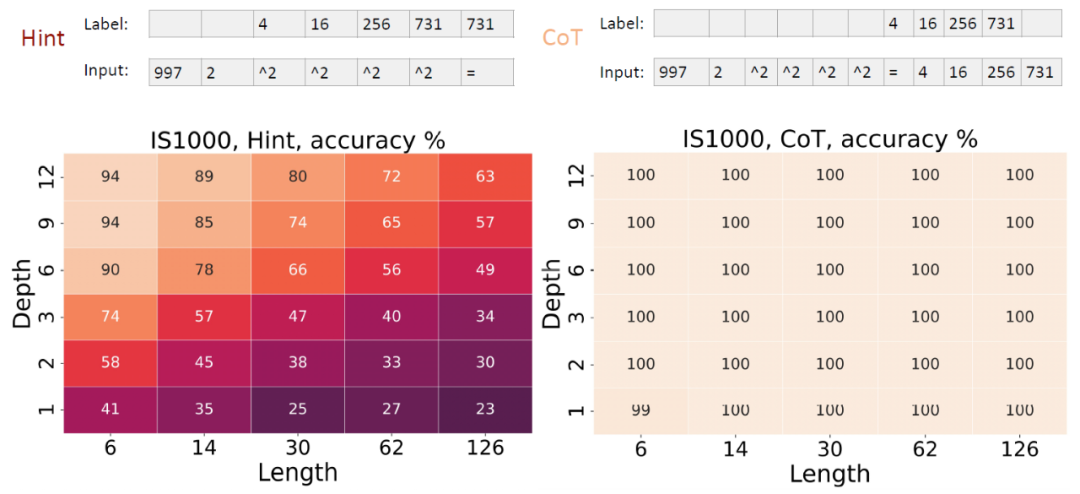

- 迭代平方(Iterated Squaring)与电路值问题(CVP):

- 两者均需串行计算,CoT以少深度实现高精度(见图3)。

图3.迭代平方任务再次强化了论文的核心论点。CoT曲线与其他曲线的鲜明对比,为“CoT为Transformer提供了执行串行计算的能力”这一理论提供了强有力的经验证据。

结论:CoT不是“锦上添花”,而是“雪中送炭”——对并行友好任务提升有限,但对串行硬核任务带来数量级改进。

五、CoT的局限性与展望

理论完美性与现实落差

- 假设漏洞:论文的理论构建依赖于“中间步骤完全正确”的理想条件,并且基于抽象的计算复杂性理论。在实际中,CoT可能错误传播(如第一步错,步步错)。实验中的CoT是预设的(非模型生成),若模型自生成CoT,如何保证可靠性?对于更广泛的非推理型问题,例如医疗、金融和法律等垂直领域,CoT是否有必要性?

- 非均匀性争议:论文采用非均匀复杂度类(每输入规模一个模型),这在实际部署中不现实。我们能否设计统一模型,动态适应不同规模?

此外,Transformer本为并行处理而生,CoT却引入串行依赖。这是否意味着Transformer正在“模拟”RNN的序列性?或许,未来架构需在并行效率与串行能力间寻找平衡——比如引入条件计算,动态激活子网络。

从“推理链”到“思维网”

- 应用场景:CoT已用于数学证明、代码生成,下一步可能是复杂决策(如多步规划)、科学发现(如假设-验证链)。相关的研究例如Tree of thoughts,Atom of thoughts等已经做了相关探索

- 可解释性:CoT映射了人类“分解问题”的认知策略。它并没有让模型更聪明,而是让它的思考过程对我们更透明——这或许是可解释AI的真正起点。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-17,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录