DeepSeek V4 技术架构深度解析:1.6万亿参数、百万上下文与三大核心突破

DeepSeek V4 技术架构深度解析:1.6万亿参数、百万上下文与三大核心突破

老周聊架构

发布于 2026-04-28 13:19:46

发布于 2026-04-28 13:19:46

2026年4月24日,DeepSeek正式发布V4系列预览版——这不是一次简单的参数堆叠,而是一场关于"效率、规模、长文本"三者重新平衡的工程革命。

一、发布概况:双版本齐发,百万上下文成标配

DeepSeek V4系列一次性推出两款MoE(混合专家)模型,全部原生支持100万Token超长上下文:

模型 | 总参数量 | 激活参数 | 预训练数据 | 上下文长度 |

|---|---|---|---|---|

V4-Pro | 1.6万亿 (1.6T) | 490亿 (49B) | 33T Token | 1M |

V4-Flash | 2840亿 (284B) | 130亿 (13B) | 32T Token | 1M |

开源协议:MIT,代码与权重完全开放。

关键定位:用更大的参数池承载更多知识,用更稀疏的激活控制推理成本,用全系标配的百万上下文把长文本处理从"高端功能"变成"基础设施"。

官方直言:从现在开始,一百万上下文将是DeepSeek所有官方服务的标配。

二、三大架构突破

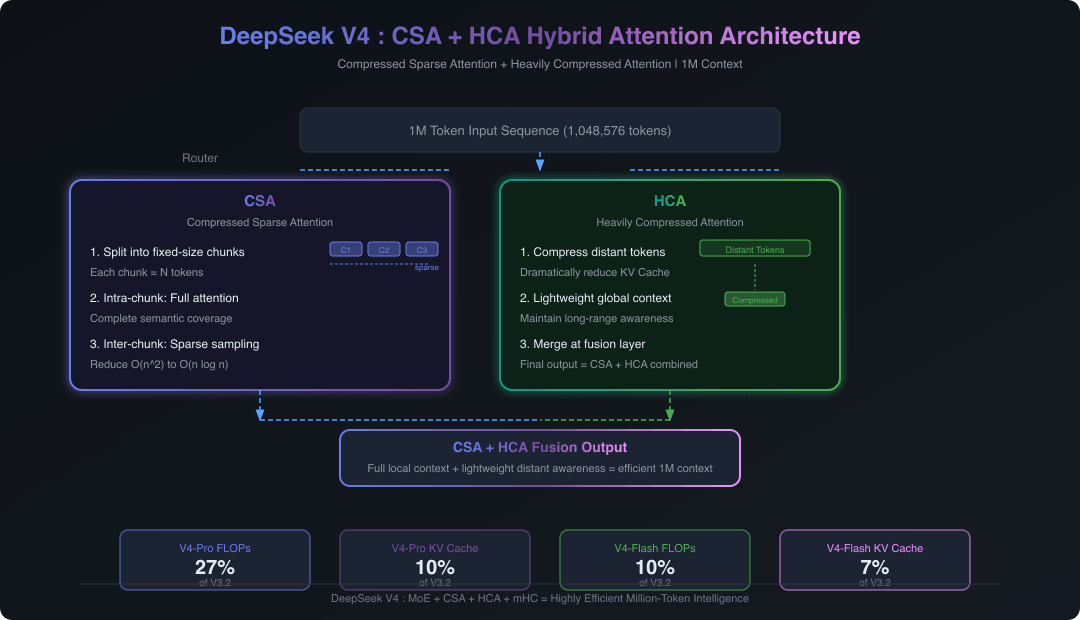

2.1 混合注意力机制:CSA + HCA

这是V4最核心的创新。传统全量自注意力在百万Token场景下计算量呈二次方爆炸,V4通过全新的分层注意力架构解决了这个问题:

CSA(Compressed Sparse Attention,压缩稀疏注意力)

- 将长上下文按固定长度划分为多个分组

- 分组内执行全量注意力,保证局部语义完整

- 跨分组仅通过稀疏采样交互,大幅降低计算复杂度

HCA(Heavily Compressed Attention,重度压缩注意力)

- 对远距离Token进行高度压缩后参与注意力计算

- 进一步降低KV Cache显存占用

效果惊人:

- 在100万Token上下文下,V4-Pro的单Token推理FLOPs仅为V3.2的27%

- KV Cache仅需V3.2的10%

- V4-Flash更极端:分别压到10%和7%

这意味着什么?同样一张显卡,以前只能跑32K上下文,现在可以稳定跑1M上下文。长时序任务从"理论上可行"变成了"工程上可落地"。

2.2 流形约束超连接(mHC)

超大规模MoE模型的训练稳定性一直是业界难题——模型越大,梯度传播越容易出问题。

V4引入了Manifold-Constrained Hyper-Connections(流形约束超连接):

- 在传统残差连接基础上增加流形约束

- 让信号在网络各层之间传递更稳定、更精准

- 解决了1.6T参数规模的训练不收敛/不稳定问题

这项技术源自DeepSeek此前论文中提出的Hyper-Connections思想的进一步演进。

2.3 Muon优化器

V4在训练优化器上选择了Muon(而非主流的AdamW):

- 加速大模型训练收敛速度

- 提升训练稳定性

- 配合GRPO(Group Relative Policy Optimization)进行RL强化学习

- 采用KL散度修正防止策略偏离

预训练阶段使用32K上下文,后续扩展至1M——这种"先短后长"的上下文扩展策略也是V4能高效达成百万上下文的关键工程选择之一。

三、MoE架构详解

3.1 Mega专家内核

V4的MoE架构采用了被称为Mega内核的超大规模专家设计:

参数 | V4-Pro | V4-Flash |

|---|---|---|

每层专家数 | 384个 | 较少(未公开精确值) |

每次激活专家数 | 6个 | 较少 |

注意力机制 | DSA2(融合DSA+NSA) | 同左 |

DSA2是DeepSeek第二代稀疏注意力机制,融合了:

- V3/R1中的DSA(DeepSeek Sparse Attention)

- 2026年初论文提出的NSA(Native Sparse Attention)

两种稀疏注意力机制的融合方案,让长上下文效率达到新高度。

3.2 稀疏激活的艺术

V4的MoE门控网络比前代更加稀疏:

- 单个Token实际调用的算力更少

- 但可调用的知识储备更大

- 这就是"1.6T总参数 / 仅49B激活"的含义

打个比方:V4像一个拥有1600本专业书的图书馆,但每次你提问,它只需要翻阅其中6本就能给出高质量答案。知识广度和推理效率兼得。

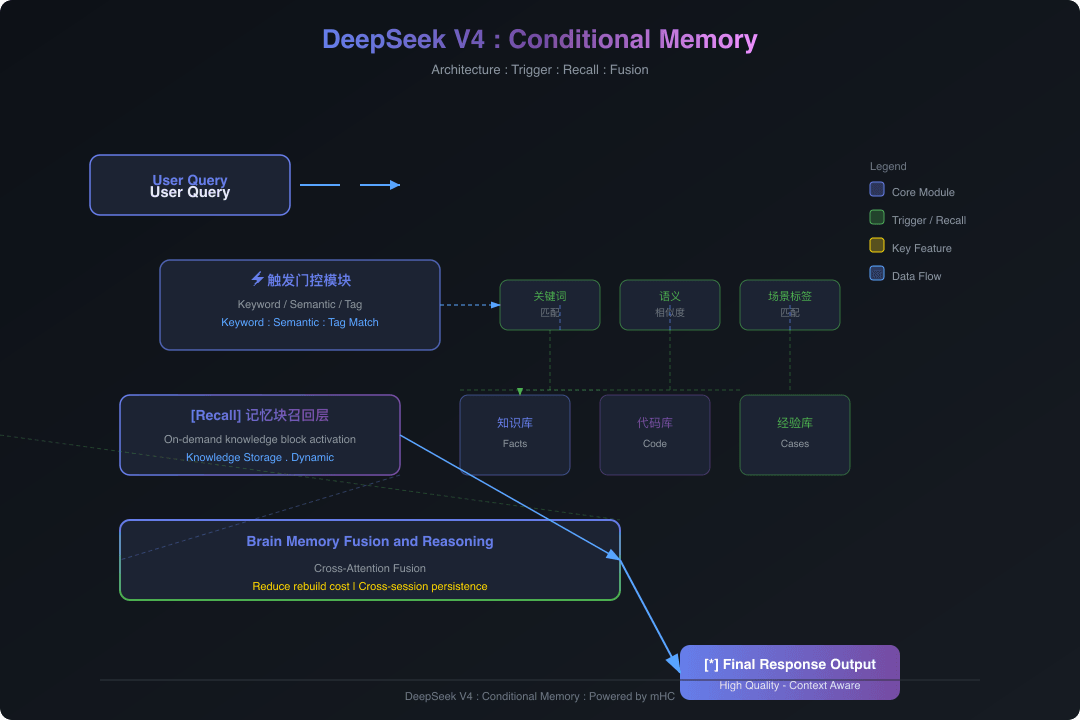

四、条件记忆机制(Conditional Memory)

V4引入了一项创新性的条件记忆模块,这是对传统RAG(检索增强生成)思路的架构级整合:

工作原理

架构说明:用户 Query 进入触发门控模块,通过关键词匹配、语义相似度或场景标签三种方式激活相关记忆块,经跨注意力融合后输出高质量响应。

三大能力:

- 知识存储:将高频知识存储在条件记忆中

- 按需激活:根据当前任务自动激活相关知识

- 动态更新:根据反馈持续优化记忆内容

三类触发规则:

- 关键词匹配

- 语义相似度匹配

- 场景标签匹配

优势:减少昂贵的动态知识重建开销,同时支持持久化存储、跨会话/跨项目复用。

五、性能基准测试:全面对标顶级闭源模型

5.1 知识与推理

基准测试 | V4-Pro-Max | 对比竞品 |

|---|---|---|

Apex Shortlist | 90.2% | 领先 |

Codeforces Rating | 3206 | 超越Gemini-3.1-Pro & Claude Opus-4.6 |

IMO-AnswerBench | 89.8% | 顶尖水平 |

HMMT 2026 | 95.2% | 行业领先 |

SimpleQA-Verified | 57.9% | 略逊于Gemini-3.1-Pro(75.6%),但领先所有开源模型约20个百分点 |

5.2 编程能力

基准测试 | V4-Pro-Max | 说明 |

|---|---|---|

LiveCodeBench Pass@1 | 93.5% | 刷新纪录 |

SWE-bench Verified | 80.6% | 与Claude/GPT持平 |

Terminal Bench 2.0 | 67.9% | Agent任务突出 |

Toolathlon | 51.8% | 工具调用优势明显 |

内部R&D基准 Pass Rate | 67% | Sonnet 4.5为47%,Opus 4.6 Thinking为80% |

5.3 长上下文

基准测试 | 得分 |

|---|---|

MRCR(百万Token长上下文检索) | 83.5% |

5.4 第三方评测亮点

- Arena.ai:将V4-Pro(思考模式)定性为"相较V3.2的重大飞跃",代码竞技场开源第3位、综合第14位

- Vals AI:在Vibe Code Benchmark以"压倒性优势"拿下开源权重模型榜首,较上代V3.2实现约10倍性能跃升

六、三档推理模式

V4提供灵活的推理强度选择:

模式 | 适用场景 | 特点 |

|---|---|---|

Non-Think | 日常对话、轻量任务 | 即时响应,最快速度 |

Think High | 专业问题、深度推理 | 思考时间长,质量更高 |

Think Max | 科研、复杂编程、Agent任务 | 最大思考强度,高峰期可能排队 |

API调用支持 reasoning_effort 参数设置思考强度(high/max)。对于复杂Agent场景,官方建议使用思考模式 + max强度。

七、训练策略:"领域专家培养 + 统一模型整合"

V4采用两阶段后训练策略:

第一阶段:领域专家培养

- 针对不同领域(数学、代码、推理、知识等)分别训练专门能力

- 让每个"子专家"在自己的领域达到极致

第二阶段:统一模型整合

- 将各领域专才整合到一个统一模型中

- 通过多目标平衡避免"跷跷板效应"(提升一个能力导致另一个下降)

预训练基于32T+高质量Token,采用GRPO及KL散度修正进行强化学习微调。

八、生态适配:华为昇腾首发,寒武纪Day 0适配

华为芯片支持

V4首发即支持华为昇腾NPU部署:

- 华为超节点已验证MoE加速能力

- 国产AI芯片打破英伟达垄断的重要一步

寒武纪Day 0适配

国产AI芯片厂商寒武纪宣布:

- 发布当日完成Day 0适配

- 覆盖V4-Flash(285B)和V4-Pro(1.6T)两个版本

- 基于vLLM推理框架

- 适配代码已开源至GitHub

开源地址

- HuggingFace:https://huggingface.co/collections/deepseek-ai/deepseek-v4

- ModelScope:https://modelscope.cn/collections/deepseek-ai/DeepSeek-V4

- 技术报告:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf(58页完整版)

九、总结:为什么V4值得关注?

DeepSeek V4不是单一维度的参数竞赛,而是一次"参数规模 × 激活效率 × 上下文长度"三者重新平衡的系统性工程:

- 效率革命:百万Token上下文的推理成本降至前代的27%,让长文本应用真正普及

- 架构创新:CSA+HCA混合注意力、mHC超连接、条件记忆模块——每一项都是可复用的技术贡献

- 开源普惠:MIT协议、1.6T参数完全开源、API同步上线

- 国产算力:华为昇腾首发适配,寒武纪Day 0跟进——国产AI生态的关键里程碑

正如官方技术报告标题所言:Towards Highly Efficient Million-Token Context Intelligence(迈向高效百万令牌上下文智能)。这不仅是DeepSeek的一小步,更是整个开源AI社区向"高效长上下文"时代跨越的一大步。

— 完 —

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录